네트워킹 구성 및 관리

네트워크 인터페이스 및 고급 네트워킹 기능 관리

초록

- 본딩, VLAN, 브리지, 터널 및 기타 네트워크 유형을 구성하여 호스트를 네트워크에 연결할 수 있습니다.

- IPsec과 Wire>-<는 호스트와 네트워크간에 보안 VPN을 제공합니다.

- RHEL은 정책 기반 라우팅 및 MPTCP(Multipath TCP)와 같은 고급 네트워킹 기능도 지원합니다.

보다 포괄적 수용을 위한 오픈 소스 용어 교체

Red Hat은 코드, 문서, 웹 속성에서 문제가 있는 용어를 교체하기 위해 최선을 다하고 있습니다. 먼저 마스터(master), 슬레이브(slave), 블랙리스트(blacklist), 화이트리스트(whitelist) 등 네 가지 용어를 교체하고 있습니다. 이러한 변경 작업은 작업 범위가 크므로 향후 여러 릴리스에 걸쳐 점차 구현할 예정입니다. 자세한 내용은 CTO Chris Wright의 메시지를 참조하십시오.

Red Hat 문서에 관한 피드백 제공

문서 개선을 위한 의견에 감사드립니다. 어떻게 개선할 수 있는지 알려주십시오.

Jira를 통해 피드백 제출 (등록 필요)

- Jira 웹 사이트에 로그인합니다.

- 상단 탐색 모음에서 생성 을 클릭합니다.

- 요약 필드에 설명 제목을 입력합니다.

- 설명 필드에 개선을 위한 제안을 입력합니다. 문서의 관련 부분에 대한 링크를 포함합니다.

- 대화 상자 하단에서 생성 을 클릭합니다.

1장. 일관된 네트워크 인터페이스 이름 구현

udev 장치 관리자는 Red Hat Enterprise Linux에서 일관된 장치 이름을 구현합니다. 장치 관리자는 다양한 이름 지정 체계를 지원하며 기본적으로 펌웨어, 토폴로지 및 위치 정보를 기반으로 고정 이름을 할당합니다.

장치 이름을 일관되게 지정하지 않으면 Linux 커널은 고정 접두사와 인덱스를 결합하여 네트워크 인터페이스에 이름을 할당합니다. 커널이 네트워크 장치를 초기화할 때 인덱스가 증가합니다. 예를 들어 eth0 은 시작 시 프로브되는 첫 번째 이더넷 장치를 나타냅니다. 다른 네트워크 인터페이스 컨트롤러를 시스템에 추가하는 경우 재부팅 후 장치가 다른 순서로 초기화될 수 있으므로 커널 장치 이름 할당은 더 이상 수정되지 않습니다. 이 경우 커널은 장치의 이름을 다르게 지정할 수 있습니다.

이 문제를 해결하기 위해 udev 는 일관된 장치 이름을 할당합니다. 다음과 같은 이점이 있습니다.

- 장치 이름은 재부팅 시 안정적입니다.

- 하드웨어를 추가하거나 제거하는 경우에도 장치 이름은 고정됩니다.

- 취약한 하드웨어는 원활하게 교체할 수 있습니다.

- 네트워크 이름 지정은 상태 비저장이며 명시적 구성 파일이 필요하지 않습니다.

일반적으로 Red Hat은 일관된 장치 이름이 비활성화된 시스템을 지원하지 않습니다. 예외에 대한 자세한 내용은 net.ifnames=0 솔루션을 설정하는 것이 안전합니다.

1.1. udev 장치 관리자의 네트워크 인터페이스 이름 변경 방법

네트워크 인터페이스에 대한 일관된 이름 지정 체계를 구현하기 위해 udev 장치 관리자는 다음 규칙 파일을 나열 순서대로 처리합니다.

선택 사항:

/usr/lib/udev/rules.d/60-net.rules이 파일은

initscripts-rename-device패키지를 설치하는 경우에만 존재합니다./usr/lib/udev/rules.d/60-net.rules파일은 더 이상 사용되지 않는/usr/lib/udev/rename_device도우미 유틸리티에서/etc/sysconfig/network-scripts/ifcfg-*파일에서HWADDR매개 변수를 검색하도록 정의합니다. 변수에 설정된 값이 인터페이스의 MAC 주소와 일치하는 경우 도우미 유틸리티는 인터페이스의 이름을ifcfg파일의DEVICE매개변수에 설정된 이름으로 바꿉니다.시스템이 NetworkManager 연결 프로필만 키 파일 형식으로 사용하는 경우

udev는 이 단계를 건너뜁니다.Dell 시스템에서만:

/usr/lib/udev/rules.d/71-biosdevname.rules이 파일은

biosdevname패키지가 설치된 경우에만 존재하며 규칙 파일은biosdevname유틸리티에서 이전 단계에서 이름이 변경되지 않은 경우 이름 지정 정책에 따라 인터페이스 이름을 변경하도록 정의합니다.참고Dell 시스템에만

biosdevname을 설치하고 사용합니다./usr/lib/udev/rules.d/75-net-description.rules이 파일은

udev가 네트워크 인터페이스를 검사하는 방법을 정의하고udev-internal 변수에서 속성을 설정합니다. 그런 다음 이러한 변수는/usr/lib/udev/rules.d/80-net-setup-link.rules파일을 통해 다음 단계에서 처리됩니다. 일부 속성은 정의되지 않을 수 있습니다./usr/lib/udev/rules.d/80-net-setup-link.rules이 파일은

udev서비스의 빌드된net_setup_link를 호출하고udev는/usr/lib/systemd/network/99-default.link파일의NamePolicy매개변수의 정책 순서에 따라 인터페이스의 이름을 바꿉니다. 자세한 내용은 네트워크 인터페이스 이름 지정 정책을 참조하십시오.정책이 적용되지 않으면

udev는 인터페이스의 이름을 바꾸지 않습니다.

추가 리소스

1.2. 네트워크 인터페이스 이름 지정 정책

기본적으로 udev 장치 관리자는 /usr/lib/systemd/network/99-default.link 파일을 사용하여 인터페이스 이름을 변경할 때 적용할 장치 이름 지정 정책을 결정합니다. 이 파일의 NamePolicy 매개변수는 udev 정책에서 사용하는 정책과 순서를 정의합니다.

NamePolicy=keep kernel database onboard slot path

다음 표에서는 NamePolicy 매개변수에서 지정한 대로 가장 먼저 일치하는 정책을 기반으로 udev 의 다양한 작업을 설명합니다.

| 정책 | 설명 | 이름 예 |

|---|---|---|

| keep |

장치에 이미 사용자 공간에 할당된 이름이 있는 경우 | |

| kernel |

커널에서 장치 이름이 예측 가능함을 나타내는 경우 |

|

| 데이터베이스 |

이 정책은 |

|

| 온보드 | 장치 이름은 온보드 장치에 대한 펌웨어 또는 BIOS 제공 인덱스 번호를 통합합니다. |

|

| slot | 장치 이름은 펌웨어 또는 BIOS가 제공하는 PCI Express(PCIe) 핫 플러그 슬롯 인덱스 번호를 통합합니다. |

|

| path | 장치 이름은 하드웨어의 커넥터의 물리적 위치를 통합합니다. |

|

| mac | 장치 이름은 MAC 주소를 통합합니다. 기본적으로 Red Hat Enterprise Linux는 이 정책을 사용하지 않지만 관리자는 이를 활성화할 수 있습니다. |

|

추가 리소스

- udev 장치 관리자의 네트워크 인터페이스 이름 변경 방법

-

systemd.link(5)man page

1.3. 네트워크 인터페이스 이름 지정 체계

udev 장치 관리자는 장치 드라이버가 일관된 장치 이름을 생성하기 위해 제공하는 특정 안정적인 인터페이스 속성을 사용합니다.

새로운 udev 버전이 특정 인터페이스에 대한 이름을 생성하는 방법을 변경하는 경우 Red Hat은 새 스키마 버전을 추가하고 systemd.net-naming-scheme(7) 도움말 페이지의 세부 정보를 문서화합니다. 기본적으로 RHEL(Red Hat Enterprise Linux) 9는 RHEL의 최신 마이너 버전을 설치하거나 업데이트하더라도 rhel-9.0 이름 지정 체계를 사용합니다.

새 드라이버가 네트워크 인터페이스에 대한 추가 또는 기타 속성을 제공하지 못하도록 rhel-net-naming-sysattrs 패키지에서 /usr/lib/udev/hwdb.d/50-net-naming-sysattr-allowlist.hwdb 데이터베이스를 제공합니다. 이 데이터베이스는 udev 서비스가 네트워크 인터페이스 이름을 생성하는 데 사용할 수 있는 sysfs 값을 정의합니다. 데이터베이스의 항목도 버전이 지정되고 스키마 버전의 영향을 받습니다.

RHEL 9.4 이상에서는 모든 rhel-8.* 이름 지정 스키마를 사용할 수도 있습니다.

기본값 이외의 스키마를 사용하려면 네트워크 인터페이스 이름 지정 스키마를 전환할 수 있습니다.

다양한 장치 유형 및 플랫폼의 이름 지정 체계에 대한 자세한 내용은 systemd.net-naming-scheme(7) 매뉴얼 페이지를 참조하십시오.

1.4. 다른 네트워크 인터페이스 이름 지정 체계로 전환

기본적으로 RHEL(Red Hat Enterprise Linux) 9는 RHEL의 최신 마이너 버전을 설치하거나 업데이트하더라도 rhel-9.0 이름 지정 체계를 사용합니다. 기본 이름 지정 스키마는 대부분의 시나리오에 적합하지만 다른 스키마 버전으로 전환해야 하는 이유가 있을 수 있습니다. 예를 들면 다음과 같습니다.

- 새로운 체계는 슬롯 번호와 같은 추가 속성을 인터페이스 이름에 추가하는 경우 장치를 더 잘 식별하는 데 도움이 될 수 있습니다.

-

새로운 체계는

udev가 커널 할당 장치 이름(eth*)으로 대체되지 않도록 할 수 있습니다. 이는 드라이버에서 두 개 이상의 인터페이스에 고유한 특성을 제공하지 않는 경우 고유 이름을 생성하는 경우에 발생합니다.

사전 요구 사항

- 서버의 콘솔에 액세스할 수 있습니다.

절차

네트워크 인터페이스를 나열합니다.

# ip link show 2: eno1: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc fq_codel state UP mode DEFAULT group default qlen 1000 link/ether 00:00:5e:00:53:1a brd ff:ff:ff:ff:ff:ff ...인터페이스의 MAC 주소를 기록합니다.

선택 사항: 네트워크 인터페이스의

ID_NET_NAMING_SCHEME속성을 표시하여 RHEL에서 현재 사용하는 이름 지정 스키마를 식별합니다.# udevadm info --query=property --property=ID_NET_NAMING_SCHEME /sys/class/net/eno1' ID_NET_NAMING_SCHEME=rhel-9.0이 속성은

lo루프백 장치에서 사용할 수 없습니다.net.naming-scheme= <scheme> 옵션을 설치된 모든 커널의 명령줄에 추가합니다. 예를 들면 다음과 같습니다.# grubby --update-kernel=ALL --args=net.naming-scheme=rhel-9.4시스템을 재부팅합니다.

# reboot기록한 MAC 주소에 따라 다른 이름 지정 체계로 인해 변경된 네트워크 인터페이스의 새 이름을 확인합니다.

# ip link show 2: eno1np0: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc fq_codel state UP mode DEFAULT group default qlen 1000 link/ether 00:00:5e:00:53:1a brd ff:ff:ff:ff:ff:ff ...스키마를 전환한 후 이 예제의

udev이름은 MAC 주소가00:00:5e:00:53:1aeno1np0인 장치이며 이전에eno1이라는 이름이 지정되었습니다.이전 이름의 인터페이스를 사용하는 NetworkManager 연결 프로필을 식별합니다.

# nmcli -f device,name connection show DEVICE NAME eno1 example_profile ...연결 프로필의

connection.interface-name속성을 새 인터페이스 이름으로 설정합니다.# nmcli connection modify example_profile connection.interface-name "eno1np0"연결 프로필을 다시 활성화합니다.

# nmcli connection up example_profile

검증

네트워크 인터페이스의

ID_NET_NAMING_SCHEME속성을 표시하여 RHEL에서 사용하는 이름 지정 체계를 식별합니다.# udevadm info --query=property --property=ID_NET_NAMING_SCHEME /sys/class/net/eno1np0' ID_NET_NAMING_SCHEME=_rhel-9.4

추가 리소스

1.5. 설치 중에 이더넷 인터페이스의 접두사 사용자 정의

이더넷 인터페이스에 기본 device-naming 정책을 사용하지 않으려면 RHEL(Red Hat Enterprise Linux) 설치 중에 사용자 지정 장치 접두사를 설정할 수 있습니다.

Red Hat은 RHEL 설치 중에 접두사를 설정하는 경우에만 사용자 지정된 이더넷 접두사가 있는 시스템을 지원합니다. 이미 배포된 시스템에서 prefixdevname 유틸리티를 사용하는 것은 지원되지 않습니다.

설치 중에 장치 접두사를 설정하면 udev 서비스는 설치 후 이더넷 인터페이스에 < prefix><index > 형식을 사용합니다. 예를 들어 접두사 net 을 설정하면 서비스에서 net0 이름,net1 등을 이더넷 인터페이스에 할당합니다.

udev 서비스는 사용자 지정 접두사에 인덱스를 추가하고 알려진 이더넷 인터페이스의 인덱스 값을 유지합니다. 인터페이스를 추가하면 udev 에서 이전에 할당한 인덱스 값보다 큰 인덱스 값을 새 인터페이스에 할당합니다.

사전 요구 사항

- 접두사는 ASCII 문자로 구성됩니다.

- 접두사는 영숫자 문자열입니다.

- 접두사는 16자보다 짧습니다.

-

접두사는

eth,eno,ens및em과 같은 잘 알려진 다른 네트워크 인터페이스 접두사와 충돌하지 않습니다.

절차

- Red Hat Enterprise Linux 설치 미디어를 부팅합니다.

부팅 관리자에서 다음 단계를 수행합니다.

-

Install Red Hat Enterprise Linux < version>항목을 선택합니다. - Tab 을 눌러 항목을 편집합니다.

-

커널 옵션에

net.ifnames.prefix= <prefix>를 추가합니다. - Enter 를 눌러 설치 프로그램을 시작합니다.

-

- Red Hat Enterprise Linux 설치.

검증

인터페이스 이름을 확인하려면 네트워크 인터페이스를 표시합니다.

# ip link show ... 2: net0: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc fq_codel state UP mode DEFAULT group default qlen 1000 link/ether 00:00:5e:00:53:1a brd ff:ff:ff:ff:ff:ff ...

추가 리소스

1.6. udev 규칙을 사용하여 사용자 정의 네트워크 인터페이스 이름 구성

udev 규칙을 사용하여 조직의 요구 사항을 반영하는 사용자 지정 네트워크 인터페이스 이름을 구현할 수 있습니다.

절차

이름을 변경할 네트워크 인터페이스를 확인합니다.

# ip link show ... enp1s0: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc fq_codel state UP mode DEFAULT group default qlen 1000 link/ether 00:00:5e:00:53:1a brd ff:ff:ff:ff:ff:ff ...인터페이스의 MAC 주소를 기록합니다.

인터페이스의 장치 유형 ID를 표시합니다.

# cat /sys/class/net/enp1s0/type 1/etc/udev/rules.d/70-persistent-net.rules파일을 생성하고 이름을 변경할 각 인터페이스에 대한 규칙을 추가합니다.SUBSYSTEM=="net",ACTION=="add",ATTR{address}=="<MAC_address>",ATTR{type}=="<device_type_id>",NAME="<new_interface_name>"중요부팅 프로세스 중에 일관된 장치 이름이 필요한 경우

70-persistent-net.rules만 파일 이름으로 사용합니다. RAM 디스크 이미지를 다시 생성하는 경우dracut유틸리티는 이 이름의 파일을initrd이미지에 추가합니다.예를 들어 다음 규칙을 사용하여 MAC 주소

00:00:5e:53:1a로 인터페이스의이름을provider0으로 변경합니다.SUBSYSTEM=="net",ACTION=="add",ATTR{address}=="00:00:5e:00:53:1a",ATTR{type}=="1",NAME="provider0"선택 사항:

initrdRAM 디스크 이미지를 다시 생성합니다.# dracut -f이 단계는 RAM 디스크에 네트워킹 기능이 필요한 경우에만 필요합니다. 예를 들어 루트 파일 시스템이 iSCSI와 같은 네트워크 장치에 저장된 경우입니다.

이름을 바꿀 인터페이스를 사용하는 NetworkManager 연결 프로필을 식별합니다.

# nmcli -f device,name connection show DEVICE NAME enp1s0 example_profile ...연결 프로필에서

connection.interface-name속성을 설정 해제합니다.# nmcli connection modify example_profile connection.interface-name ""임시로 새 인터페이스 이름과 이전 인터페이스 이름과 일치하도록 연결 프로필을 구성합니다.

# nmcli connection modify example_profile match.interface-name "provider0 enp1s0"시스템을 재부팅합니다.

# reboot링크 파일에 지정한 MAC 주소가 있는 장치의 이름이

provider0으로 변경되었는지 확인합니다.# ip link show provider0: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc mq state UP mode DEFAULT group default qlen 1000 link/ether 00:00:5e:00:53:1a brd ff:ff:ff:ff:ff:ff ...새 인터페이스 이름만 일치하도록 연결 프로필을 구성합니다.

# nmcli connection modify example_profile match.interface-name "provider0"이제 연결 프로필에서 이전 인터페이스 이름을 삭제했습니다.

연결 프로필을 다시 활성화합니다.

# nmcli connection up example_profile

추가 리소스

-

udev(7)man page

1.7. systemd 링크 파일을 사용하여 사용자 정의 네트워크 인터페이스 이름 구성

systemd 링크 파일을 사용하여 조직의 요구 사항을 반영하는 사용자 지정 네트워크 인터페이스 이름을 구현할 수 있습니다.

사전 요구 사항

- 다음 조건 중 하나를 충족해야 합니다. NetworkManager는 이 인터페이스를 관리하지 않거나 해당 연결 프로파일에서는 키 파일 형식을 사용합니다.

절차

이름을 변경할 네트워크 인터페이스를 확인합니다.

# ip link show ... enp1s0: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc fq_codel state UP mode DEFAULT group default qlen 1000 link/ether 00:00:5e:00:53:1a brd ff:ff:ff:ff:ff:ff ...인터페이스의 MAC 주소를 기록합니다.

아직 없는 경우

/etc/systemd/network/디렉터리를 만듭니다.# mkdir -p /etc/systemd/network/이름을 바꿀 각 인터페이스에 대해 다음 콘텐츠를 사용하여

/etc/systemd/network/디렉터리에70-*.link파일을 생성합니다.[Match] MACAddress=<MAC_address> [Link] Name=<new_interface_name>

중요70접두사가 있는 파일 이름을 사용하여udev규칙 기반 솔루션과 일치하는 파일 이름을 유지합니다.예를 들어 다음 내용으로

/etc/systemd/network/70-파일을 생성하여 인터페이스의 이름을provider0.link00:00:5e:00:53:1a로 변경합니다.[Match] MACAddress=00:00:5e:00:53:1a [Link] Name=provider0

선택 사항:

initrdRAM 디스크 이미지를 다시 생성합니다.# dracut -f이 단계는 RAM 디스크에 네트워킹 기능이 필요한 경우에만 필요합니다. 예를 들어 루트 파일 시스템이 iSCSI와 같은 네트워크 장치에 저장된 경우입니다.

이름을 바꿀 인터페이스를 사용하는 NetworkManager 연결 프로필을 식별합니다.

# nmcli -f device,name connection show DEVICE NAME enp1s0 example_profile ...연결 프로필에서

connection.interface-name속성을 설정 해제합니다.# nmcli connection modify example_profile connection.interface-name ""임시로 새 인터페이스 이름과 이전 인터페이스 이름과 일치하도록 연결 프로필을 구성합니다.

# nmcli connection modify example_profile match.interface-name "provider0 enp1s0"시스템을 재부팅합니다.

# reboot링크 파일에 지정한 MAC 주소가 있는 장치의 이름이

provider0으로 변경되었는지 확인합니다.# ip link show provider0: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc mq state UP mode DEFAULT group default qlen 1000 link/ether 00:00:5e:00:53:1a brd ff:ff:ff:ff:ff:ff ...새 인터페이스 이름만 일치하도록 연결 프로필을 구성합니다.

# nmcli connection modify example_profile match.interface-name "provider0"이제 연결 프로필에서 이전 인터페이스 이름을 삭제했습니다.

연결 프로필을 다시 활성화합니다.

# nmcli connection up example_profile

추가 리소스

-

systemd.link(5)man page

1.8. systemd 링크 파일을 사용하여 네트워크 인터페이스에 대체 이름 할당

대체 인터페이스 이름을 지정하면 커널에서 네트워크 인터페이스에 추가 이름을 할당할 수 있습니다. 네트워크 인터페이스 이름이 필요한 명령에서 일반 인터페이스 이름과 동일한 방식으로 이러한 대체 이름을 사용할 수 있습니다.

사전 요구 사항

- 대체 이름으로 ASCII 문자를 사용해야 합니다.

- 대체 이름은 128자 이상이어야 합니다.

절차

네트워크 인터페이스 이름과 해당 MAC 주소를 표시합니다.

# ip link show ... enp1s0: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc fq_codel state UP mode DEFAULT group default qlen 1000 link/ether 00:00:5e:00:53:1a brd ff:ff:ff:ff:ff:ff ...대체 이름을 할당할 인터페이스의 MAC 주소를 기록합니다.

아직 없는 경우

/etc/systemd/network/디렉터리를 만듭니다.# mkdir -p /etc/systemd/network/대체 이름이 필요한 각 인터페이스에 대해 다음 콘텐츠를 사용하여

/etc/systemd/network/디렉터리에*.link파일을 생성합니다.[Match] MACAddress=<MAC_address> [Link] AlternativeName=<alternative_interface_name_1> AlternativeName=<alternative_interface_name_2> AlternativeName=<alternative_interface_name_n>

예를 들어 다음 콘텐츠를 사용하여

/etc/systemd/network/70-altname.link파일을 생성하여 MAC 주소00:00:5e:53:1a가 있는 인터페이스에공급자를 다른 이름으로 할당합니다.[Match] MACAddress=00:00:5e:00:53:1a [Link] AlternativeName=provider

initrdRAM 디스크 이미지를 다시 생성합니다.# dracut -f시스템을 재부팅합니다.

# reboot

검증

대체 인터페이스 이름을 사용합니다. 예를 들어 대체 이름

공급자가있는 장치의 IP 주소 설정을 표시합니다.# ip address show provider 2: enp1s0: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc fq_codel state UP group default qlen 1000 link/ether 00:00:5e:00:53:1a brd ff:ff:ff:ff:ff:ff altname provider ...

2장. 이더넷 연결 구성

NetworkManager는 호스트에 설치된 각 이더넷 어댑터에 대한 연결 프로필을 생성합니다. 기본적으로 이 프로필은 IPv4 및 IPv6 연결에 DHCP를 사용합니다. 자동으로 생성된 이 프로필을 수정하거나 다음 경우 새 프로필을 추가합니다.

- 네트워크에는 고정 IP 주소 구성과 같은 사용자 지정 설정이 필요합니다.

- 서로 다른 네트워크 간에 호스트가 순환되므로 여러 프로필이 필요합니다.

Red Hat Enterprise Linux는 관리자에게 이더넷 연결을 구성하는 다양한 옵션을 제공합니다. 예를 들면 다음과 같습니다.

-

nmcli를 사용하여 명령줄에서 연결을 구성합니다. -

nmtui를 사용하여 텍스트 기반 사용자 인터페이스에서 연결을 구성합니다. -

GNOME 설정 메뉴 또는

nm-connection-editor애플리케이션을 사용하여 그래픽 인터페이스에서 연결을 구성합니다. -

nmstatectl을 사용하여 Nmstate API를 통한 연결을 구성합니다. - RHEL 시스템 역할을 사용하여 하나 이상의 호스트에서 연결 구성을 자동화합니다.

Microsoft Azure 클라우드에서 실행되는 호스트에서 이더넷 연결을 수동으로 구성하려면 cloud-init 서비스를 비활성화하거나 클라우드 환경에서 검색된 네트워크 설정을 무시하도록 구성합니다. 그렇지 않으면 cloud-init 가 수동으로 구성된 다음 네트워크 설정을 재부팅할 때 재정의됩니다.

2.1. nmcli를 사용하여 이더넷 연결 구성

이더넷을 통해 호스트를 네트워크에 연결하는 경우 nmcli 유틸리티를 사용하여 명령줄에서 연결의 설정을 관리할 수 있습니다.

사전 요구 사항

- 물리적 또는 가상 이더넷 NIC(네트워크 인터페이스 컨트롤러)가 서버 구성에 있습니다.

절차

NetworkManager 연결 프로필을 나열합니다.

# nmcli connection show NAME UUID TYPE DEVICE Wired connection 1 a5eb6490-cc20-3668-81f8-0314a27f3f75 ethernet enp1s0기본적으로 NetworkManager는 호스트의 각 NIC에 대한 프로필을 생성합니다. 이 NIC를 특정 네트워크에만 연결하려는 경우 자동으로 생성된 프로필을 조정합니다. 이 NIC를 다른 설정으로 네트워크에 연결하려는 경우 각 네트워크에 대한 개별 프로필을 생성합니다.

추가 연결 프로필을 생성하려면 다음을 입력합니다.

# nmcli connection add con-name <connection-name> ifname <device-name> type ethernet기존 프로필을 수정하려면 이 단계를 건너뜁니다.

선택 사항: 연결 프로필의 이름을 변경합니다.

# nmcli connection modify "Wired connection 1" connection.id "Internal-LAN"프로필이 여러 개인 호스트에서 의미 있는 이름을 사용하면 프로필의 용도를 쉽게 식별할 수 있습니다.

연결 프로필의 현재 설정을 표시합니다.

# nmcli connection show Internal-LAN ... connection.interface-name: enp1s0 connection.autoconnect: yes ipv4.method: auto ipv6.method: auto ...IPv4 설정을 구성합니다.

DHCP를 사용하려면 다음을 입력합니다.

# nmcli connection modify Internal-LAN ipv4.method autoipv4.method가 이미auto(기본값)로 설정된 경우 이 단계를 건너뜁니다.정적 IPv4 주소, 네트워크 마스크, 기본 게이트웨이, DNS 서버 및 검색 도메인을 설정하려면 다음을 입력합니다.

# nmcli connection modify Internal-LAN ipv4.method manual ipv4.addresses 192.0.2.1/24 ipv4.gateway 192.0.2.254 ipv4.dns 192.0.2.200 ipv4.dns-search example.com

IPv6 설정을 구성합니다.

SLAAC(상태 비저장 주소 자동 구성)를 사용하려면 다음을 입력합니다.

# nmcli connection modify Internal-LAN ipv6.method autoipv6.method가 이미auto(기본값)로 설정된 경우 이 단계를 건너뜁니다.정적 IPv6 주소, 네트워크 마스크, 기본 게이트웨이, DNS 서버 및 검색 도메인을 설정하려면 다음을 입력합니다.

# nmcli connection modify Internal-LAN ipv6.method manual ipv6.addresses 2001:db8:1::fffe/64 ipv6.gateway 2001:db8:1::fffe ipv6.dns 2001:db8:1::ffbb ipv6.dns-search example.com

프로필의 다른 설정을 사용자 지정하려면 다음 명령을 사용합니다.

# nmcli connection modify <connection-name> <setting> <value>값을 따옴표로 묶거나 spaces로 묶습니다.

프로필을 활성화합니다.

# nmcli connection up Internal-LAN

검증

NIC의 IP 설정을 표시합니다.

# ip address show enp1s0 2: enp1s0: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc fq_codel state UP group default qlen 1000 link/ether 52:54:00:17:b8:b6 brd ff:ff:ff:ff:ff:ff inet 192.0.2.1/24 brd 192.0.2.255 scope global noprefixroute enp1s0 valid_lft forever preferred_lft forever inet6 2001:db8:1::fffe/64 scope global noprefixroute valid_lft forever preferred_lft foreverIPv4 기본 게이트웨이를 표시합니다.

# ip route show default default via 192.0.2.254 dev enp1s0 proto static metric 102IPv6 기본 게이트웨이를 표시합니다.

# ip -6 route show default default via 2001:db8:1::ffee dev enp1s0 proto static metric 102 pref mediumDNS 설정을 표시합니다.

# cat /etc/resolv.conf search example.com nameserver 192.0.2.200 nameserver 2001:db8:1::ffbb여러 연결 프로필이 동시에 활성화된 경우

이름 서버항목의 순서는 이러한 프로필의 DNS 우선 순위 값과 연결 유형에 따라 달라집니다.ping유틸리티를 사용하여 이 호스트가 다른 호스트에 패킷을 보낼 수 있는지 확인합니다.# ping <host-name-or-IP-address>

문제 해결

- 네트워크 커넥터가 호스트와 스위치에 연결되어 있는지 확인합니다.

- 링크 실패가 이 호스트에만 있는지 또는 동일한 스위치에 연결된 다른 호스트에 있는지 확인합니다.

- 네트워크케이블 및 네트워크 인터페이스가 예상대로 작동하는지 확인합니다. 하드웨어 진단 단계를 수행하고 결함 variables 및 네트워크 인터페이스 카드를 교체합니다.

- 디스크의 구성이 장치의 구성과 일치하지 않는 경우 NetworkManager를 시작하거나 다시 시작하면 장치의 구성을 반영하는 메모리 내 연결이 생성됩니다. 자세한 내용과 이 문제를 방지하는 방법은 NetworkManager 서비스 솔루션을 다시 시작한 후 NetworkManager 연결 중복을 참조하십시오.

추가 리소스

-

nm-settings(5) 도움말페이지

2.2. nmcli 대화형 편집기를 사용하여 이더넷 연결 구성

이더넷을 통해 호스트를 네트워크에 연결하는 경우 nmcli 유틸리티를 사용하여 명령줄에서 연결의 설정을 관리할 수 있습니다.

사전 요구 사항

- 물리적 또는 가상 이더넷 NIC(네트워크 인터페이스 컨트롤러)가 서버 구성에 있습니다.

절차

NetworkManager 연결 프로필을 나열합니다.

# nmcli connection show NAME UUID TYPE DEVICE Wired connection 1 a5eb6490-cc20-3668-81f8-0314a27f3f75 ethernet enp1s0기본적으로 NetworkManager는 호스트의 각 NIC에 대한 프로필을 생성합니다. 이 NIC를 특정 네트워크에만 연결하려는 경우 자동으로 생성된 프로필을 조정합니다. 이 NIC를 다른 설정으로 네트워크에 연결하려는 경우 각 네트워크에 대한 개별 프로필을 생성합니다.

대화형 모드에서

nmcli를 시작합니다.추가 연결 프로필을 생성하려면 다음을 입력합니다.

# nmcli connection edit type ethernet con-name "<connection-name>"기존 연결 프로필을 수정하려면 다음을 입력합니다.

# nmcli connection edit con-name "<connection-name>"

선택 사항: 연결 프로필의 이름을 변경합니다.

nmcli> set connection.id Internal-LAN프로필이 여러 개인 호스트에서 의미 있는 이름을 사용하면 프로필의 용도를 쉽게 식별할 수 있습니다.

nmcli가 이름의 따옴표 부분을 만들지 않도록 공백이 포함된 ID를 설정하는 데 따옴표를 사용하지 마십시오. 예를 들어 예제 연결을 ID로 설정하려면set connection.id을 입력합니다.Example Connection연결 프로필의 현재 설정을 표시합니다.

nmcli> print ... connection.interface-name: enp1s0 connection.autoconnect: yes ipv4.method: auto ipv6.method: auto ...새 연결 프로필을 생성하는 경우 네트워크 인터페이스를 설정합니다.

nmcli> set connection.interface-name enp1s0IPv4 설정을 구성합니다.

DHCP를 사용하려면 다음을 입력합니다.

nmcli> set ipv4.method autoipv4.method가 이미auto(기본값)로 설정된 경우 이 단계를 건너뜁니다.정적 IPv4 주소, 네트워크 마스크, 기본 게이트웨이, DNS 서버 및 검색 도메인을 설정하려면 다음을 입력합니다.

nmcli> ipv4.addresses 192.0.2.1/24 Do you also want to set 'ipv4.method' to 'manual'? [yes]: yes nmcli> ipv4.gateway 192.0.2.254 nmcli> ipv4.dns 192.0.2.200 nmcli> ipv4.dns-search example.com

IPv6 설정을 구성합니다.

SLAAC(상태 비저장 주소 자동 구성)를 사용하려면 다음을 입력합니다.

nmcli> set ipv6.method autoipv6.method가 이미auto(기본값)로 설정된 경우 이 단계를 건너뜁니다.정적 IPv6 주소, 네트워크 마스크, 기본 게이트웨이, DNS 서버 및 검색 도메인을 설정하려면 다음을 입력합니다.

nmcli> ipv6.addresses 2001:db8:1::fffe/64 Do you also want to set 'ipv6.method' to 'manual'? [yes]: yes nmcli> ipv6.gateway 2001:db8:1::fffe nmcli> ipv6.dns 2001:db8:1::ffbb nmcli> ipv6.dns-search example.com

연결을 저장하고 활성화합니다.

nmcli> save persistent대화형 모드를 종료합니다.

nmcli> quit

검증

NIC의 IP 설정을 표시합니다.

# ip address show enp1s0 2: enp1s0: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc fq_codel state UP group default qlen 1000 link/ether 52:54:00:17:b8:b6 brd ff:ff:ff:ff:ff:ff inet 192.0.2.1/24 brd 192.0.2.255 scope global noprefixroute enp1s0 valid_lft forever preferred_lft forever inet6 2001:db8:1::fffe/64 scope global noprefixroute valid_lft forever preferred_lft foreverIPv4 기본 게이트웨이를 표시합니다.

# ip route show default default via 192.0.2.254 dev enp1s0 proto static metric 102IPv6 기본 게이트웨이를 표시합니다.

# ip -6 route show default default via 2001:db8:1::ffee dev enp1s0 proto static metric 102 pref mediumDNS 설정을 표시합니다.

# cat /etc/resolv.conf search example.com nameserver 192.0.2.200 nameserver 2001:db8:1::ffbb여러 연결 프로필이 동시에 활성화된 경우

이름 서버항목의 순서는 이러한 프로필의 DNS 우선 순위 값과 연결 유형에 따라 달라집니다.ping유틸리티를 사용하여 이 호스트가 다른 호스트에 패킷을 보낼 수 있는지 확인합니다.# ping <host-name-or-IP-address>

문제 해결

- 네트워크 커넥터가 호스트와 스위치에 연결되어 있는지 확인합니다.

- 링크 실패가 이 호스트에만 있는지 또는 동일한 스위치에 연결된 다른 호스트에 있는지 확인합니다.

- 네트워크케이블 및 네트워크 인터페이스가 예상대로 작동하는지 확인합니다. 하드웨어 진단 단계를 수행하고 결함 variables 및 네트워크 인터페이스 카드를 교체합니다.

- 디스크의 구성이 장치의 구성과 일치하지 않는 경우 NetworkManager를 시작하거나 다시 시작하면 장치의 구성을 반영하는 메모리 내 연결이 생성됩니다. 자세한 내용과 이 문제를 방지하는 방법은 NetworkManager 서비스 솔루션을 다시 시작한 후 NetworkManager 연결 중복을 참조하십시오.

추가 리소스

-

nm-settings(5) 도움말페이지 -

nmcli(1) 도움말페이지

2.3. nmtui를 사용하여 이더넷 연결 구성

이더넷을 통해 호스트를 네트워크에 연결하는 경우 nmtui 애플리케이션을 사용하여 텍스트 기반 사용자 인터페이스에서 연결의 설정을 관리할 수 있습니다. nmtui 를 사용하여 새 프로필을 만들고 그래픽 인터페이스 없이 호스트에서 기존 프로필을 업데이트합니다.

nmtui 에서 :

- 커서 키를 사용하여 이동합니다.

- 버튼을 선택하고 Enter 를 누릅니다.

- Space 를 사용하여 확인란을 선택하고 지웁니다.

사전 요구 사항

- 물리적 또는 가상 이더넷 NIC(네트워크 인터페이스 컨트롤러)가 서버 구성에 있습니다.

절차

연결에 사용할 네트워크 장치 이름을 모르는 경우 사용 가능한 장치를 표시합니다.

# nmcli device status DEVICE TYPE STATE CONNECTION enp1s0 ethernet unavailable -- ...start

nmtui:# nmtui- Edit a connection 을 선택하고 Enter 를 누릅니다.

새 연결 프로필을 추가하거나 기존 프로필을 수정할지 선택합니다.

새 프로필을 생성하려면 다음을 수행합니다.

- 추가를 누릅니다.

- 네트워크 유형 목록에서 이더넷 을 선택하고 Enter 키를 누릅니다.

- 기존 프로필을 수정하려면 목록에서 프로필을 선택하고 Enter 키를 누릅니다.

선택 사항: 연결 프로필의 이름을 업데이트합니다.

프로필이 여러 개인 호스트에서 의미 있는 이름을 사용하면 프로필의 용도를 쉽게 식별할 수 있습니다.

- 새 연결 프로필을 생성하는 경우 장치 필드에 네트워크 장치 이름을 입력합니다.

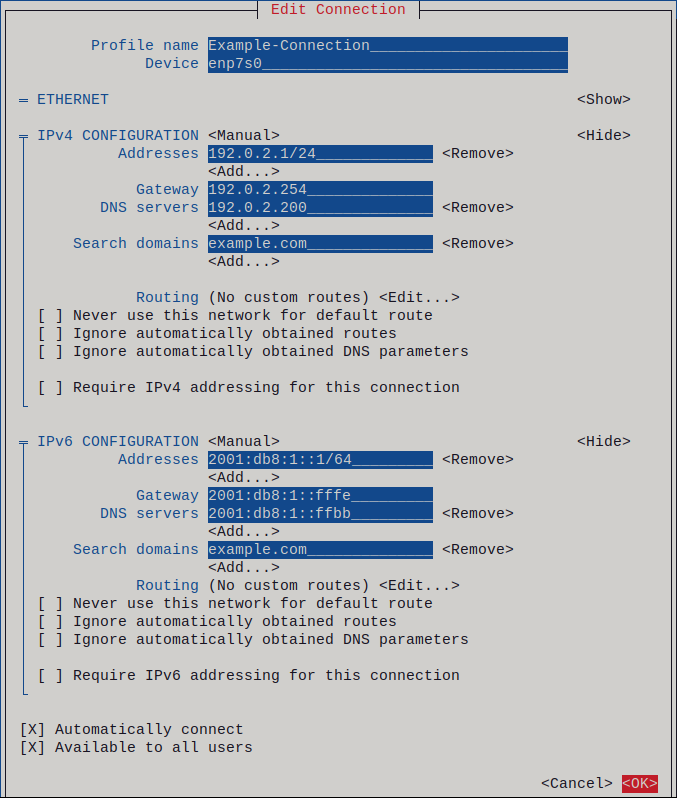

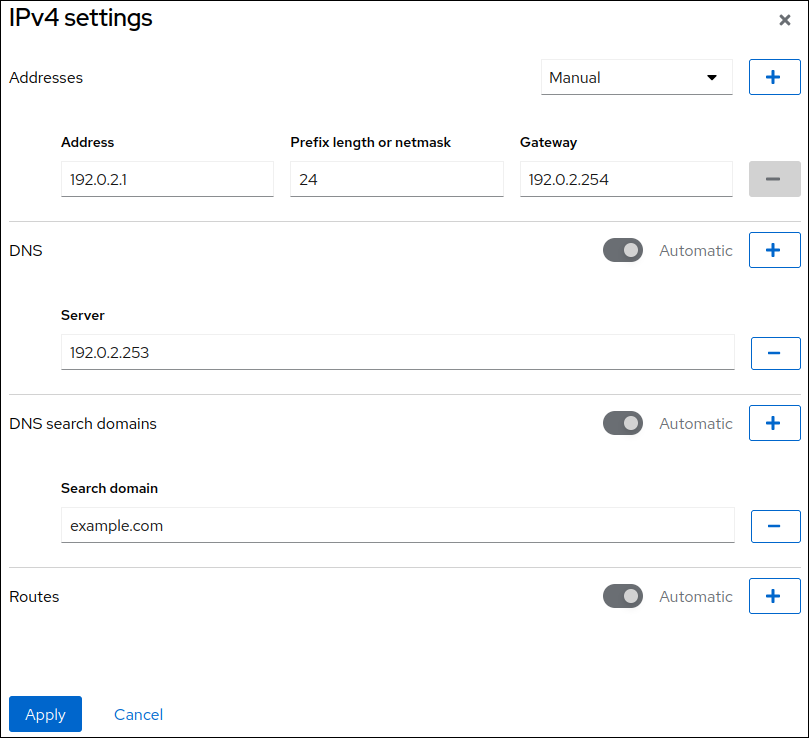

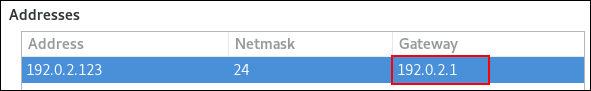

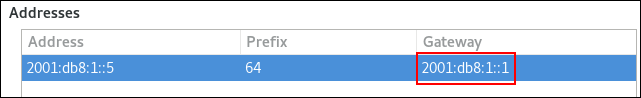

환경에 따라

IPv4 구성 및영역에서 IP 주소 설정을 적절하게 구성합니다. 이를 위해 다음 영역 옆에 있는 버튼을 누른 후 다음을 선택합니다.IPv6 구성- 비활성화됨 (이 연결에 IP 주소가 필요하지 않은 경우).

- 자동으로 DHCP 서버가 이 NIC에 IP 주소를 동적으로 할당하는 경우입니다.

수동: 네트워크에 고정 IP 주소 설정이 필요한 경우입니다. 이 경우 추가 필드를 작성해야 합니다.

- 추가 필드를 표시하도록 구성할 프로토콜 옆에 Show 를 누릅니다.

주소 옆에 있는 추가 를 클릭하고 CIDR(Classless Inter-Domain Routing) 형식으로 IP 주소와 서브넷 마스크를 입력합니다.

서브넷 마스크를 지정하지 않으면 NetworkManager는 IPv4 주소에 대해

/32서브넷 마스크와 IPv6 주소에 대해/64를 설정합니다.- 기본 게이트웨이의 주소를 입력합니다.

- DNS 서버 옆에 있는 추가 를 클릭하고 DNS 서버 주소를 입력합니다.

- 검색 도메인 옆에 있는 추가 를 클릭하고 DNS 검색 도메인을 입력합니다.

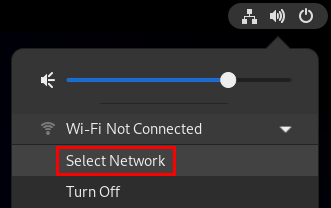

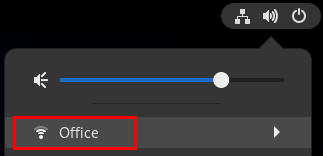

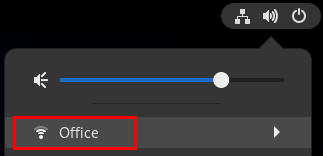

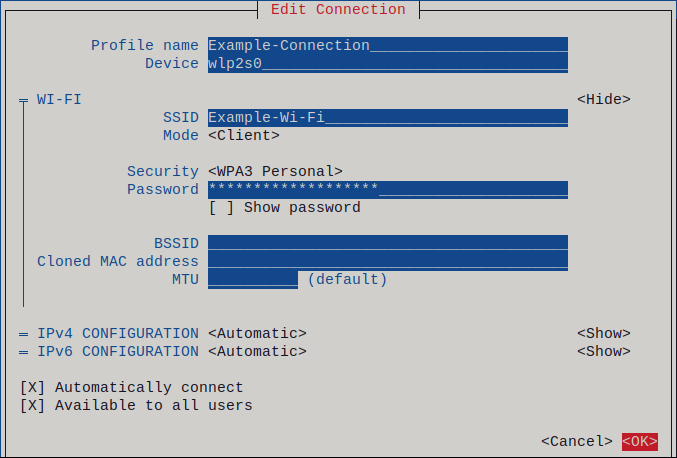

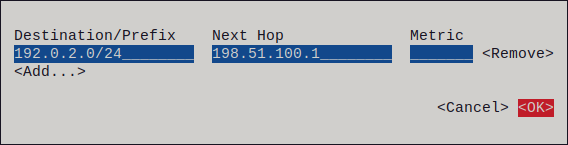

그림 2.1. 고정 IP 주소 설정을 사용하는 이더넷 연결의 예

- OK 를 눌러 새 연결을 만들고 자동으로 활성화합니다.

- 다시 키를 눌러 기본 메뉴로 돌아갑니다.

-

Quit 를 선택하고 Enter 를 눌러

nmtui애플리케이션을 종료합니다.

검증

NIC의 IP 설정을 표시합니다.

# ip address show enp1s0 2: enp1s0: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc fq_codel state UP group default qlen 1000 link/ether 52:54:00:17:b8:b6 brd ff:ff:ff:ff:ff:ff inet 192.0.2.1/24 brd 192.0.2.255 scope global noprefixroute enp1s0 valid_lft forever preferred_lft forever inet6 2001:db8:1::fffe/64 scope global noprefixroute valid_lft forever preferred_lft foreverIPv4 기본 게이트웨이를 표시합니다.

# ip route show default default via 192.0.2.254 dev enp1s0 proto static metric 102IPv6 기본 게이트웨이를 표시합니다.

# ip -6 route show default default via 2001:db8:1::ffee dev enp1s0 proto static metric 102 pref mediumDNS 설정을 표시합니다.

# cat /etc/resolv.conf search example.com nameserver 192.0.2.200 nameserver 2001:db8:1::ffbb여러 연결 프로필이 동시에 활성화된 경우

이름 서버항목의 순서는 이러한 프로필의 DNS 우선 순위 값과 연결 유형에 따라 달라집니다.ping유틸리티를 사용하여 이 호스트가 다른 호스트에 패킷을 보낼 수 있는지 확인합니다.# ping <host-name-or-IP-address>

문제 해결

- 네트워크 커넥터가 호스트와 스위치에 연결되어 있는지 확인합니다.

- 링크 실패가 이 호스트에만 있는지 또는 동일한 스위치에 연결된 다른 호스트에 있는지 확인합니다.

- 네트워크케이블 및 네트워크 인터페이스가 예상대로 작동하는지 확인합니다. 하드웨어 진단 단계를 수행하고 결함 variables 및 네트워크 인터페이스 카드를 교체합니다.

- 디스크의 구성이 장치의 구성과 일치하지 않는 경우 NetworkManager를 시작하거나 다시 시작하면 장치의 구성을 반영하는 메모리 내 연결이 생성됩니다. 자세한 내용과 이 문제를 방지하는 방법은 NetworkManager 서비스 솔루션을 다시 시작한 후 NetworkManager 연결 중복을 참조하십시오.

2.4. control-center를 사용하여 이더넷 연결 구성

이더넷을 통해 호스트를 네트워크에 연결하는 경우 GNOME 설정 메뉴를 사용하여 그래픽 인터페이스로 연결의 설정을 관리할 수 있습니다.

control-center 는 nm-connection-editor 애플리케이션 또는 nmcli 유틸리티만큼 많은 구성 옵션을 지원하지 않습니다.

사전 요구 사항

- 물리적 또는 가상 이더넷 NIC(네트워크 인터페이스 컨트롤러)가 서버 구성에 있습니다.

- GNOME이 설치되어 있어야 합니다.

절차

-

Super 키를 눌러

Settings을 입력하고 Enter 를 누릅니다. - 왼쪽의 탐색에서 네트워크를 선택합니다.

새 연결 프로필을 추가하거나 기존 프로필을 수정할지 선택합니다.

- 새 프로필을 생성하려면 이더넷 항목 옆에 있는 + 버튼을 클릭합니다.

- 기존 프로필을 수정하려면 프로필 항목 옆에 있는 장비 아이콘을 클릭합니다.

선택 사항: ID 탭에서 연결 프로필의 이름을 업데이트합니다.

프로필이 여러 개인 호스트에서 의미 있는 이름을 사용하면 프로필의 용도를 쉽게 식별할 수 있습니다.

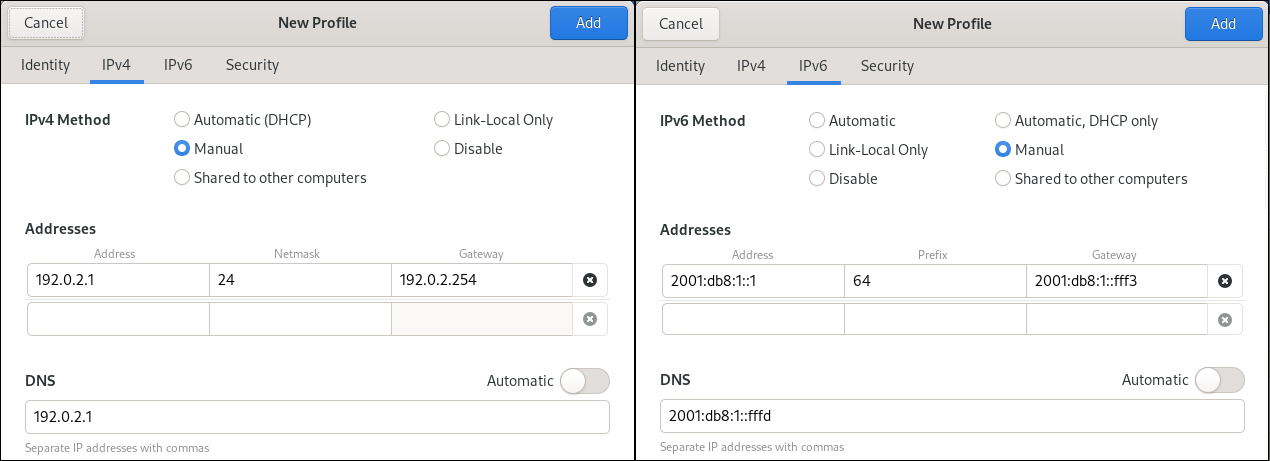

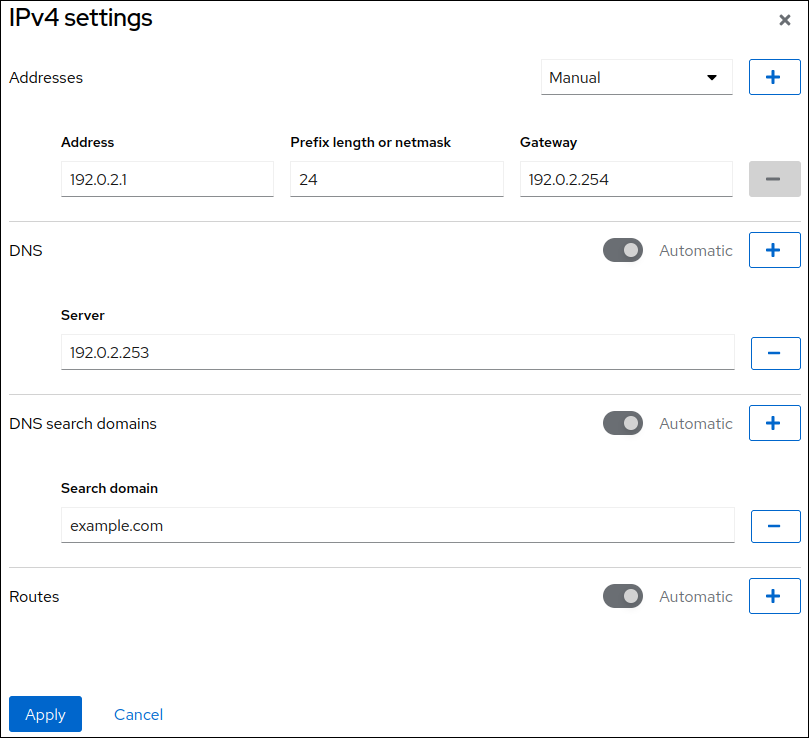

환경에 따라 그에 따라 IPv4 및 IPv6 탭의 IP 주소 설정을 구성합니다.

-

DHCP 또는 IPv6 SLAAC(상태 비저장 주소 자동 구성)를 사용하려면

자동(DHCP)을 메서드(기본값)로 선택합니다. 고정 IP 주소, 네트워크 마스크, 기본 게이트웨이, DNS 서버 및 검색 도메인을 설정하려면

Manual을 메서드로 선택하고 탭의 필드를 작성합니다.

-

DHCP 또는 IPv6 SLAAC(상태 비저장 주소 자동 구성)를 사용하려면

연결 프로필을 추가하거나 수정할지 여부에 따라 추가 또는 적용 버튼을 클릭하여 연결을 저장합니다.

GNOME

control-center가 연결을 자동으로 활성화합니다.

검증

NIC의 IP 설정을 표시합니다.

# ip address show enp1s0 2: enp1s0: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc fq_codel state UP group default qlen 1000 link/ether 52:54:00:17:b8:b6 brd ff:ff:ff:ff:ff:ff inet 192.0.2.1/24 brd 192.0.2.255 scope global noprefixroute enp1s0 valid_lft forever preferred_lft forever inet6 2001:db8:1::fffe/64 scope global noprefixroute valid_lft forever preferred_lft foreverIPv4 기본 게이트웨이를 표시합니다.

# ip route show default default via 192.0.2.254 dev enp1s0 proto static metric 102IPv6 기본 게이트웨이를 표시합니다.

# ip -6 route show default default via 2001:db8:1::ffee dev enp1s0 proto static metric 102 pref mediumDNS 설정을 표시합니다.

# cat /etc/resolv.conf search example.com nameserver 192.0.2.200 nameserver 2001:db8:1::ffbb여러 연결 프로필이 동시에 활성화된 경우

이름 서버항목의 순서는 이러한 프로필의 DNS 우선 순위 값과 연결 유형에 따라 달라집니다.ping유틸리티를 사용하여 이 호스트가 다른 호스트에 패킷을 보낼 수 있는지 확인합니다.# ping <host-name-or-IP-address>

문제 해결 단계

- 네트워크 커넥터가 호스트와 스위치에 연결되어 있는지 확인합니다.

- 링크 실패가 이 호스트에만 있는지 또는 동일한 스위치에 연결된 다른 호스트에 있는지 확인합니다.

- 네트워크케이블 및 네트워크 인터페이스가 예상대로 작동하는지 확인합니다. 하드웨어 진단 단계를 수행하고 결함 variables 및 네트워크 인터페이스 카드를 교체합니다.

- 디스크의 구성이 장치의 구성과 일치하지 않는 경우 NetworkManager를 시작하거나 다시 시작하면 장치의 구성을 반영하는 메모리 내 연결이 생성됩니다. 자세한 내용과 이 문제를 방지하는 방법은 NetworkManager 서비스 솔루션을 다시 시작한 후 NetworkManager 연결 중복을 참조하십시오.

2.5. nm-connection-editor를 사용하여 이더넷 연결 구성

이더넷을 통해 호스트를 네트워크에 연결하는 경우 nm-connection-editor 애플리케이션을 사용하여 그래픽 인터페이스로 연결의 설정을 관리할 수 있습니다.

사전 요구 사항

- 물리적 또는 가상 이더넷 NIC(네트워크 인터페이스 컨트롤러)가 서버 구성에 있습니다.

- GNOME이 설치되어 있어야 합니다.

절차

터미널을 열고 다음을 입력합니다.

$ nm-connection-editor새 연결 프로필을 추가하거나 기존 프로필을 수정할지 선택합니다.

새 프로필을 생성하려면 다음을 수행합니다.

- + 버튼을 클릭합니다.

- 연결 유형으로 이더넷 을 선택하고 생성 을 클릭합니다.

- 기존 프로필을 수정하려면 프로필 항목을 두 번 클릭합니다.

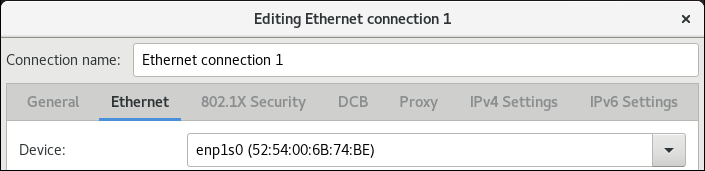

선택 사항: 연결 이름 필드에 있는 프로필 이름을 업데이트합니다.

프로필이 여러 개인 호스트에서 의미 있는 이름을 사용하면 프로필의 용도를 쉽게 식별할 수 있습니다.

새 프로필을 생성하는 경우

이더넷탭에서 장치를 선택합니다.

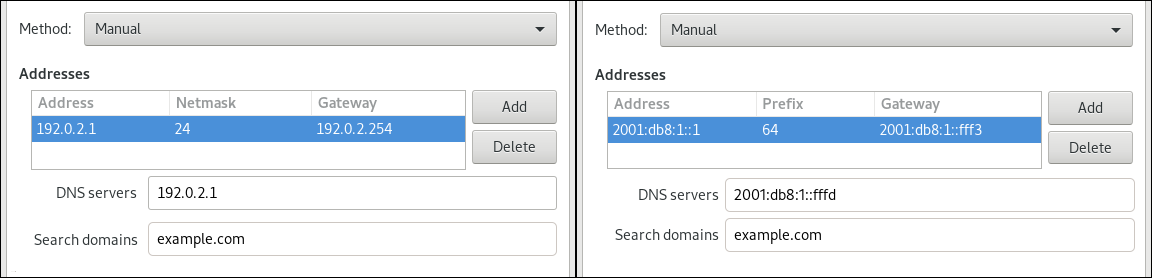

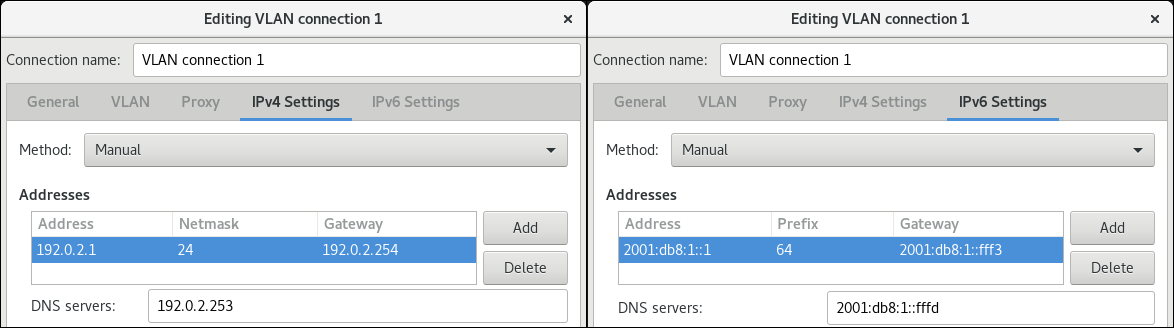

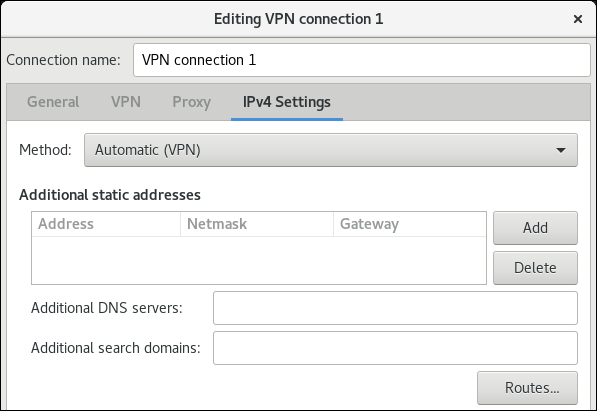

환경에 따라 그에 따라 IPv4 설정 및 IPv6 설정 탭에서 IP 주소 설정을 구성합니다.

-

DHCP 또는 IPv6 SLAAC(상태 비저장 주소 자동 구성)를 사용하려면

자동(DHCP)을 메서드(기본값)로 선택합니다. 고정 IP 주소, 네트워크 마스크, 기본 게이트웨이, DNS 서버 및 검색 도메인을 설정하려면

Manual을 메서드로 선택하고 탭의 필드를 작성합니다.

-

DHCP 또는 IPv6 SLAAC(상태 비저장 주소 자동 구성)를 사용하려면

- 저장을 클릭합니다.

- nm-connection-editor 를 종료합니다.

검증

NIC의 IP 설정을 표시합니다.

# ip address show enp1s0 2: enp1s0: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc fq_codel state UP group default qlen 1000 link/ether 52:54:00:17:b8:b6 brd ff:ff:ff:ff:ff:ff inet 192.0.2.1/24 brd 192.0.2.255 scope global noprefixroute enp1s0 valid_lft forever preferred_lft forever inet6 2001:db8:1::fffe/64 scope global noprefixroute valid_lft forever preferred_lft foreverIPv4 기본 게이트웨이를 표시합니다.

# ip route show default default via 192.0.2.254 dev enp1s0 proto static metric 102IPv6 기본 게이트웨이를 표시합니다.

# ip -6 route show default default via 2001:db8:1::ffee dev enp1s0 proto static metric 102 pref mediumDNS 설정을 표시합니다.

# cat /etc/resolv.conf search example.com nameserver 192.0.2.200 nameserver 2001:db8:1::ffbb여러 연결 프로필이 동시에 활성화된 경우

이름 서버항목의 순서는 이러한 프로필의 DNS 우선 순위 값과 연결 유형에 따라 달라집니다.ping유틸리티를 사용하여 이 호스트가 다른 호스트에 패킷을 보낼 수 있는지 확인합니다.# ping <host-name-or-IP-address>

문제 해결 단계

- 네트워크 커넥터가 호스트와 스위치에 연결되어 있는지 확인합니다.

- 링크 실패가 이 호스트에만 있는지 또는 동일한 스위치에 연결된 다른 호스트에 있는지 확인합니다.

- 네트워크케이블 및 네트워크 인터페이스가 예상대로 작동하는지 확인합니다. 하드웨어 진단 단계를 수행하고 결함 variables 및 네트워크 인터페이스 카드를 교체합니다.

- 디스크의 구성이 장치의 구성과 일치하지 않는 경우 NetworkManager를 시작하거나 다시 시작하면 장치의 구성을 반영하는 메모리 내 연결이 생성됩니다. 자세한 내용과 이 문제를 방지하는 방법은 NetworkManager 서비스 솔루션을 다시 시작한 후 NetworkManager 연결 중복을 참조하십시오.

2.6. nmstatectl을 사용하여 고정 IP 주소로 이더넷 연결 구성

nmstatectl 유틸리티를 사용하여 Nmstate API를 통해 이더넷 연결을 구성합니다. Nmstate API는 구성을 설정한 후 결과가 구성 파일과 일치하는지 확인합니다. 아무것도 실패하면 nmstatectl 에서 시스템을 잘못된 상태로 두지 않도록 변경 사항을 자동으로 롤백합니다.

사전 요구 사항

- 물리적 또는 가상 이더넷 NIC(네트워크 인터페이스 컨트롤러)가 서버 구성에 있습니다.

-

nmstate패키지가 설치되어 있습니다.

절차

다음 콘텐츠를 사용하여 YAML 파일(예:

~/create-ethernet-profile.yml)을 만듭니다.--- interfaces: - name: enp1s0 type: ethernet state: up ipv4: enabled: true address: - ip: 192.0.2.1 prefix-length: 24 dhcp: false ipv6: enabled: true address: - ip: 2001:db8:1::1 prefix-length: 64 autoconf: false dhcp: false routes: config: - destination: 0.0.0.0/0 next-hop-address: 192.0.2.254 next-hop-interface: enp1s0 - destination: ::/0 next-hop-address: 2001:db8:1::fffe next-hop-interface: enp1s0 dns-resolver: config: search: - example.com server: - 192.0.2.200 - 2001:db8:1::ffbb이러한 설정은 다음 설정을 사용하여

enp1s0장치에 대한 이더넷 연결 프로필을 정의합니다.-

/24서브넷 마스크가 있는 정적 IPv4 주소 -192.0.2.1 -

정적 IPv6 주소 -

2001:db8:1::1(/64서브넷 마스크 포함) -

IPv4 기본 게이트웨이 -

192.0.2.254 -

IPv6 기본 게이트웨이 -

2001:db8:1::fffe -

IPv4 DNS 서버 -

192.0.2.200 -

IPv6 DNS 서버

2001:db8:1::ffbb -

DNS 검색 도메인 -

example.com

-

선택 사항:

인터페이스속성의mac-address 및> 속성을 정의하여 이름 대신 MAC 주소로 네트워크 인터페이스 카드를 식별할 수 있습니다. 예를 들면 다음과 같습니다.mac-address: < mac_address--- interfaces: - name: <profile_name> type: ethernet identifier: mac-address mac-address: <mac_address> ...

시스템에 설정을 적용합니다.

# nmstatectl apply ~/create-ethernet-profile.yml

검증

현재 상태를 YAML 형식으로 표시합니다.

# nmstatectl show enp1s0NIC의 IP 설정을 표시합니다.

# ip address show enp1s0 2: enp1s0: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc fq_codel state UP group default qlen 1000 link/ether 52:54:00:17:b8:b6 brd ff:ff:ff:ff:ff:ff inet 192.0.2.1/24 brd 192.0.2.255 scope global noprefixroute enp1s0 valid_lft forever preferred_lft forever inet6 2001:db8:1::fffe/64 scope global noprefixroute valid_lft forever preferred_lft foreverIPv4 기본 게이트웨이를 표시합니다.

# ip route show default default via 192.0.2.254 dev enp1s0 proto static metric 102IPv6 기본 게이트웨이를 표시합니다.

# ip -6 route show default default via 2001:db8:1::ffee dev enp1s0 proto static metric 102 pref mediumDNS 설정을 표시합니다.

# cat /etc/resolv.conf search example.com nameserver 192.0.2.200 nameserver 2001:db8:1::ffbb여러 연결 프로필이 동시에 활성화된 경우

이름 서버항목의 순서는 이러한 프로필의 DNS 우선 순위 값과 연결 유형에 따라 달라집니다.ping유틸리티를 사용하여 이 호스트가 다른 호스트에 패킷을 보낼 수 있는지 확인합니다.# ping <host-name-or-IP-address>

추가 리소스

-

nmstatectl(8)man page -

/usr/share/doc/nmstate/examples/디렉터리

2.7. 인터페이스 이름으로 네트워크 RHEL 시스템 역할을 사용하여 고정 IP 주소로 이더넷 연결 구성

네트워크 RHEL 시스템 역할을 사용하여 이더넷 연결을 원격으로 구성할 수 있습니다.

사전 요구 사항

- 제어 노드와 관리형 노드가 준비되어 있습니다.

- 관리 노드에서 플레이북을 실행할 수 있는 사용자로 제어 노드에 로그인되어 있습니다.

-

관리형 노드에 연결하는 데 사용하는 계정에는

sudo권한이 있습니다. - 물리적 또는 가상 이더넷 장치는 서버의 구성에 있습니다.

- 관리형 노드는 NetworkManager를 사용하여 네트워크를 구성합니다.

절차

다음 콘텐츠를 사용하여 플레이북 파일(예:

~/playbook.yml)을 생성합니다.--- - name: Configure the network hosts: managed-node-01.example.com tasks: - name: Configure an Ethernet connection with static IP ansible.builtin.include_role: name: rhel-system-roles.network vars: network_connections: - name: enp1s0 interface_name: enp1s0 type: ethernet autoconnect: yes ip: address: - 192.0.2.1/24 - 2001:db8:1::1/64 gateway4: 192.0.2.254 gateway6: 2001:db8:1::fffe dns: - 192.0.2.200 - 2001:db8:1::ffbb dns_search: - example.com state: up이러한 설정은 다음 설정을 사용하여

enp1s0장치에 대한 이더넷 연결 프로필을 정의합니다.-

/24서브넷 마스크가 있는 정적 IPv4 주소 -192.0.2.1 -

정적 IPv6 주소 -

2001:db8:1::1(/64서브넷 마스크 포함) -

IPv4 기본 게이트웨이 -

192.0.2.254 -

IPv6 기본 게이트웨이 -

2001:db8:1::fffe -

IPv4 DNS 서버 -

192.0.2.200 -

IPv6 DNS 서버

2001:db8:1::ffbb -

DNS 검색 도메인 -

example.com

-

플레이북 구문을 확인합니다.

$ ansible-playbook --syntax-check ~/playbook.yml이 명령은 구문만 검증하고 잘못되었지만 유효한 구성으로부터 보호하지 않습니다.

플레이북을 실행합니다.

$ ansible-playbook ~/playbook.yml

추가 리소스

-

/usr/share/ansible/roles/rhel-system-roles.network/README.mdfile -

/usr/share/doc/rhel-system-roles/network/디렉터리

2.8. 장치 경로와 함께 네트워크 RHEL 시스템 역할을 사용하여 고정 IP 주소로 이더넷 연결 구성

네트워크 RHEL 시스템 역할을 사용하여 이더넷 연결을 원격으로 구성할 수 있습니다.

다음 명령을 사용하여 장치 경로를 식별할 수 있습니다.

# udevadm info /sys/class/net/<device_name> | grep ID_PATH=사전 요구 사항

- 제어 노드와 관리형 노드가 준비되어 있습니다.

- 관리 노드에서 플레이북을 실행할 수 있는 사용자로 제어 노드에 로그인되어 있습니다.

-

관리형 노드에 연결하는 데 사용하는 계정에는

sudo권한이 있습니다. - 물리적 또는 가상 이더넷 장치는 서버의 구성에 있습니다.

- 관리형 노드는 NetworkManager를 사용하여 네트워크를 구성합니다.

절차

다음 콘텐츠를 사용하여 플레이북 파일(예:

~/playbook.yml)을 생성합니다.--- - name: Configure the network hosts: managed-node-01.example.com tasks: - name: Configure an Ethernet connection with static IP ansible.builtin.include_role: name: rhel-system-roles.network vars: network_connections: - name: example match: path: - pci-0000:00:0[1-3].0 - &!pci-0000:00:02.0 type: ethernet autoconnect: yes ip: address: - 192.0.2.1/24 - 2001:db8:1::1/64 gateway4: 192.0.2.254 gateway6: 2001:db8:1::fffe dns: - 192.0.2.200 - 2001:db8:1::ffbb dns_search: - example.com state: up이러한 설정은 다음 설정을 사용하여 이더넷 연결 프로필을 정의합니다.

-

/24서브넷 마스크가 있는 정적 IPv4 주소 -192.0.2.1 -

정적 IPv6 주소 -

2001:db8:1::1(/64서브넷 마스크 포함) -

IPv4 기본 게이트웨이 -

192.0.2.254 -

IPv6 기본 게이트웨이 -

2001:db8:1::fffe -

IPv4 DNS 서버 -

192.0.2.200 -

IPv6 DNS 서버

2001:db8:1::ffbb DNS 검색 도메인 -

example.com이 예제의

match매개변수는 Ansible이 PCI ID 0000:0[1-3].0과 일치하는 장치에 플레이를 적용하지만0000:00:02.0과 일치하지 않음을 정의합니다. 사용할 수 있는 특수 수정자 및 와일드카드에 대한 자세한 내용은/usr/share/ansible/roles/rhel-system-roles.network/README.md파일의match매개변수 설명을 참조하십시오.

-

플레이북 구문을 확인합니다.

$ ansible-playbook --syntax-check ~/playbook.yml이 명령은 구문만 검증하고 잘못되었지만 유효한 구성으로부터 보호하지 않습니다.

플레이북을 실행합니다.

$ ansible-playbook ~/playbook.yml

추가 리소스

-

/usr/share/ansible/roles/rhel-system-roles.network/README.mdfile -

/usr/share/doc/rhel-system-roles/network/디렉터리

2.9. nmstatectl을 사용하여 동적 IP 주소로 이더넷 연결 구성

nmstatectl 유틸리티를 사용하여 Nmstate API를 통해 이더넷 연결을 구성합니다. Nmstate API는 구성을 설정한 후 결과가 구성 파일과 일치하는지 확인합니다. 아무것도 실패하면 nmstatectl 에서 시스템을 잘못된 상태로 두지 않도록 변경 사항을 자동으로 롤백합니다.

사전 요구 사항

- 물리적 또는 가상 이더넷 NIC(네트워크 인터페이스 컨트롤러)가 서버 구성에 있습니다.

- DHCP 서버는 네트워크에서 사용할 수 있습니다.

-

nmstate패키지가 설치되어 있습니다.

절차

다음 콘텐츠를 사용하여 YAML 파일(예:

~/create-ethernet-profile.yml)을 만듭니다.--- interfaces: - name: enp1s0 type: ethernet state: up ipv4: enabled: true auto-dns: true auto-gateway: true auto-routes: true dhcp: true ipv6: enabled: true auto-dns: true auto-gateway: true auto-routes: true autoconf: true dhcp: true이러한 설정은

enp1s0장치에 대한 이더넷 연결 프로필을 정의합니다. 연결은 DHCP 서버와 IPv6 상태 비저장 주소 자동 구성(SLAAC)에서 IPv4 주소, IPv6 주소, 기본 게이트웨이, 경로, DNS 서버 및 검색 도메인을 검색합니다.선택 사항:

인터페이스속성의mac-address 및> 속성을 정의하여 이름 대신 MAC 주소로 네트워크 인터페이스 카드를 식별할 수 있습니다. 예를 들면 다음과 같습니다.mac-address: < mac_address--- interfaces: - name: <profile_name> type: ethernet identifier: mac-address mac-address: <mac_address> ...

시스템에 설정을 적용합니다.

# nmstatectl apply ~/create-ethernet-profile.yml

검증

현재 상태를 YAML 형식으로 표시합니다.

# nmstatectl show enp1s0NIC의 IP 설정을 표시합니다.

# ip address show enp1s0 2: enp1s0: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc fq_codel state UP group default qlen 1000 link/ether 52:54:00:17:b8:b6 brd ff:ff:ff:ff:ff:ff inet 192.0.2.1/24 brd 192.0.2.255 scope global noprefixroute enp1s0 valid_lft forever preferred_lft forever inet6 2001:db8:1::fffe/64 scope global noprefixroute valid_lft forever preferred_lft foreverIPv4 기본 게이트웨이를 표시합니다.

# ip route show default default via 192.0.2.254 dev enp1s0 proto static metric 102IPv6 기본 게이트웨이를 표시합니다.

# ip -6 route show default default via 2001:db8:1::ffee dev enp1s0 proto static metric 102 pref mediumDNS 설정을 표시합니다.

# cat /etc/resolv.conf search example.com nameserver 192.0.2.200 nameserver 2001:db8:1::ffbb여러 연결 프로필이 동시에 활성화된 경우

이름 서버항목의 순서는 이러한 프로필의 DNS 우선 순위 값과 연결 유형에 따라 달라집니다.ping유틸리티를 사용하여 이 호스트가 다른 호스트에 패킷을 보낼 수 있는지 확인합니다.# ping <host-name-or-IP-address>

추가 리소스

-

nmstatectl(8)man page -

/usr/share/doc/nmstate/examples/디렉터리

2.10. 인터페이스 이름으로 네트워크 RHEL 시스템 역할을 사용하여 동적 IP 주소로 이더넷 연결 구성

네트워크 RHEL 시스템 역할을 사용하여 이더넷 연결을 원격으로 구성할 수 있습니다. 동적 IP 주소 설정과의 연결의 경우 NetworkManager는 DHCP 서버에서 연결에 대한 IP 설정을 요청합니다.

사전 요구 사항

- 제어 노드와 관리형 노드가 준비되어 있습니다.

- 관리 노드에서 플레이북을 실행할 수 있는 사용자로 제어 노드에 로그인되어 있습니다.

-

관리형 노드에 연결하는 데 사용하는 계정에는

sudo권한이 있습니다. - 물리적 또는 가상 이더넷 장치는 서버의 구성에 있습니다.

- DHCP 서버는 네트워크에서 사용 가능

- 관리형 노드는 NetworkManager를 사용하여 네트워크를 구성합니다.

절차

다음 콘텐츠를 사용하여 플레이북 파일(예:

~/playbook.yml)을 생성합니다.--- - name: Configure the network hosts: managed-node-01.example.com tasks: - name: Configure an Ethernet connection with dynamic IP ansible.builtin.include_role: name: rhel-system-roles.network vars: network_connections: - name: enp1s0 interface_name: enp1s0 type: ethernet autoconnect: yes ip: dhcp4: yes auto6: yes state: up이러한 설정은

enp1s0장치에 대한 이더넷 연결 프로필을 정의합니다. 연결은 DHCP 서버와 IPv6 상태 비저장 주소 자동 구성(SLAAC)에서 IPv4 주소, IPv6 주소, 기본 게이트웨이, 경로, DNS 서버 및 검색 도메인을 검색합니다.플레이북 구문을 확인합니다.

$ ansible-playbook --syntax-check ~/playbook.yml이 명령은 구문만 검증하고 잘못되었지만 유효한 구성으로부터 보호하지 않습니다.

플레이북을 실행합니다.

$ ansible-playbook ~/playbook.yml

추가 리소스

-

/usr/share/ansible/roles/rhel-system-roles.network/README.mdfile -

/usr/share/doc/rhel-system-roles/network/디렉터리

2.11. 장치 경로에서 네트워크 RHEL 시스템 역할을 사용하여 동적 IP 주소로 이더넷 연결 구성

네트워크 RHEL 시스템 역할을 사용하여 이더넷 연결을 원격으로 구성할 수 있습니다. 동적 IP 주소 설정과의 연결의 경우 NetworkManager는 DHCP 서버에서 연결에 대한 IP 설정을 요청합니다.

다음 명령을 사용하여 장치 경로를 식별할 수 있습니다.

# udevadm info /sys/class/net/<device_name> | grep ID_PATH=사전 요구 사항

- 제어 노드와 관리형 노드가 준비되어 있습니다.

- 관리 노드에서 플레이북을 실행할 수 있는 사용자로 제어 노드에 로그인되어 있습니다.

-

관리형 노드에 연결하는 데 사용하는 계정에는

sudo권한이 있습니다. - 물리적 또는 가상 이더넷 장치는 서버의 구성에 있습니다.

- DHCP 서버는 네트워크에서 사용할 수 있습니다.

- 관리 호스트는 NetworkManager를 사용하여 네트워크를 구성합니다.

절차

다음 콘텐츠를 사용하여 플레이북 파일(예:

~/playbook.yml)을 생성합니다.--- - name: Configure the network hosts: managed-node-01.example.com tasks: - name: Configure an Ethernet connection with dynamic IP ansible.builtin.include_role: name: rhel-system-roles.network vars: network_connections: - name: example match: path: - pci-0000:00:0[1-3].0 - &!pci-0000:00:02.0 type: ethernet autoconnect: yes ip: dhcp4: yes auto6: yes state: up이러한 설정은 이더넷 연결 프로필을 정의합니다. 연결은 DHCP 서버와 IPv6 상태 비저장 주소 자동 구성(SLAAC)에서 IPv4 주소, IPv6 주소, 기본 게이트웨이, 경로, DNS 서버 및 검색 도메인을 검색합니다.

match매개 변수는 Ansible이 PCI ID0000:00:0[1-3].0과 일치하는 장치에 플레이를 적용하지만0000:00:02.0이 아닌 장치에 플레이를 적용하도록 정의합니다.플레이북 구문을 확인합니다.

$ ansible-playbook --syntax-check ~/playbook.yml이 명령은 구문만 검증하고 잘못되었지만 유효한 구성으로부터 보호하지 않습니다.

플레이북을 실행합니다.

$ ansible-playbook ~/playbook.yml

추가 리소스

-

/usr/share/ansible/roles/rhel-system-roles.network/README.mdfile -

/usr/share/doc/rhel-system-roles/network/디렉터리

2.12. 인터페이스 이름으로 단일 연결 프로필을 사용하여 여러 이더넷 인터페이스 구성

대부분의 경우 하나의 연결 프로필에는 하나의 네트워크 장치의 설정이 포함됩니다. 그러나 NetworkManager는 연결 프로필에서 인터페이스 이름을 설정할 때 와일드카드도 지원합니다. 동적 IP 주소 할당을 사용하는 이더넷 네트워크 간에 호스트가 로밍하는 경우 이 기능을 사용하여 여러 이더넷 인터페이스에 사용할 수 있는 단일 연결 프로필을 만들 수 있습니다.

사전 요구 사항

- 서버 구성에 여러 개의 물리적 또는 가상 이더넷 장치가 있습니다.

- DHCP 서버는 네트워크에서 사용할 수 있습니다.

- 호스트에 연결 프로필이 없습니다.

절차

enp: enp로 시작하는 모든 인터페이스 이름에 적용되는 연결 프로파일을 추가합니다.# nmcli connection add con-name "Wired connection 1" connection.multi-connect multiple match.interface-name enp* type ethernet

검증

단일 연결 프로필의 모든 설정을 표시합니다.

# nmcli connection show "Wired connection 1" connection.id: Wired connection 1 ... connection.multi-connect: 3 (multiple) match.interface-name:

enp*...3은 연결 프로파일에서 동시에 활성 상태인 인터페이스의 수를 나타내며 연결 프로파일의 네트워크 인터페이스 수는 아닙니다. 연결 프로필은match.interface-name매개변수의 패턴과 일치하는 모든 장치를 사용하므로 연결 프로파일에 동일한 UBI(Universally Unique Identifier)가 있습니다.연결 상태를 표시합니다.

# nmcli connection show NAME UUID TYPE DEVICE ... Wired connection 1 6f22402e-c0cc-49cf-b702-eaf0cd5ea7d1 ethernet enp7s0 Wired connection 1 6f22402e-c0cc-49cf-b702-eaf0cd5ea7d1 ethernet enp8s0 Wired connection 1 6f22402e-c0cc-49cf-b702-eaf0cd5ea7d1 ethernet enp9s0

추가 리소스

-

nmcli(1) 도움말페이지 -

nm-settings(5) 도움말페이지

2.13. PCI ID를 사용하여 여러 이더넷 인터페이스에 대해 단일 연결 프로필 구성

PCI ID는 시스템에 연결된 장치의 고유 식별자입니다. 연결 프로필은 PCI ID 목록에 따라 인터페이스를 일치시켜 여러 장치를 추가합니다. 이 절차를 사용하여 여러 장치 PCI ID를 단일 연결 프로필에 연결할 수 있습니다.

사전 요구 사항

- 서버 구성에 여러 개의 물리적 또는 가상 이더넷 장치가 있습니다.

- DHCP 서버는 네트워크에서 사용할 수 있습니다.

- 호스트에 연결 프로필이 없습니다.

절차

장치 경로를 식별합니다. 예를 들어

enp로 시작하는 모든 인터페이스의 장치 경로를 표시하려면 다음을 입력합니다.# udevadm info /sys/class/net/enp | grep ID_PATH=* ... E: ID_PATH=pci-0000:07:00.0 E: ID_PATH=pci-0000:08:00.00000

:0[7-8].0 표현식과 일치하는 모든 PCI ID에 적용되는 연결 프로필을 추가합니다.# nmcli connection add type ethernet connection.multi-connect multiple match.path "pci-0000:07:00.0 pci-0000:08:00.0" con-name "Wired connection 1"

검증

연결 상태를 표시합니다.

# nmcli connection show NAME UUID TYPE DEVICE Wired connection 1 9cee0958-512f-4203-9d3d-b57af1d88466 ethernet enp7s0 Wired connection 1 9cee0958-512f-4203-9d3d-b57af1d88466 ethernet enp8s0 ...연결 프로필의 모든 설정을 표시하려면 다음을 수행합니다.

# nmcli connection show "Wired connection 1" connection.id: Wired connection 1 ... connection.multi-connect: 3 (multiple) match.path: pci-0000:07:00.0,pci-0000:08:00.0 ...이 연결 프로필은

match.path매개변수의 패턴과 일치하는 PCI ID가 있는 모든 장치를 사용하므로 연결 프로파일에는 동일한 UUID(Universally Unique Identifier)가 있습니다.

추가 리소스

-

nmcli(1) 도움말페이지 -

nm-settings(5) 도움말페이지

3장. 네트워크 본딩 구성

네트워크 본딩은 물리적 및 가상 네트워크 인터페이스를 결합하거나 집계하여 처리량 또는 중복성이 높은 논리 인터페이스를 제공하는 방법입니다. 본딩에서 커널은 모든 작업을 독점적으로 처리합니다. 이더넷 장치 또는 VLAN과 같은 다양한 유형의 장치에 본딩을 생성할 수 있습니다.

Red Hat Enterprise Linux는 관리자에게 팀 장치를 구성하는 다양한 옵션을 제공합니다. 예를 들면 다음과 같습니다.

-

nmcli를 사용하여 명령줄을 사용하여 본딩 연결을 구성합니다. - RHEL 웹 콘솔을 사용하여 웹 브라우저를 사용하여 본딩 연결을 구성합니다.

-

nmtui를 사용하여 텍스트 기반 사용자 인터페이스에서 본딩 연결을 구성합니다. -

nm-connection-editor애플리케이션을 사용하여 그래픽 인터페이스에서 본딩 연결을 구성합니다. -

nmstatectl을 사용하여 Nmstate API를 통한 본딩 연결을 구성합니다. - RHEL 시스템 역할을 사용하여 하나 이상의 호스트에서 본딩 구성을 자동화합니다.

3.1. 컨트롤러 및 포트 인터페이스의 기본 동작 이해

NetworkManager 서비스를 사용하여 팀 또는 본딩 포트 인터페이스를 관리하거나 해결할 때 다음 기본 동작을 고려하십시오.

- 컨트롤러 인터페이스를 시작하면 포트 인터페이스가 자동으로 시작되지 않습니다.

- 포트 인터페이스를 시작하면 항상 컨트롤러 인터페이스가 시작됩니다.

- 컨트롤러 인터페이스를 중지하면 포트 인터페이스도 중지됩니다.

- 포트가 없는 컨트롤러는 고정 IP 연결을 시작할 수 있습니다.

- 포트 없는 컨트롤러는 DHCP 연결을 시작할 때 포트를 대기합니다.

- 포트를 기다리는 DHCP 연결이 있는 컨트롤러는 캐리어가 있는 포트를 추가할 때 완료됩니다.

- 포트를 기다리는 DHCP 연결이 있는 컨트롤러는 캐리어 없이 포트를 추가할 때 계속 대기합니다.

3.2. 본딩 모드에 따른 업스트림 스위치 구성

사용하려는 본딩 모드에 따라 스위치에서 포트를 구성해야 합니다.

| 본딩 모드 | 스위치의 구성 |

|---|---|

|

| LACP(Link Aggregation Control Protocol) 협상이 아닌 정적 EtherChannel이 활성화되어 있어야 합니다. |

|

| 스위치에 구성이 필요하지 않습니다. |

|

| LACP-negotiated가 아닌 정적 EtherChannel이 활성화되어 있어야 합니다. |

|

| LACP-negotiated가 아닌 정적 EtherChannel이 활성화되어 있어야 합니다. |

|

| LACP-negotiated EtherChannel이 활성화되어 있어야 합니다. |

|

| 스위치에 구성이 필요하지 않습니다. |

|

| 스위치에 구성이 필요하지 않습니다. |

스위치를 구성하는 방법에 대한 자세한 내용은 스위치 설명서를 참조하십시오.

장애 조치 메커니즘과 같은 특정 네트워크 본딩 기능은 네트워크 스위치 없이 직접 유선 연결을 지원하지 않습니다. 자세한 내용은 크로스 오버 소켓을 사용하여 직접 연결과 함께 지원되는 Is 본딩을 참조하십시오. https://access.redhat.com/solutions/202583 KCS 솔루션.

3.3. nmcli를 사용하여 네트워크 본딩 구성

명령줄에서 네트워크 본딩을 구성하려면 nmcli 유틸리티를 사용합니다.

사전 요구 사항

- 서버에 두 개 이상의 물리적 또는 가상 네트워크 장치가 설치되어 있습니다.

- 이더넷 장치를 본딩의 포트로 사용하려면 물리적 또는 가상 이더넷 장치를 서버에 설치해야 합니다.

팀, 브리지 또는 VLAN 장치를 본딩의 포트로 사용하려면 본딩을 생성하는 동안 이러한 장치를 만들 수도 있고 다음에 설명된 대로 사전에 만들 수 있습니다.

절차

본딩 인터페이스를 생성합니다.

# nmcli connection add type bond con-name bond0 ifname bond0 bond.options "mode=active-backup"이 명령은

active-backup모드를 사용하는bond0이라는 본딩을 생성합니다.미디어 독립 인터페이스(MII) 모니터링 간격을 추가로 설정하려면

miimon=interval옵션을bond.options속성에 추가합니다. 예를 들면 다음과 같습니다.# nmcli connection add type bond con-name bond0 ifname bond0 bond.options "mode=active-backup,miimon=1000"네트워크 인터페이스를 표시하고 본딩에 추가할 인터페이스의 이름을 기록해 둡니다.

# nmcli device status DEVICE TYPE STATE CONNECTION enp7s0 ethernet disconnected -- enp8s0 ethernet disconnected -- bridge0 bridge connected bridge0 bridge1 bridge connected bridge1 ...이 예제에서는 다음을 수행합니다.

-

enp7s0및enp8s0은 구성되지 않습니다. 이러한 장치를 포트로 사용하려면 다음 단계에서 연결 프로필을 추가합니다. -

bridge0및bridge1에는 기존 연결 프로필이 있습니다. 이러한 장치를 포트로 사용하려면 다음 단계에서 프로필을 수정합니다.

-

인터페이스를 본딩에 할당합니다.

본딩에 할당하려는 인터페이스가 구성되지 않은 경우 해당 인터페이스에 대한 새 연결 프로필을 생성합니다.

# nmcli connection add type ethernet port-type bond con-name bond0-port1 ifname enp7s0 controller bond0 # nmcli connection add type ethernet port-type bond con-name bond0-port2 ifname enp8s0 controller bond0

이러한 명령은

enp7s0및enp8s0에 대한 프로필을 생성하여bond0연결에 추가합니다.기존 연결 프로필을 본딩에 할당하려면 다음을 수행합니다.

이러한 연결의

컨트롤러매개변수를bond0으로 설정합니다.# nmcli connection modify bridge0 controller bond0 # nmcli connection modify bridge1 controller bond0

이러한 명령은

bridge0및bridge1이라는 기존 연결 프로필을bond0연결에 할당합니다.연결을 다시 활성화합니다.

# nmcli connection up bridge0 # nmcli connection up bridge1

IPv4 설정을 구성합니다.

이 본딩 장치를 다른 장치의 포트로 사용하려면 다음을 입력합니다.

# nmcli connection modify bond0 ipv4.method disabled- DHCP를 사용하려면 작업이 필요하지 않습니다.

정적 IPv4 주소, 네트워크 마스크, 기본 게이트웨이 및 DNS 서버를

bond0연결로 설정하려면 다음을 입력합니다.# nmcli connection modify bond0 ipv4.addresses '192.0.2.1/24' ipv4.gateway '192.0.2.254' ipv4.dns '192.0.2.253' ipv4.dns-search 'example.com' ipv4.method manual

IPv6 설정을 구성합니다.

이 본딩 장치를 다른 장치의 포트로 사용하려면 다음을 입력합니다.

# nmcli connection modify bond0 ipv6.method disabled- SLAAC(stateless address autoconfiguration)를 사용하려면 작업이 필요하지 않습니다.

정적 IPv6 주소, 네트워크 마스크, 기본 게이트웨이 및 DNS 서버를

bond0연결로 설정하려면 다음을 입력합니다.# nmcli connection modify bond0 ipv6.addresses '2001:db8:1::1/64' ipv6.gateway '2001:db8:1::fffe' ipv6.dns '2001:db8:1::fffd' ipv6.dns-search 'example.com' ipv6.method manual

선택 사항: 본딩 포트에서 매개변수를 설정하려면 다음 명령을 사용합니다.

# nmcli connection modify bond0-port1 bond-port.<parameter> <value>연결을 활성화합니다.

# nmcli connection up bond0포트가 연결되어 있고

CONNECTION열에 포트의 연결 이름이 표시되는지 확인합니다.# nmcli device DEVICE TYPE STATE CONNECTION ... enp7s0 ethernet connected bond0-port1 enp8s0 ethernet connected bond0-port2연결 포트를 활성화하면 NetworkManager는 본딩을 활성화하지만 다른 포트는 활성화하지 않습니다. 본딩이 활성화되면 Red Hat Enterprise Linux가 모든 포트를 자동으로 사용하도록 설정할 수 있습니다.

본딩 연결의

connection.autoconnect-ports매개변수를 활성화합니다.# nmcli connection modify bond0 connection.autoconnect-ports 1브리지를 다시 활성화합니다.

# nmcli connection up bond0

검증

호스트에서 네트워크 케이블을 일시적으로 제거합니다.

소프트웨어 유틸리티를 사용하여 오류 이벤트를 올바르게 연결하는 방법은 없습니다.

nmcli와 같은 연결을 비활성화하는 툴에는 포트 구성 변경 사항을 처리하는 본딩 드라이버 기능만 표시하고 실제 링크 실패 이벤트가 아닙니다.본딩 상태를 표시합니다.

# cat /proc/net/bonding/bond0

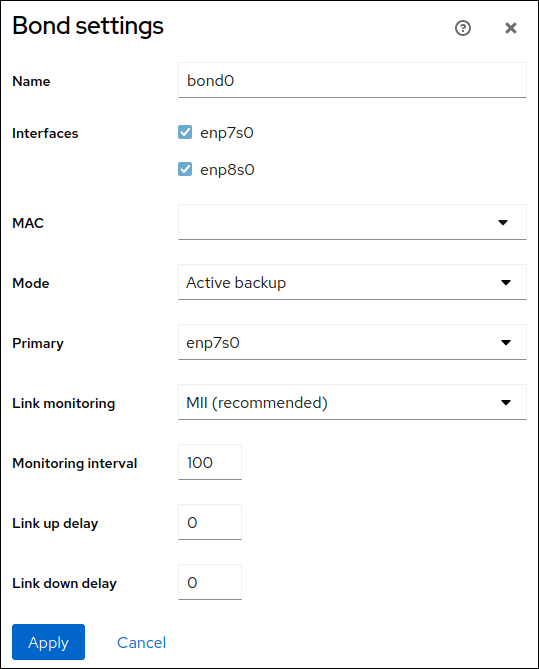

3.4. RHEL 웹 콘솔을 사용하여 네트워크 본딩 구성

웹 브라우저 기반 인터페이스를 사용하여 네트워크 설정을 관리하려면 RHEL 웹 콘솔을 사용하여 네트워크 본딩을 구성합니다.

사전 요구 사항

- RHEL 웹 콘솔에 로그인되어 있습니다.

- 서버에 두 개 이상의 물리적 또는 가상 네트워크 장치가 설치되어 있습니다.

- 이더넷 장치를 본딩의 멤버로 사용하려면 물리적 또는 가상 이더넷 장치를 서버에 설치해야 합니다.

팀, 브리지 또는 VLAN 장치를 본딩의 멤버로 사용하려면 다음에 설명된 대로 팀, 브리지 또는 VLAN 장치를 사전에 만듭니다.

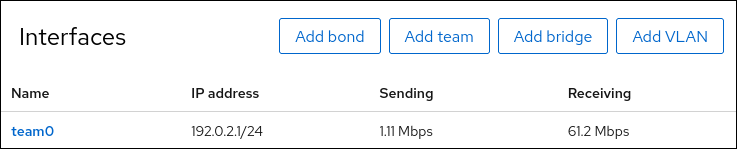

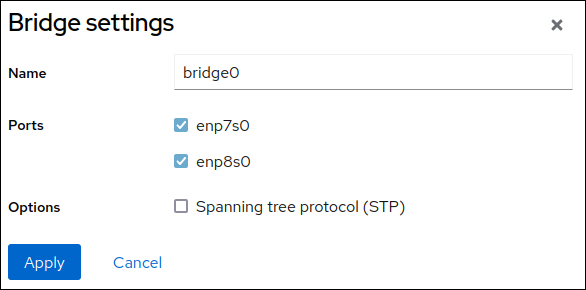

절차

- 화면 왼쪽의 탐색에서 네트워킹 탭을 선택합니다.

- 인터페이스 섹션에서 본딩 추가 를 클릭합니다.

- 생성할 본딩 장치의 이름을 입력합니다.

- 본딩의 멤버여야 하는 인터페이스를 선택합니다.

본딩 모드를 선택합니다.

활성 백업을 선택하면 웹 콘솔에 기본 활성화된 장치를 선택할 수 있는 추가 필드가 표시됩니다.

-

링크 모니터링 모드를 설정합니다. 예를 들어 Adaptive 로드 밸런싱 모드를 사용하는 경우 이를

ARP로 설정합니다. 선택 사항: 모니터링 간격을 조정하고, 지연 링크를 연결하며, 지연 설정을 링크 다운합니다. 일반적으로 문제 해결 목적으로만 기본값을 변경합니다.

- Apply(적용)를 클릭합니다.

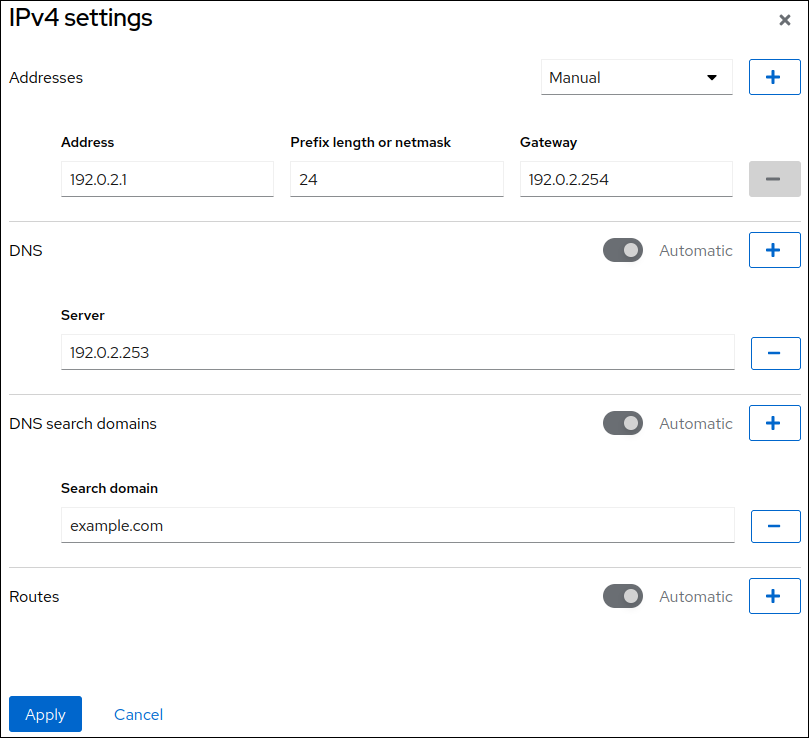

기본적으로 본딩에서는 동적 IP 주소를 사용합니다. 고정 IP 주소를 설정하려면 다음을 수행합니다.

- Interfaces 섹션에서 본딩 이름을 클릭합니다.

- 구성할 프로토콜 옆에 있는 편집을 클릭합니다.

- 주소 옆에 있는 수동 을 선택하고 IP 주소, 접두사 및 기본 게이트웨이를 입력합니다.

- DNS 섹션에서 + 버튼을 클릭하고 DNS 서버의 IP 주소를 입력합니다. 이 단계를 반복하여 여러 DNS 서버를 설정합니다.

- DNS 검색 도메인 섹션에서 + 버튼을 클릭하고 검색 도메인을 입력합니다.

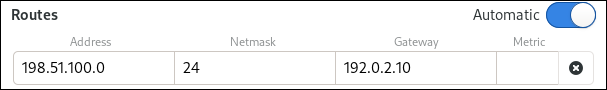

인터페이스에 정적 경로가 필요한 경우 Routes 섹션에서 구성합니다.

- 적용을클릭합니다.

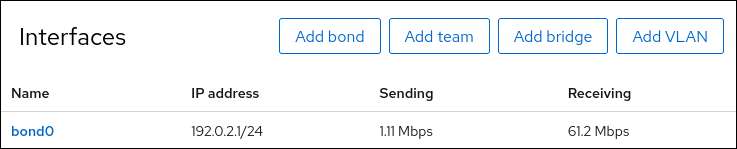

검증

화면 왼쪽의 탐색에서 Networking 탭을 선택하고 인터페이스에 들어오고 나가는 트래픽이 있는지 확인합니다.

호스트에서 네트워크 케이블을 일시적으로 제거합니다.

소프트웨어 유틸리티를 사용하여 오류 이벤트를 올바르게 연결하는 방법은 없습니다. 웹 콘솔과 같은 연결을 비활성화하는 툴에는 멤버 구성 변경 사항을 처리하는 본딩 드라이버 기능만 표시되고 실제 링크 실패 이벤트가 아님.

본딩 상태를 표시합니다.

# cat /proc/net/bonding/bond0

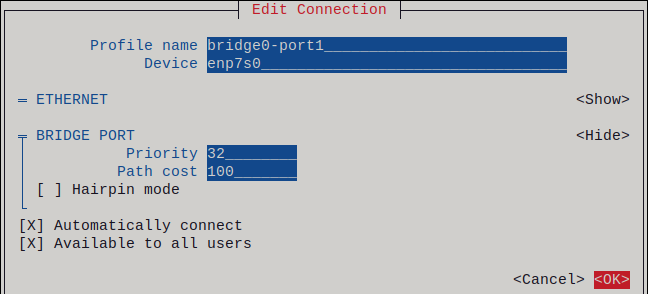

3.5. nmtui를 사용하여 네트워크 본딩 구성

nmtui 애플리케이션은 NetworkManager에 대한 텍스트 기반 사용자 인터페이스를 제공합니다. nmtui 를 사용하여 그래픽 인터페이스 없이 호스트에서 네트워크 본딩을 구성할 수 있습니다.

nmtui 에서 :

- 커서 키를 사용하여 이동합니다.

- 버튼을 선택하고 Enter 를 누릅니다.

- Space 를 사용하여 확인란을 선택하고 지웁니다.

사전 요구 사항

- 서버에 두 개 이상의 물리적 또는 가상 네트워크 장치가 설치되어 있습니다.

- 이더넷 장치를 본딩의 포트로 사용하려면 물리적 또는 가상 이더넷 장치를 서버에 설치해야 합니다.

절차

네트워크 본딩을 구성할 네트워크 장치 이름을 모르는 경우 사용 가능한 장치를 표시합니다.

# nmcli device status DEVICE TYPE STATE CONNECTION enp7s0 ethernet unavailable -- enp8s0 ethernet unavailable -- ...start

nmtui:# nmtui- Edit a connection 을 선택하고 Enter 를 누릅니다.

- 추가를 누릅니다.

- 네트워크 유형 목록에서 Bond 를 선택하고 Enter 를 누릅니다.

선택 사항: 생성할 NetworkManager 프로필의 이름을 입력합니다.

프로필이 여러 개인 호스트에서 의미 있는 이름을 사용하면 프로필의 용도를 쉽게 식별할 수 있습니다.

- 장치 필드에 생성할 본딩 장치 이름을 입력합니다.

생성할 본딩에 포트를 추가합니다.

- Slaves 목록 옆에 있는 Add 를 누릅니다.

- 본딩에 포트로 추가할 인터페이스 유형을 선택합니다(예: 이더넷 ).

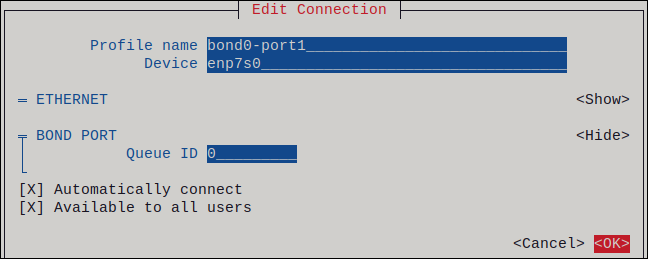

- 선택 사항: 이 본딩 포트에 대해 생성할 NetworkManager 프로필의 이름을 입력합니다.

- 장치의 장치 이름을 장치 필드에 입력합니다.

OK 를 눌러 본딩 설정으로 창으로 돌아갑니다.

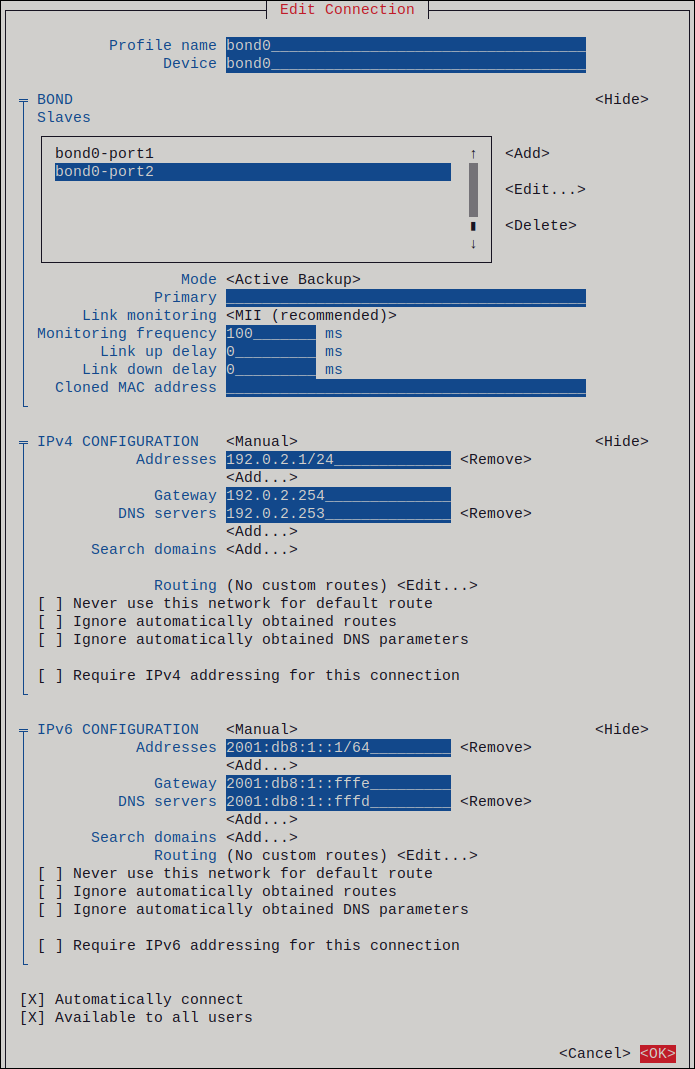

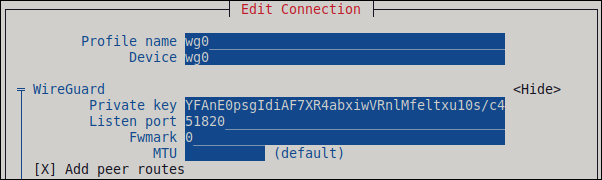

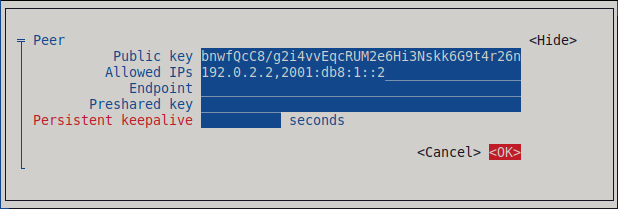

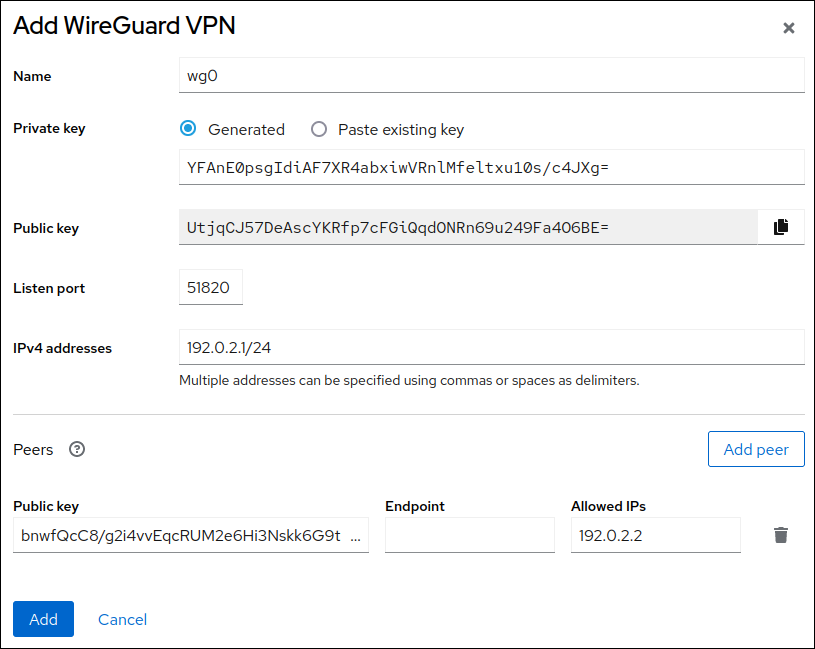

그림 3.1. 이더넷 장치를 본딩에 포트로 추가

- 이 단계를 반복하여 더 많은 포트를 본딩에 추가합니다.

-

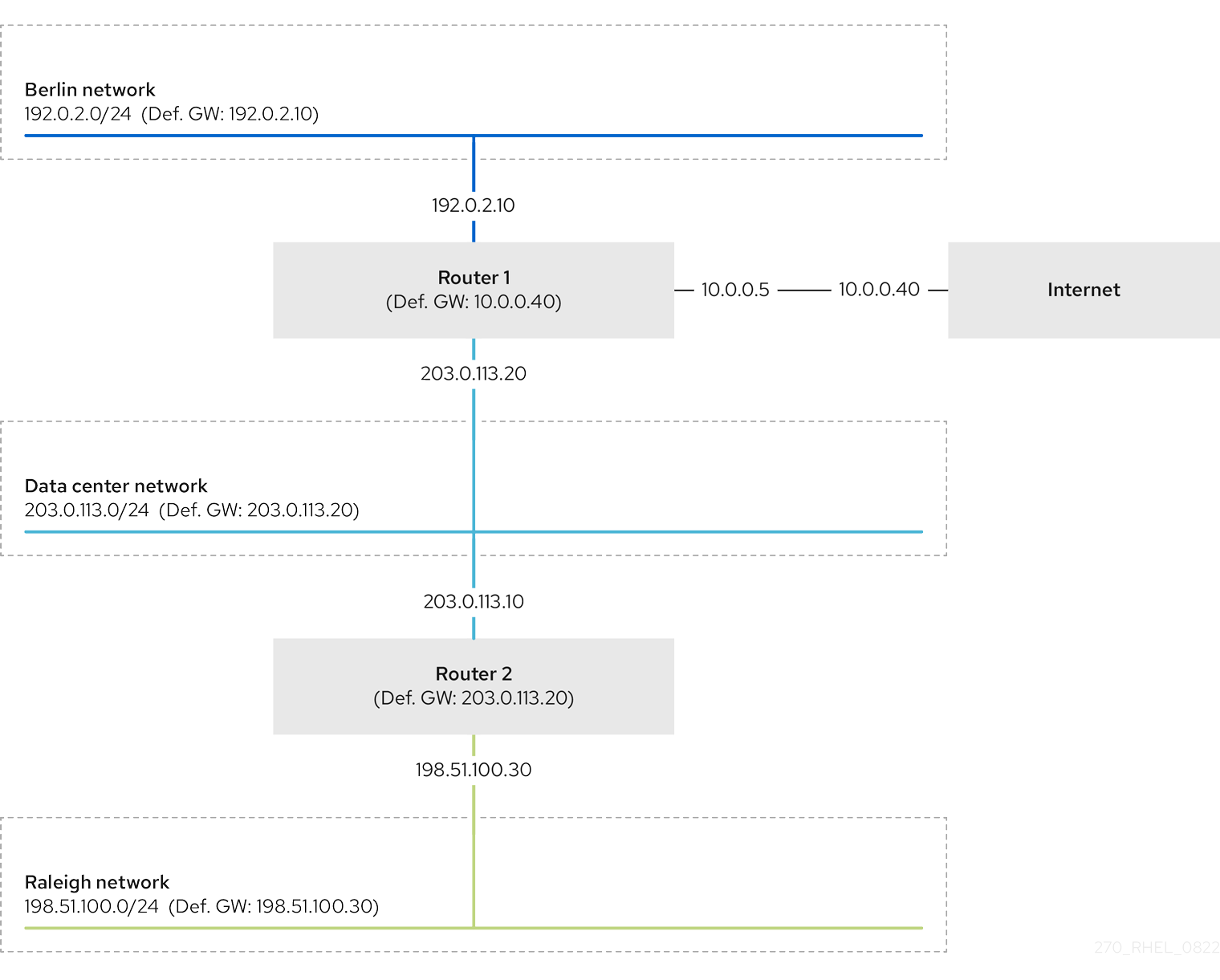

본딩 모드를 설정합니다. 설정한 값에 따라

nmtui는 선택한 모드와 관련된 설정에 대한 추가 필드를 표시합니다. 환경에 따라 그에 따라 IPv4 구성 및 IPv6 구성 영역에서 IP 주소 설정을 구성합니다. 이를 위해 다음 영역 옆에 있는 버튼을 누른 후 다음을 선택합니다.

-

본딩에 IP 주소가 필요하지 않은 경우

비활성화됨 -

DHCP 서버 또는 SLAAC(상태 비저장 주소 자동 구성)가 IP 주소를 본딩에 동적으로 할당하는 경우 자동입니다.

네트워크에 고정 IP 주소 설정이 필요한 경우

수동. 이 경우 추가 필드를 작성해야 합니다.- 추가 필드를 표시하도록 구성할 프로토콜 옆에 Show 를 누릅니다.

주소 옆에 있는 추가 를 클릭하고 CIDR(Classless Inter-Domain Routing) 형식으로 IP 주소와 서브넷 마스크를 입력합니다.

서브넷 마스크를 지정하지 않으면 NetworkManager는 IPv4 주소에 대해

/32서브넷 마스크와 IPv6 주소에 대해/64를 설정합니다.- 기본 게이트웨이의 주소를 입력합니다.

- DNS 서버 옆에 있는 추가 를 클릭하고 DNS 서버 주소를 입력합니다.

- 검색 도메인 옆에 있는 추가 를 클릭하고 DNS 검색 도메인을 입력합니다.

그림 3.2. 고정 IP 주소 설정을 사용한 본딩 연결 예

-

본딩에 IP 주소가 필요하지 않은 경우

- OK 를 눌러 새 연결을 만들고 자동으로 활성화합니다.

- 다시 키를 눌러 기본 메뉴로 돌아갑니다.

-

Quit 를 선택하고 Enter 를 눌러

nmtui애플리케이션을 종료합니다.

검증

호스트에서 네트워크 케이블을 일시적으로 제거합니다.

소프트웨어 유틸리티를 사용하여 오류 이벤트를 올바르게 연결하는 방법은 없습니다.

nmcli와 같은 연결을 비활성화하는 툴에는 포트 구성 변경 사항을 처리하는 본딩 드라이버 기능만 표시하고 실제 링크 실패 이벤트가 아닙니다.본딩 상태를 표시합니다.

# cat /proc/net/bonding/bond0

3.6. nm-connection-editor를 사용하여 네트워크 본딩 구성

그래픽 인터페이스와 함께 Red Hat Enterprise Linux를 사용하는 경우 nm-connection-editor 애플리케이션을 사용하여 네트워크 본딩을 구성할 수 있습니다.

nm-connection-editor 는 새 포트만 본딩에 추가할 수 있습니다. 기존 연결 프로필을 포트로 사용하려면 nmcli 를 사용하여 네트워크 본딩 구성에 설명된 nmcli 유틸리티를 사용하여 본딩 을 생성합니다.

사전 요구 사항

- 서버에 두 개 이상의 물리적 또는 가상 네트워크 장치가 설치되어 있습니다.

- 이더넷 장치를 본딩의 포트로 사용하려면 물리적 또는 가상 이더넷 장치를 서버에 설치해야 합니다.

- 팀, 본딩 또는 VLAN 장치를 본딩 포트로 사용하려면 이러한 장치가 아직 구성되어 있지 않은지 확인합니다.

절차

터미널을 열고

nm-connection-editor를 입력합니다.$ nm-connection-editor- + 버튼을 클릭하여 새 연결을 추가합니다.

- 연결 유형을 선택하고 만들기 를 클릭합니다.

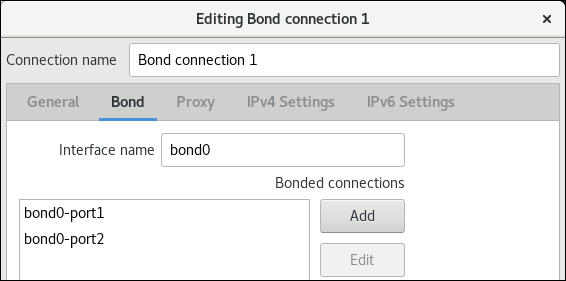

본딩 탭에서 다음을 수행합니다.

- 선택 사항: 인터페이스 이름 필드에 본딩 인터페이스의 이름을 설정합니다.

Add (추가) 버튼을 클릭하여 네트워크 인터페이스를 본딩에 포트로 추가합니다.

- 인터페이스의 연결 유형을 선택합니다. 예를 들어 유선 연결로 이더넷 을 선택합니다.

- 선택 사항: 포트에 대한 연결 이름을 설정합니다.

- 이더넷 장치에 대한 연결 프로필을 생성하는 경우 이더넷 탭을 열고 장치 필드에서 본딩에 포트로 추가할 네트워크 인터페이스를 선택합니다. 다른 장치 유형을 선택한 경우 적절하게 구성합니다. 구성되지 않은 본딩의 이더넷 인터페이스만 사용할 수 있습니다.

- 저장을 클릭합니다.

본딩에 추가할 각 인터페이스에 대해 이전 단계를 반복합니다.

- 선택 사항: MII(Media Independent Interface) 모니터링 간격과 같은 기타 옵션을 설정합니다.

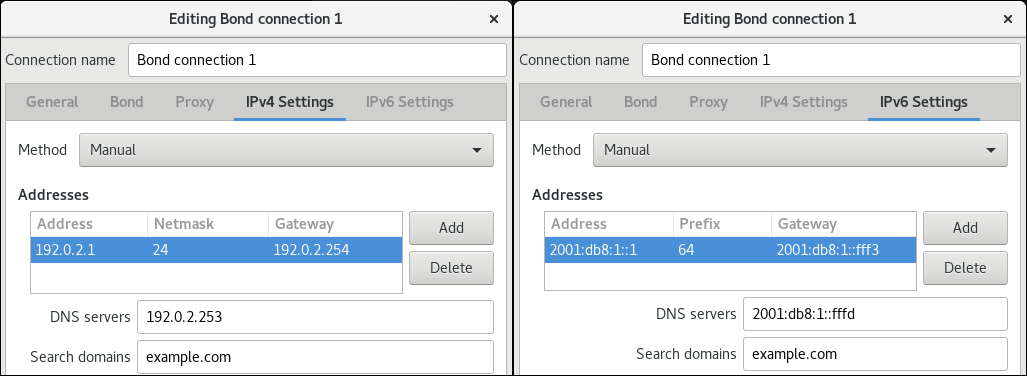

IPv4 설정 및 IPv6 설정 탭에서 IP 주소 설정을 구성합니다.

- 이 브리지 장치를 다른 장치의 포트로 사용하려면 Method 필드를 Disabled 로 설정합니다.

- DHCP를 사용하려면 Method 필드를 기본값인 Automatic(DHCP) 으로 둡니다.

고정 IP 설정을 사용하려면 Method 필드를 Manual 로 설정하고 그에 따라 필드를 작성합니다.

- 저장을 클릭합니다.

-

nm-connection-editor를 종료합니다.

검증

호스트에서 네트워크 케이블을 일시적으로 제거합니다.

소프트웨어 유틸리티를 사용하여 오류 이벤트를 올바르게 연결하는 방법은 없습니다.

nmcli와 같은 연결을 비활성화하는 툴에는 포트 구성 변경 사항을 처리하는 본딩 드라이버 기능만 표시하고 실제 링크 실패 이벤트가 아닙니다.본딩 상태를 표시합니다.

# cat /proc/net/bonding/bond0

3.7. nmstatectl을 사용하여 네트워크 본딩 구성

nmstatectl 유틸리티를 사용하여 Nmstate API를 통해 네트워크 본딩을 구성합니다. Nmstate API는 구성을 설정한 후 결과가 구성 파일과 일치하는지 확인합니다. 아무것도 실패하면 nmstatectl 에서 시스템을 잘못된 상태로 두지 않도록 변경 사항을 자동으로 롤백합니다.

환경에 따라 적절하게 YAML 파일을 조정합니다. 예를 들어 본딩의 이더넷 어댑터와 다른 장치를 사용하려면 본딩에서 사용하는 포트의 base-iface 특성 및 유형 속성을 조정합니다.

사전 요구 사항

- 서버에 두 개 이상의 물리적 또는 가상 네트워크 장치가 설치되어 있습니다.

- 이더넷 장치를 본딩의 포트로 사용하려면 물리적 또는 가상 이더넷 장치를 서버에 설치해야 합니다.

-

팀, 브리지 또는 VLAN 장치를 본딩에서 포트로 사용하려면

포트목록에서 인터페이스 이름을 설정하고 해당 인터페이스를 정의합니다. -

nmstate패키지가 설치되어 있습니다.

절차

다음 콘텐츠를 사용하여 YAML 파일(예:

~/create-bond.yml)을 생성합니다.--- interfaces: - name: bond0 type: bond state: up ipv4: enabled: true address: - ip: 192.0.2.1 prefix-length: 24 dhcp: false ipv6: enabled: true address: - ip: 2001:db8:1::1 prefix-length: 64 autoconf: false dhcp: false link-aggregation: mode: active-backup port: - enp1s0 - enp7s0 - name: enp1s0 type: ethernet state: up - name: enp7s0 type: ethernet state: up routes: config: - destination: 0.0.0.0/0 next-hop-address: 192.0.2.254 next-hop-interface: bond0 - destination: ::/0 next-hop-address: 2001:db8:1::fffe next-hop-interface: bond0 dns-resolver: config: search: - example.com server: - 192.0.2.200 - 2001:db8:1::ffbb이러한 설정은 다음 설정으로 네트워크 본딩을 정의합니다.

-

본딩의 네트워크 인터페이스

enp1s0및enp7s0 -

모드:

active-backup -

정적 IPv4 주소:

192.0.2.1및/24서브넷 마스크 -

정적 IPv6 주소:

2001:db8:1::1및/64서브넷 마스크 -

IPv4 기본 게이트웨이:

192.0.2.254 -

IPv6 기본 게이트웨이:

2001:db8:1::fffe -

IPv4 DNS 서버:

192.0.2.200 -

IPv6 DNS 서버:

2001:db8:1::ffbb -

DNS 검색 도메인:

example.com

-

본딩의 네트워크 인터페이스

시스템에 설정을 적용합니다.

# nmstatectl apply ~/create-bond.yml

검증

장치 및 연결의 상태를 표시합니다.

# nmcli device status DEVICE TYPE STATE CONNECTION bond0 bond connected bond0

연결 프로필의 모든 설정을 표시합니다.

# nmcli connection show bond0 connection.id: bond0 connection.uuid: 79cbc3bd-302e-4b1f-ad89-f12533b818ee connection.stable-id: -- connection.type: bond connection.interface-name: bond0 ...연결 설정을 YAML 형식으로 표시합니다.

# nmstatectl show bond0

추가 리소스

-

nmstatectl(8)man page -

/usr/share/doc/nmstate/examples/디렉터리

3.8. 네트워크 RHEL 시스템 역할을 사용하여 네트워크 본딩 구성

네트워크 RHEL 시스템 역할을 사용하여 네트워크 본딩을 원격으로 구성할 수 있습니다.

사전 요구 사항

- 제어 노드와 관리형 노드가 준비되어 있습니다.

- 관리 노드에서 플레이북을 실행할 수 있는 사용자로 제어 노드에 로그인되어 있습니다.

-

관리형 노드에 연결하는 데 사용하는 계정에는

sudo권한이 있습니다. - 서버에 두 개 이상의 물리적 또는 가상 네트워크 장치가 설치되어 있습니다.

절차

다음 콘텐츠를 사용하여 플레이북 파일(예:

~/playbook.yml)을 생성합니다.--- - name: Configure the network hosts: managed-node-01.example.com tasks: - name: Configure a network bond that uses two Ethernet ports ansible.builtin.include_role: name: rhel-system-roles.network vars: network_connections: # Define the bond profile - name: bond0 type: bond interface_name: bond0 ip: address: - "192.0.2.1/24" - "2001:db8:1::1/64" gateway4: 192.0.2.254 gateway6: 2001:db8:1::fffe dns: - 192.0.2.200 - 2001:db8:1::ffbb dns_search: - example.com bond: mode: active-backup state: up # Add an Ethernet profile to the bond - name: bond0-port1 interface_name: enp7s0 type: ethernet controller: bond0 state: up # Add a second Ethernet profile to the bond - name: bond0-port2 interface_name: enp8s0 type: ethernet controller: bond0 state: up이러한 설정은 다음 설정으로 네트워크 본딩을 정의합니다.

-

/24서브넷 마스크가 있는 정적 IPv4 주소 -192.0.2.1 -

정적 IPv6 주소 -

2001:db8:1::1(/64서브넷 마스크 포함) -

IPv4 기본 게이트웨이 -

192.0.2.254 -

IPv6 기본 게이트웨이 -

2001:db8:1::fffe -

IPv4 DNS 서버 -

192.0.2.200 -

IPv6 DNS 서버

2001:db8:1::ffbb -

DNS 검색 도메인 -

example.com -

본딩 포트 -

enp7s0및enp8s0 본딩 모드 -

active-backup참고Linux 본딩 포트가 아닌 본딩에 IP 구성을 설정합니다.

-

플레이북 구문을 확인합니다.

$ ansible-playbook --syntax-check ~/playbook.yml이 명령은 구문만 검증하고 잘못되었지만 유효한 구성으로부터 보호하지 않습니다.

플레이북을 실행합니다.

$ ansible-playbook ~/playbook.yml

추가 리소스

-

/usr/share/ansible/roles/rhel-system-roles.network/README.mdfile -

/usr/share/doc/rhel-system-roles/network/디렉터리

3.9. VPN을 중단하지 않고 이더넷과 무선 연결 간 전환을 가능하게 하는 네트워크 본딩 생성

회사의 네트워크에 워크스테이션을 연결하는 RHEL 사용자는 일반적으로 VPN을 사용하여 원격 리소스에 액세스합니다. 그러나 워크스테이션이 이더넷과 Wi-Fi 연결 간에 전환되면 예를 들어 이더넷 연결이 있는 도킹 스테이션에서 랩탑을 릴리스하는 경우 VPN 연결이 중단됩니다. 이 문제를 방지하려면 active-backup 모드에서 이더넷 및 plug-Fi 연결을 사용하는 네트워크 본딩을 생성할 수 있습니다.

사전 요구 사항

- 호스트에는 이더넷과 Wi-Fi 장치가 포함되어 있습니다.

이더넷 및 Wi-Fi NetworkManager 연결 프로필이 생성되어 두 연결 모두 독립적으로 작동합니다.

이 절차에서는 다음 연결 프로필을 사용하여

bond0이라는 네트워크 본딩을 생성합니다.-

enp11s0u1이더넷 장치와 관련된Docking_station -

wlp1s0sha-Fi 장치와 연결된 hub-Fi

-

절차

active-backup모드로 본딩 인터페이스를 생성합니다.# nmcli connection add type bond con-name bond0 ifname bond0 bond.options "mode=active-backup"이 명령은 인터페이스 및 연결 프로필

bond0의 이름을 모두 지정합니다.본딩의 IPv4 설정을 구성합니다.

- 네트워크의 DHCP 서버에서 IPv4 주소를 호스트에 할당하면 작업이 필요하지 않습니다.

로컬 네트워크에 정적 IPv4 주소가 필요한 경우 주소, 네트워크 마스크, 기본 게이트웨이, DNS 서버 및 DNS 검색 도메인을

bond0연결로 설정합니다.# nmcli connection modify bond0 ipv4.addresses '192.0.2.1/24' # nmcli connection modify bond0 ipv4.gateway '192.0.2.254' # nmcli connection modify bond0 ipv4.dns '192.0.2.253' # nmcli connection modify bond0 ipv4.dns-search 'example.com' # nmcli connection modify bond0 ipv4.method manual

본딩의 IPv6 설정을 구성합니다.

- 네트워크의 라우터 또는 DHCP 서버가 호스트에 IPv6 주소를 할당하는 경우 작업이 필요하지 않습니다.

로컬 네트워크에 정적 IPv6 주소가 필요한 경우 주소, 네트워크 마스크, 기본 게이트웨이, DNS 서버 및 DNS 검색 도메인을

bond0연결로 설정합니다.# nmcli connection modify bond0 ipv6.addresses '2001:db8:1::1/64' # nmcli connection modify bond0 ipv6.gateway '2001:db8:1::fffe' # nmcli connection modify bond0 ipv6.dns '2001:db8:1::fffd' # nmcli connection modify bond0 ipv6.dns-search 'example.com' # nmcli connection modify bond0 ipv6.method manual

연결 프로필을 표시합니다.

# nmcli connection show NAME UUID TYPE DEVICE Docking_station 256dd073-fecc-339d-91ae-9834a00407f9 ethernet enp11s0u1 Wi-Fi 1f1531c7-8737-4c60-91af-2d21164417e8 wifi wlp1s0 ...다음 단계에서 연결 프로필의 이름과 이더넷 장치 이름이 필요합니다.

이더넷 연결의 연결 프로필을 본딩에 할당합니다.

# nmcli connection modify Docking_station controller bond0본딩에 Wi-Fi 연결의 연결 프로필을 할당합니다.

# nmcli connection modify Wi-Fi controller bond0Wi-Fi 네트워크에서 MAC 필터링을 사용하여 허용 목록의 MAC 주소만 네트워크에 액세스하는 경우 NetworkManager가 활성 포트의 MAC 주소를 본딩에 동적으로 할당하도록 구성합니다.

# nmcli connection modify bond0 +bond.options fail_over_mac=1이 설정을 사용하면 이더넷 및 Wi-Fi 장치 둘 다의 MAC 주소 대신 Wi-Fi 장치의 MAC 주소만 허용 목록으로 설정해야 합니다.

이더넷 연결과 연결된 장치를 본딩의 기본 장치로 설정합니다.

# nmcli con modify bond0 +bond.options "primary=enp11s0u1"이 설정을 사용하면 사용 가능한 경우 본딩은 항상 이더넷 연결을 사용합니다.

bond0장치가 활성화되면 NetworkManager가 포트를 자동으로 활성화하도록 구성합니다.# nmcli connection modify bond0 connection.autoconnect-ports 1bond0연결을 활성화합니다.# nmcli connection up bond0

검증

현재 활성화된 장치, 본딩의 상태 및 해당 포트를 표시합니다.

# cat /proc/net/bonding/bond0 Ethernet Channel Bonding Driver: v3.7.1 (April 27, 2011) Bonding Mode: fault-tolerance (active-backup) (fail_over_mac active) Primary Slave: enp11s0u1 (primary_reselect always) Currently Active Slave: enp11s0u1 MII Status: up MII Polling Interval (ms): 1 Up Delay (ms): 0 Down Delay (ms): 0 Peer Notification Delay (ms): 0 Slave Interface: enp11s0u1 MII Status: up Speed: 1000 Mbps Duplex: full Link Failure Count: 0 Permanent HW addr: 00:53:00:59:da:b7 Slave queue ID: 0 Slave Interface: wlp1s0 MII Status: up Speed: Unknown Duplex: Unknown Link Failure Count: 2 Permanent HW addr: 00:53:00:b3:22:ba Slave queue ID: 0

추가 리소스

3.10. 다양한 네트워크 본딩 모드

Linux 본딩 드라이버는 링크 집계를 제공합니다. 본딩은 단일 논리 본딩 인터페이스를 제공하기 위해 여러 네트워크 인터페이스를 병렬로 집계하는 프로세스입니다. 본딩된 인터페이스의 작업은 모드라고도 하는 본딩 정책에 따라 달라집니다. 다양한 모드는 로드 밸런싱 또는 핫란드 서비스를 제공합니다.

다음과 같은 모드가 있습니다.

- balance-rr (Mode 0)

balance-rr는 사용 가능한 첫 번째 포트에서 마지막 포트로 패킷을 순차적으로 전송하는 라운드 로빈 알고리즘을 사용합니다. 이 모드는 로드 밸런싱 및 내결함성을 제공합니다.이 모드에서는 포트 집계 그룹(ECDHEChannel 또는 유사한 포트 그룹화)을 전환해야 합니다. Channel은 하나의 논리 이더넷 링크로 여러 개의 물리적 이더넷 링크를 그룹화하는 포트 링크 집계 기술입니다.

이 모드의 단점은 많은 워크로드에는 적합하지 않으며 TCP 처리량 또는 정렬된 패킷 전달이 필요한 경우입니다.

- active-backup (Mode 1)

active-backup에서는 본딩에서 하나의 포트만 활성 상태임을 결정하는 정책을 사용합니다. 이 모드는 내결함성을 제공하며 스위치 구성이 필요하지 않습니다.활성 포트가 실패하면 대체 포트가 활성화됩니다. 본딩은 외부 주소 확인 프로토콜(ARP) 응답을 네트워크에 보냅니다. 무상 ARP는 ARP 프레임의 수신자가 전달 테이블을 업데이트하도록 강제 적용합니다.

Active-backup모드는 무차별 ARP를 전송하여 호스트의 연결을 유지하기 위한 새로운 경로를 발표합니다.기본옵션은 본딩 인터페이스의 기본 포트를 정의합니다.- balance-xor(Mode 2)

balance-xor는 선택한 전송 해시 정책을 사용하여 패킷을 보냅니다. 이 모드는 로드 밸런싱, 내결함성을 제공하며, FlexVolume채널 또는 유사한 포트 그룹화를 설정하기 위해 스위치 구성이 필요합니다.패킷 전송 및 밸런스 전송을 변경하려면 이 모드는

xmit_hash_policy옵션을 사용합니다. 인터페이스의 트래픽 소스 또는 대상에 따라 인터페이스에 추가 로드 밸런싱 구성이 필요합니다. 설명 xmit_hash_policy bonding 매개변수를 참조하십시오.- 브로드캐스트(Mode 3)

broadcast는 모든 인터페이스에서 모든 패킷을 전송하는 정책을 사용합니다. 이 모드는 내결함성을 제공하며,ECDHEChannel 또는 유사한 포트 그룹화를 설정하기 위해 스위치 구성이 필요합니다.이 모드의 단점은 많은 워크로드에는 적합하지 않으며 TCP 처리량 또는 정렬된 패킷 전달이 필요한 경우입니다.

- 802.3ad (Mode 4)

802.3ad는 동일한 이름의 IEEE 표준 동적 링크 집계 정책을 사용합니다. 이 모드는 내결함성을 제공합니다. 이 모드에서는LACP(Link Aggregation Control Protocol) 포트 그룹화를 설정하려면 스위치 구성이 필요합니다.이 모드에서는 동일한 속도와 모호한 설정을 공유하는 집계 그룹을 생성하고 활성 집계기의 모든 포트를 사용합니다. 인터페이스의 트래픽 소스 또는 대상에 따라 이 모드에는 추가 로드 밸런싱 구성이 필요합니다.

기본적으로 발신 트래픽에 대한 포트 선택 사항은 전송 해시 정책에 따라 다릅니다. 전송 해시 정책의

xmit_hash_policy옵션을 사용하여 포트 선택 및 전송 밸런싱을 변경합니다.802.3ad와Balance-xor의 차이점은 규정 준수입니다.802.3ad정책은 포트 집계 그룹 간에 LACP를 협상합니다. 설명 xmit_hash_policy bonding 매개변수를참조하십시오.- balance-tlb (Mode 5)

balance-tlb는 전송 로드 밸런싱 정책을 사용합니다. 이 모드에서는 스위치 지원이 필요하지 않은 내결함성, 로드 밸런싱 및 채널 본딩을 설정합니다.활성 포트는 들어오는 트래픽을 수신합니다. 활성 포트가 실패하는 경우 다른 포트가 실패한 포트의 MAC 주소를 인수합니다. 발신 트래픽을 처리하는 인터페이스를 결정하려면 다음 모드 중 하나를 사용합니다.

-

값

0: 해시 배포 정책을 사용하여 부하 분산 없이 트래픽을 분산합니다. 값 1:

로드 밸런싱을 사용하여 각 포트에 트래픽 배포본딩 옵션

tlb_dynamic_lb=0을 사용하면 이 본딩 모드에서는xmit_hash_policy본딩 옵션을 사용하여 전송의 균형을 조정합니다.기본옵션은 본딩 인터페이스의 기본 포트를 정의합니다.

설명 xmit_hash_policy bonding 매개변수를 참조하십시오.

-

값

- balance-alb (Mode 6)

balance-alb는 조정형 로드 밸런싱 정책을 사용합니다. 이 모드는 내결함성, 로드 밸런싱을 제공하며 특별한 스위치 지원이 필요하지 않습니다.이 모드에는 IPv4 및 IPv6 트래픽에 대한 balance-transmit 부하 분산(

balance-tlb) 및 수신 로드 밸런싱이 포함됩니다. 본딩은 로컬 시스템에서 보낸 ARP 응답을 가로채고 본딩에서 포트 중 하나의 소스 하드웨어 주소를 덮어씁니다. ARP 협상은 수신 부하 분산을 관리합니다. 따라서 다른 포트는 서버에 다른 하드웨어 주소를 사용합니다.기본옵션은 본딩 인터페이스의 기본 포트를 정의합니다. 본딩 옵션tlb_dynamic_lb=0을 사용하면 이 본딩 모드에서는xmit_hash_policy본딩 옵션을 사용하여 전송의 균형을 조정합니다. 설명 xmit_hash_policy bonding 매개변수를 참조하십시오.

추가 리소스

-

/usr/share/doc/kernel-doc-<version>/Documentation/networking/bonding.rst는kernel-doc패키지에서 제공하는 -

/usr/share/doc/kernel-doc-<version>/Documentation/networking/bonding.txt는kernel-doc패키지에서 제공하는 - 가상 시스템 게스트 또는 컨테이너가 연결되는 브릿지와 함께 사용할 때 어떤 본딩 모드가 작동합니까?

- "xmit_hash_policy" bonding 매개변수의 다양한 정책 값은 어떻게 계산됩니까?

3.11. xmit_hash_policy bonding 매개변수

xmit_hash_policy 로드 밸런싱 매개변수는 balance-xor,802.3ad,balance-alb, balance-tlb 모드에서 노드 선택에 대한 전송 해시 정책을 선택합니다. tlb_dynamic_lb 매개변수가 0 인 경우에만 모드 5 및 6에 적용됩니다. 이 매개변수의 가능한 값은 layer2 , ,layer2 +3layer3+4,encap2+3,encap3+4, vlan+srcmac 입니다.

자세한 내용은 표를 참조하십시오.

| 정책 또는 네트워크 계층 | Layer2 | Layer2+3 | Layer3+4 | encap2+3 | encap3+4 | VLAN+srcmac |

| 사용 | 소스 및 대상 MAC 주소 및 이더넷 프로토콜 유형의 XOR | 소스 및 대상 MAC 주소의 XOR | 소스 및 대상 포트 및 IP 주소 XOR |

지원되는 터널 내의 소스 및 대상 MAC 주소 및 IP 주소(예: VXLAN(Virtual Extensible LAN)) XOR. 이 모드는 |

지원되는 터널 내의 소스 및 대상 포트 및 IP 주소(예: VXLAN)의 XOR. 이 모드는 | VLAN ID 및 소스 MAC 공급 업체 및 소스 MAC 장치의 XOR |

| 트래픽 배치 | 동일한 기본 네트워크 인터페이스에서 특정 네트워크 피어로의 모든 트래픽 | 동일한 기본 네트워크 인터페이스의 특정 IP 주소로의 모든 트래픽 | 동일한 기본 네트워크 인터페이스의 특정 IP 주소 및 포트에 대한 모든 트래픽 | |||

| 기본 선택 | 동일한 브로드캐스트 도메인에 이 시스템과 여러 다른 시스템 간에 네트워크 트래픽이 있는 경우 | 이 시스템과 여러 다른 시스템 간의 네트워크 트래픽이 기본 게이트웨이를 통과하는 경우 | 이 시스템과 다른 시스템 간의 네트워크 트래픽이 동일한 IP 주소를 사용하지만 여러 포트를 통과하는 경우 | 캡슐화된 트래픽은 소스 시스템과 여러 IP 주소를 사용하는 여러 다른 시스템 간의 트래픽입니다. | 캡슐화된 트래픽은 여러 포트 번호를 사용하는 소스 시스템과 기타 시스템 간 트래픽입니다. | 본딩에서 여러 컨테이너 또는 VM(가상 머신)의 네트워크 트래픽을 브리지 네트워크와 같은 외부 네트워크에 직접 노출하고 모드 2 또는 모드 4의 스위치를 구성할 수 없습니다. |

| 보조 선택 | 네트워크 트래픽이 대부분 이 시스템과 기본 게이트웨이 뒤의 여러 다른 시스템 사이인 경우 | 네트워크 트래픽이 이 시스템과 다른 시스템 사이에 있는 경우 | ||||

| compliant | 802.3ad | 802.3ad | 802.3ad는 아닙니다. | |||

| 기본 정책 | 구성이 제공되지 않는 경우 기본 정책입니다. |

IP가 아닌 트래픽의 경우 수식이 |

IP가 아닌 트래픽의 경우 수식이 |

4장. 네트워크 티밍 구성

네트워크 팀은 물리적 및 가상 네트워크 인터페이스를 결합하거나 집계하여 처리량 또는 중복성이 높은 논리 인터페이스를 제공하는 방법입니다. 네트워크 티밍은 작은 커널 모듈을 사용하여 패킷 흐름에 대한 빠른 처리 및 기타 작업에 대한 사용자 공간 서비스를 구현합니다. 이를 통해 네트워크 팀은 로드 밸런싱 및 중복 요구 사항에 맞게 쉽게 확장 가능하고 확장 가능한 솔루션입니다.

Red Hat Enterprise Linux는 관리자에게 팀 장치를 구성하는 다양한 옵션을 제공합니다. 예를 들면 다음과 같습니다.

-

nmcli를 사용하여 명령줄을 사용하여 팀 연결을 구성합니다. - RHEL 웹 콘솔을 사용하여 웹 브라우저를 사용하여 팀 연결을 구성합니다.

-

nm-connection-editor애플리케이션을 사용하여 그래픽 인터페이스에서 팀 연결을 구성합니다.

네트워크 티밍은 Red Hat Enterprise Linux 9에서 더 이상 사용되지 않습니다. 대안으로 네트워크 본딩 드라이버를 사용하는 것이 좋습니다. 자세한 내용은 네트워크 본딩 구성 을 참조하십시오.

4.1. 네트워크 팀 구성을 네트워크 본딩으로 마이그레이션

네트워크 티밍은 Red Hat Enterprise Linux 9에서 더 이상 사용되지 않습니다. 작업 중인 네트워크 팀이 이미 구성되어 있는 경우(예: 이전 RHEL 버전에서 업그레이드한 경우 NetworkManager에서 관리하는 네트워크 본딩으로 구성을 마이그레이션할 수 있습니다.

team2bond 유틸리티는 네트워크 팀 구성을 본딩으로만 변환합니다. 이후 IP 주소 및 DNS 구성과 같은 본딩의 추가 설정을 수동으로 구성해야 합니다.

사전 요구 사항

-

team-team0NetworkManager 연결 프로필이team0장치를 구성하고 관리합니다. -

teamd패키지가 설치되어 있습니다.

절차

선택 사항:

team-team0NetworkManager 연결의 IP 구성을 표시합니다.# nmcli connection show team-team0 | egrep "^ip" ... ipv4.method: manual ipv4.dns: 192.0.2.253 ipv4.dns-search: example.com ipv4.addresses: 192.0.2.1/24 ipv4.gateway: 192.0.2.254 ... ipv6.method: manual ipv6.dns: 2001:db8:1::fffd ipv6.dns-search: example.com ipv6.addresses: 2001:db8:1::1/64 ipv6.gateway: 2001:db8:1::fffe ...team0장치의 구성을 JSON 파일로 내보냅니다.# teamdctl team0 config dump actual > /tmp/team0.json네트워크 팀을 제거합니다. 예를 들어 NetworkManager에서 팀을 구성한 경우

team-team0연결 프로필과 관련 포트의 프로필을 제거합니다.# nmcli connection delete team-team0 # nmcli connection delete team-team0-port1 # nmcli connection delete team-team0-port2

시험 실행 모드에서

team2bond유틸리티를 실행하여 팀 장치와 유사한 설정으로 네트워크 본딩을 설정하는nmcli명령을 표시합니다.# team2bond --config=/tmp/team0.json --rename=bond0 nmcli con add type bond ifname bond0 bond.options "mode=active-backup,num_grat_arp=1,num_unsol_na=1,resend_igmp=1,miimon=100,miimon=100" nmcli con add type ethernet ifname enp7s0 controller bond0 nmcli con add type ethernet ifname enp8s0 controller bond0

첫 번째 명령에는 팀 구성 파일에 두 개의

link_watch항목이 포함되어 있었기 때문에 두 개의miimon옵션이 포함되어 있습니다. 이는 본딩 생성에는 영향을 미치지 않습니다.서비스를 팀의 장치 이름에 바인딩하고 이러한 서비스를 업데이트하거나 중단하지 않으려면

--rename=bond0옵션을 생략합니다. 이 경우team2bond는 팀에 대해 본딩에 동일한 인터페이스 이름을 사용합니다.-

team2bond유틸리티에 대한 옵션이 올바른지 확인합니다. 본딩을 만듭니다. 제안된

nmcli명령을 실행하거나--exec-cmd옵션을 사용하여team2bond명령을 다시 실행할 수 있습니다.# team2bond --config=/tmp/team0.json --rename=bond0 --exec-cmd Connection 'bond-bond0' (0241a531-0c72-4202-80df-73eadfc126b5) successfully added. Connection 'bond-port-enp7s0' (38489729-b624-4606-a784-1ccf01e2f6d6) successfully added. Connection 'bond-port-enp8s0' (de97ec06-7daa-4298-9a71-9d4c7909daa1) successfully added.

다음 단계에 본딩 연결 프로필의 이름(

bond-bond0)이 필요합니다.team-team0에서 이전에 구성된 IPv4 설정을bond-bond0연결로 설정합니다.# nmcli connection modify bond-bond0 ipv4.addresses '192.0.2.1/24' # nmcli connection modify bond-bond0 ipv4.gateway '192.0.2.254' # nmcli connection modify bond-bond0 ipv4.dns '192.0.2.253' # nmcli connection modify bond-bond0 ipv4.dns-search 'example.com' # nmcli connection modify bond-bond0 ipv4.method manual

team-team0에서 이전에 구성된 IPv6 설정을bond-bond0연결로 설정합니다.# nmcli connection modify bond-bond0 ipv6.addresses '2001:db8:1::1/64' # nmcli connection modify bond-bond0 ipv6.gateway '2001:db8:1::fffe' # nmcli connection modify bond-bond0 ipv6.dns '2001:db8:1::fffd' # nmcli connection modify bond-bond0 ipv6.dns-search 'example.com' # nmcli connection modify bond-bond0 ipv6.method manual

연결을 활성화합니다.

# nmcli connection up bond-bond0

검증

bond-bond0NetworkManager 연결의 IP 구성을 표시합니다.# nmcli connection show bond-bond0 | egrep "^ip" ... ipv4.method: manual ipv4.dns: 192.0.2.253 ipv4.dns-search: example.com ipv4.addresses: 192.0.2.1/24 ipv4.gateway: 192.0.2.254 ... ipv6.method: manual ipv6.dns: 2001:db8:1::fffd ipv6.dns-search: example.com ipv6.addresses: 2001:db8:1::1/64 ipv6.gateway: 2001:db8:1::fffe ...본딩 상태를 표시합니다.

# cat /proc/net/bonding/bond0 Ethernet Channel Bonding Driver: v5.13.0-0.rc7.51.el9.x86_64 Bonding Mode: fault-tolerance (active-backup) Primary Slave: None Currently Active Slave: enp7s0 MII Status: up MII Polling Interval (ms): 100 Up Delay (ms): 0 Down Delay (ms): 0 Peer Notification Delay (ms): 0 Slave Interface: enp7s0 MII Status: up Speed: Unknown Duplex: Unknown Link Failure Count: 0 Permanent HW addr: 52:54:00:bf:b1:a9 Slave queue ID: 0 Slave Interface: enp8s0 MII Status: up Speed: Unknown Duplex: Unknown Link Failure Count: 0 Permanent HW addr: 52:54:00:04:36:0f Slave queue ID: 0이 예에서는 두 포트가 모두 유효합니다.

본딩 장애 조치가 작동하는지 확인하려면 다음을 수행합니다.

- 호스트에서 네트워크 케이블을 일시적으로 제거합니다. 명령줄을 사용하여 링크 실패 이벤트를 올바르게 테스트하는 방법이 없습니다.

본딩 상태를 표시합니다.

# cat /proc/net/bonding/bond0

4.2. 컨트롤러 및 포트 인터페이스의 기본 동작 이해

NetworkManager 서비스를 사용하여 팀 또는 본딩 포트 인터페이스를 관리하거나 해결할 때 다음 기본 동작을 고려하십시오.

- 컨트롤러 인터페이스를 시작하면 포트 인터페이스가 자동으로 시작되지 않습니다.

- 포트 인터페이스를 시작하면 항상 컨트롤러 인터페이스가 시작됩니다.

- 컨트롤러 인터페이스를 중지하면 포트 인터페이스도 중지됩니다.

- 포트가 없는 컨트롤러는 고정 IP 연결을 시작할 수 있습니다.

- 포트 없는 컨트롤러는 DHCP 연결을 시작할 때 포트를 대기합니다.

- 포트를 기다리는 DHCP 연결이 있는 컨트롤러는 캐리어가 있는 포트를 추가할 때 완료됩니다.

- 포트를 기다리는 DHCP 연결이 있는 컨트롤러는 캐리어 없이 포트를 추가할 때 계속 대기합니다.

4.3. teamd 서비스, 러너 및 link-watchers 이해

팀 서비스인 teamd 는 팀 드라이버의 인스턴스 하나를 제어합니다. 이 드라이버 인스턴스는 하드웨어 장치 드라이버의 인스턴스를 추가하여 네트워크 인터페이스의 팀을 형성합니다. 팀 드라이버는 team0 과 같은 네트워크 인터페이스를 커널에 제공합니다.

teamd 서비스는 모든 팀 작업에 공통 논리를 구현합니다. 이러한 함수는 라운드 로빈과 같은 다양한 로드 공유 및 백업 방법에 고유하며 실행자라고 하는 별도의 코드 단위로 구현 됩니다. 관리자는 JSON(JavaScript Object Notation) 형식으로 runners를 지정하고, 인스턴스를 생성할 때 JSON 코드가 teamd 인스턴스로 컴파일됩니다. 또는 NetworkManager 를 사용하는 경우 team.runner 매개변수에서 runner를 설정하고 NetworkManager 는 해당 JSON 코드를 자동으로 만들 수 있습니다.

다음 러너를 사용할 수 있습니다.

-

broadcast: 모든 포트에서 데이터를 전송합니다. -

roundrobin: 모든 포트에서 데이터를 차례로 전송합니다. -

activebackup: 다른 포트는 하나의 포트로 데이터를 전송하고 다른 포트는 백업으로 유지됩니다. -

loadbalance: 활성 Tx 로드 밸런싱 및 Berkeley Packet Filter (BPF) 기반 Tx 포트 선택기를 사용하여 모든 포트에서 데이터를 전송합니다. -

임의의: 임의로 선택한 포트에서 데이터를 전송합니다. -

LACP: 802.3ad Link Aggregation Control Protocol (LACP)을 구현합니다.

teamd 서비스는 링크 감시자를 사용하여 하위 장치의 상태를 모니터링합니다. 다음 link-watchers를 사용할 수 있습니다.

-

ethtool:libteam라이브러리는ethtool유틸리티를 사용하여 링크 상태 변경 사항을 확인합니다. 기본 link-watcher입니다. -

arp_ping:libteam라이브러리는arp_ping유틸리티를 사용하여 ARP(Address Resolution Protocol)를 사용하여 원격 하드웨어 주소의 존재를 모니터링합니다. -

nsna_ping: IPv6 연결에서libteam라이브러리는 IPv6 Neighbor Discovery 프로토콜의 Neighbor Advertisement 및 Neighbor Discovery 기능을 사용하여 블랜딩 인터페이스의 존재를 모니터링합니다.

각 실행기에서는 lacp 를 제외하고 모든 링크 감시자를 사용할 수 있습니다. 이 실행기에서는 ethtool 링크 감시자만 사용할 수 있습니다.

4.4. nmcli를 사용하여 네트워크 팀 구성

명령줄에서 네트워크 팀을 구성하려면 nmcli 유틸리티를 사용합니다.

네트워크 티밍은 Red Hat Enterprise Linux 9에서 더 이상 사용되지 않습니다. 대안으로 네트워크 본딩 드라이버를 사용하는 것이 좋습니다. 자세한 내용은 네트워크 본딩 구성 을 참조하십시오.

사전 요구 사항

-

teamd및NetworkManager-team패키지가 설치됩니다. - 서버에 두 개 이상의 물리적 또는 가상 네트워크 장치가 설치되어 있습니다.

- 이더넷 장치를 팀의 포트로 사용하려면 물리적 또는 가상 이더넷 장치를 서버에 설치하고 스위치에 연결해야 합니다.

본딩, 브리지 또는 VLAN 장치를 팀의 포트로 사용하려면 다음 장치를 생성하는 동안 팀을 만들거나 다음에 설명된 대로 사전에 생성할 수 있습니다.

절차

팀 인터페이스를 생성합니다.

# nmcli connection add type team con-name team0 ifname team0 team.runner activebackup이 명령은

activebackup실행기를 사용하는team0이라는 네트워크 팀을 생성합니다.선택적으로 링크 감시자를 설정합니다. 예를 들어

team0연결 프로필에서ethtool링크 감시자를 설정하려면 다음을 수행합니다.# nmcli connection modify team0 team.link-watchers "name=ethtool"링크 감시자는 서로 다른 매개 변수를 지원합니다. 링크 감시자의 매개변수를 설정하려면

name속성에 공백을 지정합니다. name 속성은 따옴표로 묶어야 합니다. 예를 들어ethtool링크 감시자를 사용하여delay-up매개변수를2500밀리초(2.5초)로 설정하려면 다음을 수행합니다.# nmcli connection modify team0 team.link-watchers "name=ethtool delay-up=2500"여러 링크 감시자와 특정 매개 변수를 사용하여 각각을 설정하려면 링크 감시자를 쉼표로 구분해야 합니다. 다음 예제에서는

source-host및target-host매개변수를 사용하여delay-up매개변수 및arp_ping링크 감시자를 사용하여ethtool링크 감시자를 설정합니다.# nmcli connection modify team0 team.link-watchers "name=ethtool delay-up=2, name=arp_ping source-host=192.0.2.1 target-host=192.0.2.2"네트워크 인터페이스를 표시하고 팀에 추가하려는 인터페이스의 이름을 기록해 둡니다.

# nmcli device status DEVICE TYPE STATE CONNECTION enp7s0 ethernet disconnected -- enp8s0 ethernet disconnected -- bond0 bond connected bond0 bond1 bond connected bond1 ...이 예제에서는 다음을 수행합니다.

-

enp7s0및enp8s0은 구성되지 않습니다. 이러한 장치를 포트로 사용하려면 다음 단계에서 연결 프로필을 추가합니다. 연결에 할당되지 않은 팀의 이더넷 인터페이스만 사용할 수 있습니다. -

bond0및bond1에는 기존 연결 프로필이 있습니다. 이러한 장치를 포트로 사용하려면 다음 단계에서 프로필을 수정합니다.

-

팀에 포트 인터페이스를 할당합니다.

팀에 할당하려는 인터페이스가 구성되지 않은 경우 해당 인스턴스에 대한 새 연결 프로필을 생성합니다.

# nmcli connection add type ethernet port-type team con-name team0-port1 ifname enp7s0 controller team0 # nmcli connection add type ethernet port--type team con-name team0-port2 ifname enp8s0 controller team0

이러한 명령은

enp7s0및enp8s0에 대한 프로필을 생성하여team0연결에 추가합니다.기존 연결 프로필을 팀에 할당하려면 다음을 수행합니다.

이러한 연결의

controller매개변수를team0으로 설정합니다.# nmcli connection modify bond0 controller team0 # nmcli connection modify bond1 controller team0

이러한 명령은

bond0및bond1이라는 기존 연결 프로필을team0연결에 할당합니다.연결을 다시 활성화합니다.

# nmcli connection up bond0 # nmcli connection up bond1

IPv4 설정을 구성합니다.

이 팀 장치를 다른 장치의 포트로 사용하려면 다음을 입력합니다.

# nmcli connection modify team0 ipv4.method disabled- DHCP를 사용하려면 작업이 필요하지 않습니다.

정적 IPv4 주소, 네트워크 마스크, 기본 게이트웨이 및 DNS 서버를

team0연결로 설정하려면 다음을 입력합니다.# nmcli connection modify team0 ipv4.addresses '192.0.2.1/24' ipv4.gateway '192.0.2.254' ipv4.dns '192.0.2.253' ipv4.dns-search 'example.com' ipv4.method manual

IPv6 설정을 구성합니다.

이 팀 장치를 다른 장치의 포트로 사용하려면 다음을 입력합니다.

# nmcli connection modify team0 ipv6.method disabled- SLAAC(stateless address autoconfiguration)를 사용하려면 작업이 필요하지 않습니다.

정적 IPv6 주소, 네트워크 마스크, 기본 게이트웨이 및 DNS 서버를

team0연결로 설정하려면 다음을 입력합니다.# nmcli connection modify team0 ipv6.addresses '2001:db8:1::1/64' ipv6.gateway '2001:db8:1::fffe' ipv6.dns '2001:db8:1::fffd' ipv6.dns-search 'example.com' ipv6.method manual

연결을 활성화합니다.

# nmcli connection up team0

검증

팀 상태를 표시합니다.

# teamdctl team0 state setup: runner: activebackup ports: enp7s0 link watches: link summary: up instance[link_watch_0]: name: ethtool link: up down count: 0 enp8s0 link watches: link summary: up instance[link_watch_0]: name: ethtool link: up down count: 0 runner: active port: enp7s0이 예에서는 두 포트가 모두 유효합니다.

추가 리소스

- 기본 게이트웨이를 제공하기 위해 특정 프로필을 사용하지 않도록 NetworkManager 구성

- teamd 서비스, 러너 및 link-watchers 이해

-

nm-settings(5) 도움말페이지 -

teamd.conf(5)man page

4.5. RHEL 웹 콘솔을 사용하여 네트워크 팀 구성

웹 브라우저 기반 인터페이스를 사용하여 네트워크 설정을 관리하려면 RHEL 웹 콘솔을 사용하여 네트워크 팀을 구성합니다.

네트워크 티밍은 Red Hat Enterprise Linux 9에서 더 이상 사용되지 않습니다. 대안으로 네트워크 본딩 드라이버를 사용하는 것이 좋습니다. 자세한 내용은 네트워크 본딩 구성 을 참조하십시오.

사전 요구 사항

-

teamd및NetworkManager-team패키지가 설치됩니다. - 서버에 두 개 이상의 물리적 또는 가상 네트워크 장치가 설치되어 있습니다.

- 이더넷 장치를 팀의 포트로 사용하려면 물리적 또는 가상 이더넷 장치를 서버에 설치하고 스위치에 연결해야 합니다.

본딩, 브리지 또는 VLAN 장치를 팀 포트로 사용하려면 다음에 설명된 대로 미리 만듭니다.

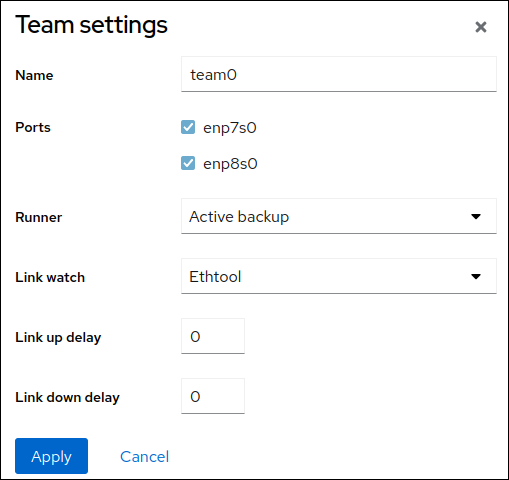

절차

-

화면 왼쪽의 탐색에서

네트워킹탭을 선택합니다. -

인터페이스섹션에서 팀 추가를 클릭합니다. - 생성할 팀 장치의 이름을 입력합니다.

- 팀의 포트여야 하는 인터페이스를 선택합니다.

팀의 runner를 선택합니다.

로드 밸런싱또는802.3ad LACP를 선택하면 웹 콘솔에 추가 필드밸런서가 표시됩니다.링크 감시자를 설정합니다.

-

Ethtool, additionally를 선택하면 링크를 설정하고 지연을 연결합니다. -

ARP ping또는NSNA ping을 추가로 설정하는 경우 ping 간격 및 ping 대상을 설정합니다.

-

- Apply(적용)를 클릭합니다.

기본적으로 팀은 동적 IP 주소를 사용합니다. 고정 IP 주소를 설정하려면 다음을 수행합니다.

-

Interfaces섹션에서 팀 이름을 클릭합니다. -

구성할 프로토콜 옆에 있는

편집을 클릭합니다. -

주소옆에 있는Manual을 선택하고 IP 주소, 접두사 및 기본 게이트웨이를 입력합니다. -

DNS섹션에서 + 버튼을 클릭하고 DNS 서버의 IP 주소를 입력합니다. 이 단계를 반복하여 여러 DNS 서버를 설정합니다. -

DNS 검색 도메인섹션에서 + 버튼을 클릭하고 검색 도메인을 입력합니다. 인터페이스에 정적 경로가 필요한 경우

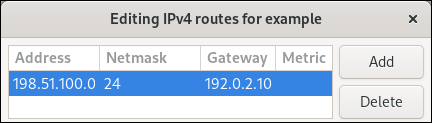

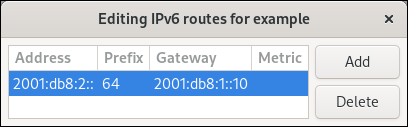

Routes섹션에서 구성합니다.

- 적용을클릭합니다.

-

검증

화면 왼쪽의 탐색에서

Networking탭을 선택하고 인터페이스에서 들어오고 나가는 트래픽이 있는지 확인합니다.

팀 상태를 표시합니다.

# teamdctl team0 state setup: runner: activebackup ports: enp7s0 link watches: link summary: up instance[link_watch_0]: name: ethtool link: up down count: 0 enp8s0 link watches: link summary: up instance[link_watch_0]: name: ethtool link: up down count: 0 runner: active port: enp7s0이 예에서는 두 포트가 모두 유효합니다.

추가 리소스

4.6. nm-connection-editor를 사용하여 네트워크 팀 구성

그래픽 인터페이스와 함께 Red Hat Enterprise Linux를 사용하는 경우 nm-connection-editor 애플리케이션을 사용하여 네트워크 팀을 구성할 수 있습니다.

nm-connection-editor 는 팀에 새 포트만 추가할 수 있습니다. 기존 연결 프로필을 포트로 사용하려면 nmcli 를 사용하여 네트워크 팀 구성에 설명된 대로 nmcli 유틸리티를 사용하여 팀을 생성합니다.

네트워크 티밍은 Red Hat Enterprise Linux 9에서 더 이상 사용되지 않습니다. 대안으로 네트워크 본딩 드라이버를 사용하는 것이 좋습니다. 자세한 내용은 네트워크 본딩 구성 을 참조하십시오.

사전 요구 사항

-

teamd및NetworkManager-team패키지가 설치됩니다. - 서버에 두 개 이상의 물리적 또는 가상 네트워크 장치가 설치되어 있습니다.

- 이더넷 장치를 팀의 포트로 사용하려면 물리적 또는 가상 이더넷 장치를 서버에 설치해야 합니다.

- 팀, 본딩 또는 VLAN 장치를 팀의 포트로 사용하려면 이러한 장치가 아직 구성되어 있지 않은지 확인합니다.

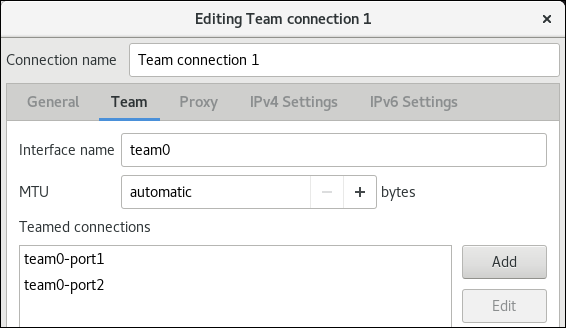

절차

터미널을 열고

nm-connection-editor를 입력합니다.$ nm-connection-editor- + 버튼을 클릭하여 새 연결을 추가합니다.

- 팀 연결 유형을 선택하고 생성을 클릭합니다.

팀 탭에서 다음을 수행합니다.

- 선택 사항: Interface name 필드에 팀 인터페이스의 이름을 설정합니다.

Add 버튼을 클릭하여 네트워크 인터페이스의 새 연결 프로필을 추가하고 해당 프로필을 팀에 포트로 추가합니다.

- 인터페이스의 연결 유형을 선택합니다. 예를 들어 유선 연결로 이더넷 을 선택합니다.

- 선택 사항: 포트에 대한 연결 이름을 설정합니다.

- 이더넷 장치에 대한 연결 프로필을 생성하는 경우 이더넷 탭을 열고 장치 필드에서 팀에 포트로 추가할 네트워크 인터페이스를 선택합니다. 다른 장치 유형을 선택한 경우 적절하게 구성합니다. 연결에 할당되지 않은 팀의 이더넷 인터페이스만 사용할 수 있습니다.

- 저장을 클릭합니다.

팀에 추가할 각 인터페이스에 대해 이전 단계를 반복합니다.

고급 버튼을 클릭하여 고급 옵션을 팀 연결에 설정합니다.

- Runner 탭에서 러너를 선택합니다.

- Link Watcher 탭에서 link watcher 및 해당 설정의 선택적 설정을 설정합니다.

- OK를 클릭합니다.

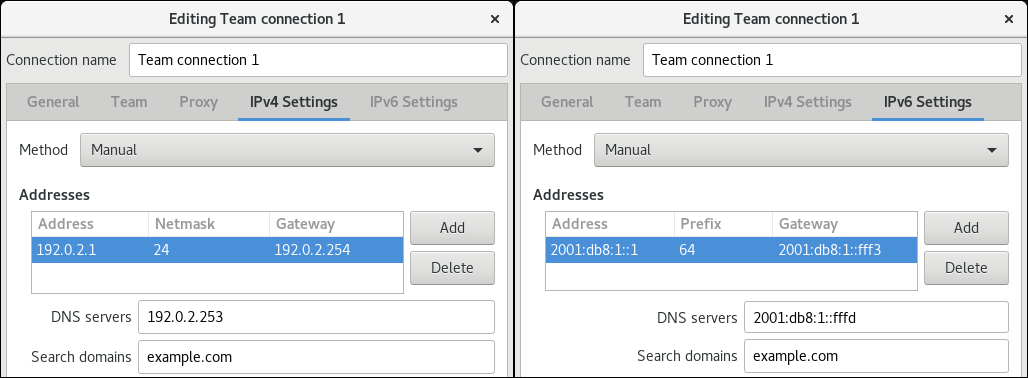

IPv4 설정 및 IPv6 설정 탭에서 IP 주소 설정을 구성합니다.

- 이 브리지 장치를 다른 장치의 포트로 사용하려면 Method 필드를 Disabled 로 설정합니다.

- DHCP를 사용하려면 Method 필드를 기본값인 Automatic(DHCP) 으로 둡니다.

고정 IP 설정을 사용하려면 Method 필드를 Manual 로 설정하고 그에 따라 필드를 작성합니다.

- 저장을 클릭합니다.

-

nm-connection-editor를 종료합니다.

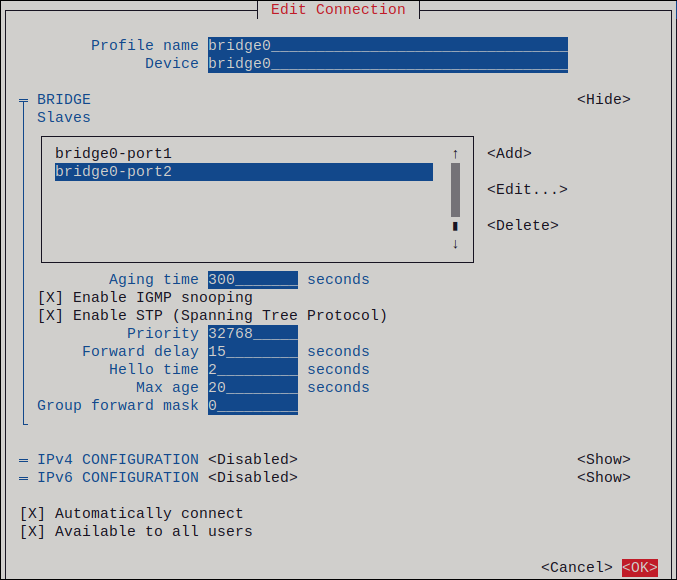

검증

팀 상태를 표시합니다.