RHEL 시스템 역할을 사용하여 시스템 관리 자동화

Red Hat Ansible Automation Platform 플레이북을 사용하여 여러 호스트에서 RHEL 배포의 일관되고 반복 가능한 구성

초록

보다 포괄적 수용을 위한 오픈 소스 용어 교체

Red Hat은 코드, 문서, 웹 속성에서 문제가 있는 용어를 교체하기 위해 최선을 다하고 있습니다. 먼저 마스터(master), 슬레이브(slave), 블랙리스트(blacklist), 화이트리스트(whitelist) 등 네 가지 용어를 교체하고 있습니다. 이러한 변경 작업은 작업 범위가 크므로 향후 여러 릴리스에 걸쳐 점차 구현할 예정입니다. 자세한 내용은 CTO Chris Wright의 메시지를 참조하십시오.

Red Hat 문서에 관한 피드백 제공

문서 개선을 위한 의견에 감사드립니다. 어떻게 개선할 수 있는지 알려주십시오.

Jira를 통해 피드백 제출 (등록 필요)

- Jira 웹 사이트에 로그인합니다.

- 상단 탐색 모음에서 생성 을 클릭합니다.

- 요약 필드에 설명 제목을 입력합니다.

- 설명 필드에 개선을 위한 제안을 입력합니다. 문서의 관련 부분에 대한 링크를 포함합니다.

- 대화 상자 하단에서 생성 을 클릭합니다.

1장. RHEL 시스템 역할 소개

RHEL 시스템 역할은 Ansible 역할 및 모듈의 컬렉션입니다. RHEL 시스템 역할을 사용하면 RHEL의 주요 버전에서 여러 RHEL 시스템의 시스템 구성을 원격으로 관리할 수 있습니다. 이 구성 요소를 사용하여 시스템을 구성하려면 다음 구성 요소를 사용해야 합니다.

- 제어 노드

- 제어 노드는 Ansible 명령 및 플레이북을 실행하는 시스템입니다. 제어 노드는 Ansible Automation Platform, Red Hat Satellite 또는 RHEL 9, 8 또는 7 호스트일 수 있습니다. 자세한 내용은 RHEL 9에서 제어 노드 준비를 참조하십시오.

- 관리형 노드

- 관리형 노드는 Ansible을 사용하여 관리하는 서버 및 네트워크 장치입니다. 관리 노드는 호스트라고도 합니다. Ansible을 관리형 노드에 설치할 필요가 없습니다. 자세한 내용은 관리 노드 준비를 참조하십시오.

- Ansible 플레이북

- 플레이북에서는 관리형 노드에서 수행할 구성을 정의하거나 수행할 관리 노드의 시스템 단계 세트를 정의합니다. Ansible 플레이북은 Ansible의 구성, 배포 및 오케스트레이션 언어입니다.

- 인벤토리

- 인벤토리 파일에서 관리 노드를 나열하고 각 관리 노드의 IP 주소와 같은 정보를 지정합니다. 인벤토리에서는 더 쉽게 스케일링할 수 있도록 그룹을 생성하고 중첩하여 관리 노드를 구성할 수도 있습니다. 인벤토리 파일은 hostfile이라고도 합니다.

Red Hat Enterprise Linux 9에서는 AppStream 리포지토리에서 사용할 수 있는 rhel-system-roles 패키지에서 제공하는 다음 역할을 사용할 수 있습니다.

| 역할 이름 | 역할 설명 | 장 제목 |

|---|---|---|

|

| 인증서 발급 및 갱신 | RHEL System Roles를 사용하여 인증서 요청 |

|

| 웹 콘솔 | RHEL 시스템 역할을 사용하여 웹 콘솔 설치 및 구성 |

|

| 시스템 전체 암호화 정책 | 시스템 전체에서 사용자 정의 암호화 정책 설정 |

|

| firewalld | 시스템 역할을 사용하여 firewalld 구성 |

|

| HA Cluster | 시스템 역할을 사용하여 고가용성 클러스터 구성 |

|

| 커널 덤프 | RHEL 시스템 역할을 사용하여 kdump 구성 |

|

| 커널 설정 | Ansible 역할을 사용하여 커널 매개변수 영구 구성 |

|

| 로깅 | 로깅 시스템 역할 사용 |

|

| 메트릭 (PCP) | RHEL 시스템 역할을 사용하여 성능 모니터링 |

|

| 네트워킹 | 네트워크 RHEL 시스템 역할을 사용하여 InfiniBand 연결 관리 |

|

| 네트워크 Bound 디스크 암호화 클라이언트 | nbde_client 및 nbde_server 시스템 역할 사용 |

|

| 네트워크 Bound 디스크 암호화 서버 | nbde_client 및 nbde_server 시스템 역할 사용 |

|

| Postfix | 시스템 역할에서 postfix 역할의 변수 |

|

| PostgreSQL | postgresql RHEL 시스템 역할을 사용하여 PostgreSQL 설치 및 구성 |

|

| SELinux | 시스템 역할을 사용하여 SELinux 구성 |

|

| SSH 클라이언트 | ssh 시스템 역할을 사용하여 보안 통신 구성 |

|

| SSH 서버 | ssh 시스템 역할을 사용하여 보안 통신 구성 |

|

| 스토리지 | RHEL 시스템 역할을 사용하여 로컬 스토리지 관리 |

|

| 터미널 세션 레코드 | tlog RHEL 시스템 역할을 사용하여 세션 레코딩을 위한 시스템 구성 |

|

| 시간 동기화 | RHEL 시스템 역할을 사용하여 시간 동기화 구성 |

|

| VPN | vpn RHEL 시스템 역할을 사용하여 IPsec과 VPN 연결 구성 |

추가 리소스

- Red Hat Enterprise Linux (RHEL) 시스템 역할

-

rhel-system-roles 패키지에서 제공하는 /usr/share/doc/rhel-system-roles/

2장. RHEL 시스템 역할을 사용하도록 제어 노드 및 관리형 노드 준비

개별 RHEL 시스템 역할을 사용하여 서비스 및 설정을 관리하려면 먼저 제어 노드 및 관리 노드를 준비해야 합니다.

2.1. RHEL 9에서 제어 노드 준비

RHEL 시스템 역할을 사용하기 전에 제어 노드를 구성해야 합니다. 그런 다음 이 시스템은 플레이북에 따라 인벤토리에서 관리 호스트를 구성합니다.

사전 요구 사항

- RHEL 8.6 이상이 설치되어 있어야 합니다. RHEL 설치에 대한 자세한 내용은 표준 RHEL 9 설치 수행을 참조하십시오.

- 시스템이 고객 포털에 등록되어 있습니다.

-

Red Hat Enterprise Linux Server서브스크립션이 시스템에 연결되어 있습니다. -

고객 포털 계정에서 사용 가능한 경우

Ansible Automation Platform서브스크립션이 시스템에 연결됩니다.

절차

rhel-system-roles패키지를 설치합니다.[root@control-node]# dnf install rhel-system-roles이 명령은

ansible-core패키지를 종속성으로 설치합니다.참고RHEL 8.5 및 이전 버전에서 Ansible 패키지는 Ansible Core 대신 Ansible Engine을 통해 제공되었으며 다른 수준의 지원이 제공되었습니다. 패키지가 RHEL 8.6 이상의 Ansible 자동화 콘텐츠와 호환되지 않을 수 있으므로 Ansible Engine을 사용하지 마십시오. 자세한 내용은 RHEL 9 및 RHEL 8.6 이상 AppStream 리포지토리에 포함된 Ansible Core 패키지에 대한 지원 범위를 참조하십시오.

ansible이라는 사용자를 생성하여 플레이북을 관리하고 실행합니다.[root@control-node]# useradd ansible새로 생성된

ansible사용자로 전환합니다.[root@control-node]# su - ansible이 사용자로 나머지 절차를 수행하십시오.

SSH 공개 및 개인 키를 생성합니다.

[ansible@control-node]$ ssh-keygen Generating public/private rsa key pair. Enter file in which to save the key (/home/ansible/.ssh/id_rsa): Enter passphrase (empty for no passphrase): <password> Enter same passphrase again: <password> ...

권장되는 기본 위치를 키 파일에 사용합니다.

- 선택 사항: Ansible에서 연결을 설정할 때마다 SSH 키 암호를 입력하라는 메시지를 표시하지 않도록 SSH 에이전트를 구성합니다.

다음 콘텐츠를 사용하여

~/.ansible.cfg파일을 생성합니다.[defaults] inventory = /home/ansible/inventory remote_user = ansible [privilege_escalation] become = True become_method = sudo become_user = root become_ask_pass = True

참고~/.ansible.cfg파일의 설정은 우선 순위가 높으며 글로벌/etc/ansible/ansible.cfg파일의 설정을 덮어씁니다.이러한 설정을 통해 Ansible은 다음 작업을 수행합니다.

- 지정된 인벤토리 파일의 호스트를 관리합니다.

-

관리 노드에 대한 SSH 연결을 설정할 때

remote_user매개변수에 설정된 계정을 사용합니다. -

sudo유틸리티를 사용하여 관리 노드에서root사용자로 작업을 실행합니다. - 플레이북을 적용할 때마다 원격 사용자의 루트 암호를 입력하라는 메시지를 표시합니다. 이는 보안상의 이유로 권장됩니다.

관리 호스트의 호스트 이름을 나열하는 INI 또는 YAML 형식으로

~/inventory파일을 생성합니다. 인벤토리 파일에서 호스트 그룹을 정의할 수도 있습니다. 예를 들어 다음은 3개의 호스트와US라는 호스트 그룹이 포함된 INI 형식의 인벤토리 파일입니다.managed-node-01.example.com [US] managed-node-02.example.com ansible_host=192.0.2.100 managed-node-03.example.com

제어 노드는 호스트 이름을 확인할 수 있어야 합니다. DNS 서버가 특정 호스트 이름을 확인할 수 없는 경우 호스트 항목 옆에

ansible_host매개 변수를 추가하여 IP 주소를 지정합니다.

다음 단계

- 관리형 노드를 준비합니다. 자세한 내용은 관리 노드 준비를 참조하십시오.

2.2. 관리형 노드 준비

관리형 노드는 인벤토리에 나열되는 시스템이며, 플레이북에 따라 제어 노드에서 구성합니다. 관리 호스트에 Ansible을 설치할 필요가 없습니다.

사전 요구 사항

- 제어 노드가 준비되었습니다. 자세한 내용은 RHEL 9에서 제어 노드 준비를 참조하십시오.

제어 노드에서 SSH 액세스 권한이 있어야 합니다.

중요root사용자로 직접 SSH 액세스는 보안 위험이 있습니다. 이 위험을 줄이기 위해 이 노드에 로컬 사용자를 생성하고 관리 노드를 준비할 때sudo정책을 구성합니다. 그런 다음 제어 노드의 Ansible은 로컬 사용자 계정을 사용하여 관리 노드에 로그인하고root와 같은 다른 사용자로 플레이북을 실행할 수 있습니다.

절차

ansible이라는 사용자를 생성합니다.[root@managed-node-01]# useradd ansible나중에 제어 노드는 이 사용자를 사용하여 이 호스트에 대한 SSH 연결을 설정합니다.

ansible사용자의 암호를 설정합니다.[root@managed-node-01]# passwd ansible Changing password for user ansible. New password: <password> Retype new password: <password> passwd: all authentication tokens updated successfully.

Ansible에서

sudo를 사용하여root사용자로 작업을 수행할 때 이 암호를 입력해야 합니다.관리 노드에

ansible사용자의 SSH 공개 키를 설치합니다.제어 노드에

ansible사용자로 로그인하고 SSH 공개 키를 관리 노드에 복사합니다.[ansible@control-node]$ ssh-copy-id managed-node-01.example.com /usr/bin/ssh-copy-id: INFO: Source of key(s) to be installed: "/home/ansible/.ssh/id_rsa.pub" The authenticity of host 'managed-node-01.example.com (192.0.2.100)' can't be established. ECDSA key fingerprint is SHA256:9bZ33GJNODK3zbNhybokN/6Mq7hu3vpBXDrCxe7NAvo.

프롬프트가 표시되면

yes를 입력하여 연결합니다.Are you sure you want to continue connecting (yes/no/[fingerprint])? yes /usr/bin/ssh-copy-id: INFO: attempting to log in with the new key(s), to filter out any that are already installed /usr/bin/ssh-copy-id: INFO: 1 key(s) remain to be installed -- if you are prompted now it is to install the new keys암호를 입력하라는 메시지가 표시되면 암호를 입력합니다.

ansible@managed-node-01.example.com's password: <password> Number of key(s) added: 1 Now try logging into the machine, with: "ssh '<managed-node-01.example.com>'" and check to make sure that only the key(s) you wanted were added.

제어 노드에서 명령을 원격으로 실행하여 SSH 연결을 확인합니다.

[ansible@control-node]$ ssh <managed-node-01.example.com> whoami ansible

ansible사용자에 대한sudo구성을 생성합니다.visudo명령을 사용하여/etc/sudoers.d/ansible파일을 만들고 편집합니다.[root@managed-node-01]# visudo /etc/sudoers.d/ansible일반 편집기에서

visudo를 사용할 때의 이점은 이 유틸리티에서 파일을 설치하기 전에 기본 온전성 검사를 제공하고 구문 분석 오류를 확인하는 것입니다.요구 사항을 충족하는

/etc/파일에서 sudoers 정책을 구성합니다. 예를 들면 다음과 같습니다.sudoers.d/ansibleansible사용자 암호를 입력한 후ansible사용자에게 모든 명령을 실행하여 이 호스트에서 모든 명령을 실행할 수 있는 권한을 부여하려면 다음을 사용합니다.ansible ALL=(ALL) ALLansible사용자에게ansible사용자 암호를 입력하지 않고 이 호스트에서 모든 명령을 실행할 수 있는 권한을 부여하려면 다음을 사용합니다.ansible ALL=(ALL) NOPASSWD: ALL

또는 보안 요구 사항과 일치하는 보다 세분화된 정책을 구성합니다.

sudoers정책에 대한 자세한 내용은sudoers(5)매뉴얼 페이지를 참조하십시오.

검증

모든 관리형 노드의 제어 노드에서 명령을 실행할 수 있는지 확인합니다.

[ansible@control-node]$ ansible all -m ping BECOME password: <password> managed-node-01.example.com | SUCCESS => { "ansible_facts": { "discovered_interpreter_python": "/usr/bin/python3" }, "changed": false, "ping": "pong" } ...

하드 코딩된 모든 그룹에는 인벤토리 파일에 나열된 모든 호스트가 동적으로 포함됩니다.

Ansible

command모듈을 사용하여 관리 호스트에서whoami유틸리티를 실행하여 권한 상승이 올바르게 작동하는지 확인합니다.[ansible@control-node]$ ansible managed-node-01.example.com -m command -a whoami BECOME password: <password> managed-node-01.example.com | CHANGED | rc=0 >> root

명령이 root를 반환하면 관리 노드에서

sudo를 올바르게 구성한 것입니다.

추가 리소스

- RHEL 9에서 제어 노드 준비.

-

sudoers(5)매뉴얼 페이지

3장. 컬렉션 설치 및 사용

3.1. Ansible 컬렉션 소개

Ansible Collections는 자동화를 배포, 유지 관리 및 사용하는 새로운 방법입니다. 플레이북, 역할, 모듈 및 플러그인과 같은 여러 유형의 Ansible 콘텐츠를 결합하여 유연성과 확장성을 개선할 수 있습니다.

Ansible 컬렉션은 기존 RHEL 시스템 역할 형식의 옵션입니다. Ansible Collection 형식에서 RHEL 시스템 역할을 사용하는 것은 기존 RHEL 시스템 역할 형식에서 사용하는 것과 거의 동일합니다. 차이점은 Ansible Collections가 네임스페이스 와 컬렉션 이름으로 구성된 정규화된 컬렉션 이름 (FQCN) 개념을 사용한다는 것입니다. 사용하는 네임스페이스 는 redhat 이며 컬렉션 이름은 rhel_system_roles 입니다. 따라서 kernel_settings 역할의 기존 RHEL 시스템 역할 형식은 rhel-system-roles.kernel_settings 로 표시되지만 kernel_settings 역할에 대해 정규화된 컬렉션 이름을 사용하여 rhel-system-roles.kernel_settings 로 표시됩니다.

네임스페이스 와 컬렉션 이름을 결합하면 오브젝트가 고유합니다. 또한 충돌 없이 Ansible 컬렉션 및 네임스페이스에서 오브젝트가 공유되도록 합니다.

추가 리소스

- Automation Hub 에 액세스하여 Red Hat Certified Collections를 사용하려면 AAP(Ansible Automation Platform)가 있어야 합니다.

3.2. 컬렉션 구조

컬렉션은 Ansible 콘텐츠의 패키지 형식입니다. 데이터 구조는 다음과 같습니다.

- docs/: 역할이 문서를 제공하는 경우 예제와 함께 컬렉션에 대한 로컬 설명서

- Galaxy.yml: Ansible Collection 패키지에 포함될 MANIFEST.json의 소스 데이터

playbooks/: Playbook은 여기에서 사용할 수 있습니다.

- tasks/: include_tasks/import_tasks 사용에 대해 '작업 목록 파일'이 있습니다.

plugins/: 모든 Ansible 플러그인 및 모듈을 여기에서 사용할 수 있으며, 각 플러그인의 하위 디렉터리

- modules/: Ansible 모듈

- modules_utils/: 모듈 개발을 위한 공통 코드

- lookup/: 플러그인 검색

- filter/: Jinja2 필터 플러그인

- connection/: 기본값을 사용하지 않는 경우 필요한 연결 플러그인

- roles/: Ansible 역할을 위한 디렉터리

- tests/: 컬렉션의 콘텐츠에 대한 테스트

3.3. CLI를 사용하여 컬렉션 설치

컬렉션은 플레이북, 역할, 모듈 및 플러그인을 포함할 수 있는 Ansible 콘텐츠의 배포 형식입니다.

Ansible Galaxy를 통해 또는 명령줄을 사용하여 컬렉션을 설치할 수 있습니다.

사전 요구 사항

- 하나 이상의 관리 노드에 대한 액세스 및 권한.

Red Hat Ansible Core가 기타 시스템을 구성하는 시스템인 제어 노드 액세스 및 사용 권한.

제어 노드에서 다음이 있어야 합니다.

-

ansible-core및rhel-system-roles패키지가 설치됩니다. - 관리 노드를 나열하는 인벤토리 파일이 있어야 합니다.

-

절차

RPM 패키지를 통해 컬렉션을 설치합니다.

# dnf install rhel-system-roles설치가 완료되면

redhat.rhel_system_roles.<role_name>으로 역할을 사용할 수 있습니다. 각 역할에 대한 설명서는/usr/share/ansible/collections/ansible_collections/redhat/rhel_system_roles/roles/<role_name>/README.md에서도 확인할 수 있습니다.

검증 단계

설치를 확인하려면 로컬 호스트에서 확인 모드로 kernel_settings 역할을 실행합니다. 그러나 kernel_settings 역할은 --check 모드에서 작동하지 않습니다. 제대로 작동하려면 --check 모드일 때 플레이북의 서비스 작업 및 config 작업을 건너뛰도록 변경해야 합니다. Ansible package 모듈에 필요하므로 --become 매개변수도 사용해야 합니다. 그러나 매개 변수는 시스템을 변경하지 않습니다.

다음 명령을 실행합니다.

$ ansible-playbook -c local -i localhost, --check --become /usr/share/ansible/collections/ansible_collections/redhat/rhel_system_roles/tests/kernel_settings/tests_default.yml

명령 출력의 마지막 줄에는 failed=0 값이 포함되어야 합니다.

localhost 이후의 쉼표는 필수입니다. 목록에 호스트가 하나만 있는 경우에도 추가해야 합니다. ansible-playbook 이 없으면 localhost 를 파일 또는 디렉터리로 식별합니다.

추가 리소스

-

ansible-playbook매뉴얼 페이지. -

ansible-playbook명령의-i옵션

3.4. Automation Hub에서 컬렉션 설치

Automation Hub를 사용하는 경우 Automation Hub에 호스팅되는 RHEL 시스템 역할 컬렉션을 설치할 수 있습니다.

사전 요구 사항

- 하나 이상의 관리 노드에 대한 액세스 및 권한.

Red Hat Ansible Core가 기타 시스템을 구성하는 시스템인 제어 노드 액세스 및 사용 권한.

제어 노드에서 다음이 있어야 합니다.

-

ansible-core및rhel-system-roles패키지가 설치됩니다. - 관리 노드를 나열하는 인벤토리 파일이 있어야 합니다.

-

절차

-

Red Hat Automation Hub를

ansible.cfg구성 파일에 있는 콘텐츠의 기본 소스로 정의합니다. 콘텐츠의 기본 소스로 Red Hat Automation Hub 구성을 참조하십시오. Automation Hub에서

redhat.rhel_system_roles컬렉션을 설치합니다.# ansible-galaxy collection install redhat.rhel_system_roles설치가 완료되면

redhat.rhel_system_roles.<role_name>으로 역할을 사용할 수 있습니다. 각 역할에 대한 설명서는/usr/share/ansible/collections/ansible_collections/redhat/rhel_system_roles/roles/<role_name>/README.md에서도 확인할 수 있습니다.

검증 단계

설치를 확인하려면 로컬 호스트에서 확인 모드로 kernel_settings 역할을 실행합니다. Ansible package 모듈에 필요하므로 --become 매개변수도 사용해야 합니다. 그러나 매개변수는 시스템을 변경하지 않습니다.

다음 명령을 실행합니다.

$ ansible-playbook -c local -i localhost, --check --become /usr/share/ansible/collections/ansible_collections/redhat/rhel_system_roles/tests/kernel_settings/tests_default.yml

명령 출력의 마지막 줄에는 failed=0 값이 포함되어야 합니다.

localhost 이후의 쉼표는 필수입니다. 목록에 호스트가 하나만 있는 경우에도 추가해야 합니다. ansible-playbook 이 없으면 localhost 를 파일 또는 디렉터리로 식별합니다.

추가 리소스

-

ansible-playbook매뉴얼 페이지. -

ansible-playbook명령의-i옵션

3.5. 컬렉션을 사용하여 tlog RHEL 시스템 역할 배포

다음은 컬렉션을 사용하여 플레이북을 준비 및 적용하여 별도의 머신 세트에 로깅 솔루션을 배포하는 예입니다.

사전 요구 사항

- Galaxy 컬렉션이 설치되어 있습니다.

절차

다음 내용으로 새

playbook.yml파일을 생성합니다.--- - name: Deploy session recording hosts: all vars: tlog_scope_sssd: some tlog_users_sssd: - recordeduser roles: - redhat.rhel-system-roles.tlog여기서,

tlog_scope_sssd:-

some은 일부 또는none이 아닌 특정 사용자 및 그룹만 기록할 것을 지정합니다.

-

tlog_users_sssd:-

recordeduser는 세션을 기록할 사용자를 지정합니다. 이 경우 사용자가 추가되지 않습니다. 사용자가 직접 설정해야합니다.

-

필요한 경우 플레이북 구문을 확인합니다.

# ansible-playbook --syntax-check playbook.yml인벤토리 파일에서 플레이북을 실행합니다.

# ansible-playbook -i IP_Address /path/to/file/playbook.yml -v

결과적으로 Playbook은 지정한 시스템에 tlog 역할을 설치합니다. 또한 사용자가 정의한 사용자 및 그룹에서 사용할 수 있는 SSSD 구성 드롭 파일을 생성합니다. SSSD는 이러한 사용자와 그룹을 구문 분석하고 읽고 쉘 사용자로 tlog 세션을 오버레이합니다. 또한 cockpit 패키지가 시스템에 설치된 경우 플레이북은 웹 콘솔 인터페이스에서 레코딩을 보고 재생할 수 있는 Cockpit 모듈인 cockpit-session-recording 패키지도 설치합니다.

검증 단계

/etc/ECDHE.conf 파일의 구문을 테스트합니다.# rsyslogd -N 1 rsyslogd: version 8.1911.0-6.el8, config validation run (level 1), master config /etc/rsyslog.conf rsyslogd: End of config validation run. Bye.

- 시스템이 로그에 메시지를 전송하는지 확인합니다.

SSSD 구성 드롭 파일이 시스템에 생성되었는지 확인하려면 다음 단계를 수행합니다.

SSSD 구성 드롭 파일이 생성되는 폴더로 이동합니다.

# cd /etc/sssd/conf.d/파일 내용을 확인합니다.

# cat sssd-session-recording.conf파일에 플레이북에서 설정한 매개변수가 포함되어 있음을 확인할 수 있습니다.

4장. RHEL의 Ansible IPMI 모듈

4.1. rhel_mgmt 컬렉션

IPMI(Intelligent Platform Management Interface)는 BMC(Baseboard Management Controller) 장치와 통신하기 위한 표준 프로토콜 집합의 사양입니다. IPMI 모듈을 사용하면 하드웨어 관리 자동화를 활성화하고 지원할 수 있습니다. IPMI 모듈은 다음에서 사용할 수 있습니다.

-

rhel_mgmt컬렉션 패키지 이름은ansible-collection-redhat-rhel_mgmt입니다. -

새로운

ansible-collection-redhat-rhel_mgmt패키지의 일부로 RHEL 8 AppStream.

다음 IPMI 모듈은 rhel_mgmt 컬렉션에서 사용할 수 있습니다.

-

ipmi_boot: 부팅 장치 순서 관리 -

ipmi_power: 머신의 전원 관리

IPMI 모듈에 사용되는 필수 매개변수는 다음과 같습니다.

-

ipmi_boot매개변수:

| 모듈 이름 | 설명 |

|---|---|

| name | BMC의 호스트 이름 또는 IP 주소 |

| 암호 | BMC에 연결할 암호입니다. |

| bootdev | 다음 부팅에서 사용할 장치 * 네트워크 * 플로피 *HD * 안전 * 최적 * 설정 * 기본 |

| 사용자 | BMC에 연결할 사용자 이름 |

-

ipmi_power매개변수:

| 모듈 이름 | 설명 |

|---|---|

| name | BMC 호스트 이름 또는 IP 주소 |

| 암호 | BMC에 연결할 암호입니다. |

| user | BMC에 연결할 사용자 이름 |

| 상태 | 시스템이 원하는 상태에 있는지 확인 * On * off * 종료 * 재설정 * 부팅 |

4.2. CLI를 사용하여 rhel mgmt 컬렉션 설치

명령줄을 사용하여 rhel_mgmt 컬렉션을 설치할 수 있습니다.

사전 요구 사항

-

ansible-core패키지가 설치되어 있습니다.

절차

RPM 패키지를 통해 컬렉션을 설치합니다.

# yum install ansible-collection-redhat-rhel_mgmt설치가 완료되면

redhat.rhel_mgmtAnsible 컬렉션에서 IPMI 모듈을 사용할 수 있습니다.

추가 리소스

-

ansible-playbook매뉴얼 페이지.

4.3. ipmi_boot 모듈 사용 예

다음 예제는 플레이북에서 ipmi_boot 모듈을 사용하여 다음 부팅에 대한 부팅 장치를 설정하는 방법을 보여줍니다. 간단히 하기 위해 예제에서는 Ansible 제어 호스트 및 관리 호스트와 동일한 호스트를 사용하므로 플레이북이 실행되는 동일한 호스트에서 모듈을 실행합니다.

사전 요구 사항

- rhel_mgmt 컬렉션이 설치되어 있어야 합니다.

python3-패키지의 pyghmi 라이브러리는 다음 위치 중 하나에 설치됩니다.pyghmi- 플레이북을 실행하는 호스트입니다.

-

관리 호스트 localhost를 관리 호스트로 사용하는 경우 대신 플레이북을 실행하는 호스트에

python3-pyghmi패키지를 설치합니다.

- 제어하려는 IPMI BMC는 플레이북을 실행하는 호스트에서 네트워크를 통해 또는 localhost를 관리 호스트로 사용하지 않는 경우 관리 호스트를 통해 액세스할 수 있습니다. 모듈에서 BMC를 구성하는 호스트는 일반적으로 모듈이 실행되는 호스트(Ansible 관리 호스트)가 IPMI 프로토콜을 사용하여 네트워크를 통해 BMC에 연결하므로 호스트와 다릅니다.

- 적절한 수준의 액세스 권한을 사용하여 BMC에 액세스할 수 있는 인증 정보가 있습니다.

절차

다음 내용으로 새 playbook.yml 파일을 생성합니다.

--- - name: Sets which boot device will be used on next boot hosts: localhost tasks: - redhat.rhel_mgmt.ipmi_boot: name: bmc.host.example.com user: admin_user password: basics bootdev: hdlocalhost에 대해 플레이북을 실행합니다.

# ansible-playbook playbook.yml

결과적으로 출력은 "success" 값을 반환합니다.

4.4. ipmi_power 모듈 사용 예

이 예제에서는 플레이북에서 ipmi_boot 모듈을 사용하여 시스템이 설정되어 있는지 확인하는 방법을 보여줍니다. 간단히 하기 위해 예제에서는 Ansible 제어 호스트 및 관리 호스트와 동일한 호스트를 사용하므로 플레이북이 실행되는 동일한 호스트에서 모듈을 실행합니다.

사전 요구 사항

- rhel_mgmt 컬렉션이 설치되어 있어야 합니다.

python3-패키지의 pyghmi 라이브러리는 다음 위치 중 하나에 설치됩니다.pyghmi- 플레이북을 실행하는 호스트입니다.

-

관리 호스트 localhost를 관리 호스트로 사용하는 경우 대신 플레이북을 실행하는 호스트에

python3-pyghmi패키지를 설치합니다.

- 제어하려는 IPMI BMC는 플레이북을 실행하는 호스트에서 네트워크를 통해 또는 localhost를 관리 호스트로 사용하지 않는 경우 관리 호스트를 통해 액세스할 수 있습니다. 모듈에서 BMC를 구성하는 호스트는 일반적으로 모듈이 실행되는 호스트(Ansible 관리 호스트)가 IPMI 프로토콜을 사용하여 네트워크를 통해 BMC에 연결하므로 호스트와 다릅니다.

- 적절한 수준의 액세스 권한을 사용하여 BMC에 액세스할 수 있는 인증 정보가 있습니다.

절차

다음 내용으로 새 playbook.yml 파일을 생성합니다.

--- - name: Turn the host on hosts: localhost tasks: - redhat.rhel_mgmt.ipmi_power: name: bmc.host.example.com user: admin_user password: basics state: on플레이북을 실행합니다.

# ansible-playbook playbook.yml

출력에서 "true" 값을 반환합니다.

5장. RHEL의 Redfish 모듈

이제 장치의 원격 관리를 위한 Redfish 모듈이 redhat.rhel_mgmt Ansible 컬렉션에 포함됩니다. Redfish 모듈을 사용하면 표준 HTTPS 전송 및 JSON 형식을 사용하여 서버에 대한 정보를 얻거나 OOB(Out-Of-Band) 컨트롤러를 통해 서버를 제어하는 방식으로 베어 메탈 서버 및 플랫폼 하드웨어에서 관리 자동화를 쉽게 사용할 수 있습니다.

5.1. Redfish 모듈

redhat.rhel_mgmt Ansible 컬렉션은 Redfish를 통해 Ansible에서 하드웨어 관리를 지원하는 Redfish 모듈을 제공합니다. redhat.rhel_mgmt 컬렉션은 ansible-collection-redhat-rhel_mgmt 패키지에서 사용할 수 있습니다. 설치하려면 CLI를 사용하여 redhat.rhel_mgmt 컬렉션 설치를 참조하십시오.

다음 Redfish 모듈은 redhat.rhel_mgmt 컬렉션에서 사용할 수 있습니다.

-

redfish_info:redfish_info모듈은 시스템 인벤토리와 같은 원격 OOB(Out-Of-Band) 컨트롤러에 대한 정보를 검색합니다. -

redfish_command:redfish_command모듈은 로그 관리 및 사용자 관리와 같은 OOB(Out-Of-Band) 컨트롤러 작업과 시스템 재시작, 전원 켜기 및 off와 같은 전원 작업을 수행합니다. -

redfish_config:redfish_config모듈은 OOB 구성 변경 또는 BIOS 구성 설정과 같은 OOB 컨트롤러 작업을 수행합니다.

5.2. Redfish 모듈 매개변수

Redfish 모듈에 사용되는 매개변수는 다음과 같습니다.

redfish_info parameters: | 설명 |

|---|---|

|

| (필수) - OOB 컨트롤러의 기본 URI입니다. |

|

| (필수) - OOB 컨트롤러에서 실행할 카테고리 목록입니다. 기본값은 ["Systems"]입니다. |

|

| (필수) - OOB 컨트롤러에서 실행할 명령 목록입니다. |

|

| OOB 컨트롤러에 대한 인증에 대한 사용자 이름입니다. |

|

| OOB 컨트롤러에 대한 인증 암호입니다. |

redfish_command 매개변수: | 설명 |

|---|---|

|

| (필수) - OOB 컨트롤러의 기본 URI입니다. |

|

| (필수) - OOB 컨트롤러에서 실행할 카테고리 목록입니다. 기본값은 ["Systems"]입니다. |

|

| (필수) - OOB 컨트롤러에서 실행할 명령 목록입니다. |

|

| OOB 컨트롤러에 대한 인증에 대한 사용자 이름입니다. |

|

| OOB 컨트롤러에 대한 인증 암호입니다. |

redfish_config parameters: | 설명 |

|---|---|

|

| (필수) - OOB 컨트롤러의 기본 URI입니다. |

|

| (필수) - OOB 컨트롤러에서 실행할 카테고리 목록입니다. 기본값은 ["Systems"]입니다. |

|

| (필수) - OOB 컨트롤러에서 실행할 명령 목록입니다. |

|

| OOB 컨트롤러에 대한 인증에 대한 사용자 이름입니다. |

|

| OOB 컨트롤러에 대한 인증 암호입니다. |

|

| 업데이트할 BIOS 속성입니다. |

5.3. redfish_info 모듈 사용

다음 예제는 플레이북에서 redfish_info 모듈을 사용하여 CPU 인벤토리에 대한 정보를 가져오는 방법을 보여줍니다. 간단히 하기 위해 예제에서는 Ansible 제어 호스트 및 관리 호스트와 동일한 호스트를 사용하므로 플레이북이 실행되는 동일한 호스트에서 모듈을 실행합니다.

사전 요구 사항

-

redhat.rhel_mgmt컬렉션이 설치되어 있습니다. -

python3-패키지의 pyghmi 라이브러리는 관리 호스트에 설치됩니다. localhost를 관리 호스트로 사용하는 경우 플레이북을 실행하는 호스트에pyghmipython3-pyghmi패키지를 설치합니다. - OOB 컨트롤러 액세스 세부 정보.

절차

다음 내용으로 새 playbook.yml 파일을 생성합니다.

--- - name: Get CPU inventory hosts: localhost tasks: - redhat.rhel_mgmt.redfish_info: baseuri: "{{ baseuri }}" username: "{{ username }}" password: "{{ password }}" category: Systems command: GetCpuInventory register: resultlocalhost에 대해 플레이북을 실행합니다.

# ansible-playbook playbook.yml

결과적으로 출력은 CPU 인벤토리 세부 정보를 반환합니다.

5.4. redfish_command 모듈 사용

다음 예제는 플레이북에서 redfish_command 모듈을 사용하여 시스템을 설정하는 방법을 보여줍니다. 간단히 하기 위해 예제에서는 Ansible 제어 호스트 및 관리 호스트와 동일한 호스트를 사용하므로 플레이북이 실행되는 동일한 호스트에서 모듈을 실행합니다.

사전 요구 사항

-

redhat.rhel_mgmt컬렉션이 설치되어 있습니다. -

python3-패키지의 pyghmi 라이브러리는 관리 호스트에 설치됩니다. localhost를 관리 호스트로 사용하는 경우 플레이북을 실행하는 호스트에pyghmipython3-pyghmi패키지를 설치합니다. - OOB 컨트롤러 액세스 세부 정보.

절차

다음 내용으로 새 playbook.yml 파일을 생성합니다.

--- - name: Power on system hosts: localhost tasks: - redhat.rhel_mgmt.redfish_command: baseuri: "{{ baseuri }}" username: "{{ username }}" password: "{{ password }}" category: Systems command: PowerOnlocalhost에 대해 플레이북을 실행합니다.

# ansible-playbook playbook.yml

그 결과 시스템은 전원을 켭니다.

5.5. redfish_config 모듈 사용

다음 예제는 플레이북에서 redfish_config 모듈을 사용하여 UEFI로 부팅할 시스템을 구성하는 방법을 보여줍니다. 간단히 하기 위해 예제에서는 Ansible 제어 호스트 및 관리 호스트와 동일한 호스트를 사용하므로 플레이북이 실행되는 동일한 호스트에서 모듈을 실행합니다.

사전 요구 사항

-

redhat.rhel_mgmt컬렉션이 설치되어 있습니다. -

python3-패키지의 pyghmi 라이브러리는 관리 호스트에 설치됩니다. localhost를 관리 호스트로 사용하는 경우 플레이북을 실행하는 호스트에pyghmipython3-pyghmi패키지를 설치합니다. - OOB 컨트롤러 액세스 세부 정보.

절차

다음 내용으로 새 playbook.yml 파일을 생성합니다.

--- - name: "Set BootMode to UEFI" hosts: localhost tasks: - redhat.rhel_mgmt.redfish_config: baseuri: "{{ baseuri }}" username: "{{ username }}" password: "{{ password }}" category: Systems command: SetBiosAttributes bios_attributes: BootMode: Uefilocalhost에 대해 플레이북을 실행합니다.

# ansible-playbook playbook.yml

결과적으로 시스템 부팅 모드가 UEFI로 설정됩니다.

6장. kernel_settings RHEL 시스템 역할을 사용하여 영구적으로 커널 매개변수 구성

kernel_settings 역할을 사용하여 여러 클라이언트에서 커널 매개변수를 한 번에 구성할 수 있습니다. 이 해결 방법:

- 효율적인 입력 설정으로 친숙한 인터페이스를 제공합니다.

- 의도한 모든 커널 매개 변수를 한 곳에 유지합니다.

제어 머신에서 kernel_settings 역할을 실행하면 커널 매개 변수가 관리 시스템에 즉시 적용되고 재부팅 시 지속됩니다.

RHEL 채널을 통해 제공되는 RHEL 시스템 역할은 RHEL 고객이 기본 AppStream 리포지토리에서 RPM 패키지로 사용할 수 있습니다. RHEL 시스템 역할은 Ansible Automation Hub를 통해 Ansible 서브스크립션이 있는 고객에게 컬렉션으로 사용할 수도 있습니다.

6.1. kernel_settings 역할 소개

RHEL 시스템 역할은 여러 시스템을 원격으로 관리하기 위한 일관된 구성 인터페이스를 제공하는 역할 집합입니다.

kernel_settings 시스템 역할을 사용하여 커널의 자동화된 구성을 위해 RHEL 시스템 역할이 도입되었습니다. rhel-system-roles 패키지에는 이 시스템 역할과 참조 문서가 포함되어 있습니다.

자동화된 방식으로 하나 이상의 시스템에서 커널 매개 변수를 적용하려면 플레이북에서 선택한 역할 변수 중 하나 이상과 함께 kernel_settings 역할을 사용합니다. 플레이북은 사람이 읽을 수 있는 하나 이상의 플레이 목록으로, YAML 형식으로 작성됩니다.

kernel_settings 역할을 사용하면 다음을 구성할 수 있습니다.

-

kernel_settings_sysctl역할 변수를 사용하는 커널 매개변수 -

kernel_settings_sysfs역할 변수를 사용하는 다양한 커널 하위 시스템, 하드웨어 장치, 장치 드라이버 -

systemd서비스 관리자의 CPU 선호도 및kernel_settings_systemd_cpu_affinity역할 변수를 사용하여 포크를 처리합니다. -

커널 메모리 하위 시스템은 kernel_settings_transparent_hugepages 및

kernel_settings_transparent_hugepages_defrag 역할 변수를 사용하여 hugepages를 투명하게

추가 리소스

-

/usr/share/doc/rhel-system-roles/kernel_settings/디렉터리의README.md및README.html파일 - 플레이북 작업

- 인벤토리를 빌드하는 방법

6.2. kernel_settings 역할을 사용하여 선택한 커널 매개변수 적용

다음 단계에 따라 Ansible 플레이북을 준비 및 적용하여 여러 관리 운영 체제에 지속적으로 영향을 미치는 커널 매개 변수를 원격으로 구성합니다.

사전 요구 사항

-

root권한이 있습니다. -

RHEL 서브스크립션에서 권한을 부여한 경우 제어 시스템에

ansible-core및rhel-system-roles패키지를 설치했습니다. - 관리 호스트의 인벤토리는 제어 시스템에 있으며 Ansible은 해당 호스트에 연결할 수 있습니다.

RHEL 8.0 - 8.5는 Ansible 기반 자동화를 위해 Ansible Engine 2.9가 포함된 별도의 Ansible 리포지토리에 대한 액세스를 제공했습니다. Ansible Engine에는 ansible , 과 같은 명령줄 유틸리티, ansible -playbookdocker 및 podman 과 같은 커넥터, 플러그인 및 모듈 전체 환경이 포함되어 있습니다. Ansible Engine을 확보하고 설치하는 방법에 대한 자세한 내용은 How do I download and Install Red Hat Ansible Engine 을 참조하십시오.

RHEL 8.6 및 9.0에는 Ansible 명령줄 유틸리티, 명령 및 일부 기본 제공 Ansible 플러그인 세트가 포함된 Ansible Core( ansible-core RPM으로 제공됨)가 도입되었습니다. AppStream 리포지토리에서는 제한된 지원 범위가 있는 ansible-core 를 제공합니다. RHEL 9 AppStream에 포함된 ansible-core 패키지의 지원 범위를 확인하여 자세한 내용을 확인할 수 있습니다.

절차

선택적으로 설명을 위해

인벤토리파일을 검토합니다.# cat /home/jdoe/<ansible_project_name>/inventory [testingservers] pdoe@192.168.122.98 fdoe@192.168.122.226 [db-servers] db1.example.com db2.example.com [webservers] web1.example.com web2.example.com 192.0.2.42파일은

[testingservers]그룹 및 기타 그룹을 정의합니다. 이를 통해 특정 시스템 세트에 대해 보다 효율적으로 Ansible을 실행할 수 있습니다.구성 파일을 생성하여 Ansible 작업에 대한 기본값 및 권한 에스컬레이션을 설정합니다.

새 YAML 파일을 생성하고 텍스트 편집기에서 엽니다. 예를 들면 다음과 같습니다.

# vi /home/jdoe/<ansible_project_name>/ansible.cfg다음 내용을 파일에 삽입합니다.

[defaults] inventory = ./inventory [privilege_escalation] become = true become_method = sudo become_user = root become_ask_pass = true

[defaults]섹션은 관리 호스트의 인벤토리 파일에 대한 경로를 지정합니다.[privilege_escalation]섹션은 지정된 관리 호스트에서 사용자 권한을root로 이동하는 것을 정의합니다. 이는 커널 매개 변수를 성공적으로 구성하려면 필요합니다. Ansible 플레이북이 실행되면 사용자 암호를 입력하라는 메시지가 표시됩니다. 사용자는 관리 호스트에 연결한 후sudo를 통해 자동으로root로 전환합니다.

kernel_settings역할을 사용하는 Ansible 플레이북을 생성합니다.새 YAML 파일을 생성하고 텍스트 편집기에서 엽니다. 예를 들면 다음과 같습니다.

# vi /home/jdoe/<ansible_project_name>/kernel-roles.yml이 파일은 플레이북을 나타내며 일반적으로

인벤토리파일에서 선택한 특정 관리 호스트에 대해 실행되는 플레이 라고도 하는 정렬된 작업 목록이 포함되어 있습니다.다음 내용을 파일에 삽입합니다.

--- - hosts: testingservers name: "Configure kernel settings" roles: - rhel-system-roles.kernel_settings vars: kernel_settings_sysctl: - name: fs.file-max value: 400000 - name: kernel.threads-max value: 65536 kernel_settings_sysfs: - name: /sys/class/net/lo/mtu value: 65000 kernel_settings_transparent_hugepages: madvisename키는 선택 사항입니다. 임의의 문자열과 플레이를 레이블로 연결하고 플레이의 용도를 식별합니다. 플레이의hosts키는 플레이가 실행되는 호스트를 지정합니다. 이 키의 값 또는 값은 관리 호스트의 개별 이름 또는인벤토리파일에 정의된 호스트 그룹으로 제공될 수 있습니다.vars섹션은 선택한 커널 매개 변수 이름과 설정해야 할 값이 포함된 변수 목록을 나타냅니다.roles키는vars섹션에 언급된 매개변수 및 값을 구성할 시스템 역할을 지정합니다.참고필요에 맞게 플레이북에서 커널 매개변수와 해당 값을 수정할 수 있습니다.

필요한 경우 플레이의 구문이 올바른지 확인합니다.

# ansible-playbook --syntax-check kernel-roles.yml playbook: kernel-roles.yml이 예제에서는 플레이북의 성공적인 확인을 보여줍니다.

플레이북을 실행합니다.

# ansible-playbook kernel-roles.yml ... BECOME password: PLAY [Configure kernel settings] ********************************************************************************** PLAY RECAP ******************************************************************************************************** fdoe@192.168.122.226 : ok=10 changed=4 unreachable=0 failed=0 skipped=6 rescued=0 ignored=0 pdoe@192.168.122.98 : ok=10 changed=4 unreachable=0 failed=0 skipped=6 rescued=0 ignored=0Ansible에서 플레이북을 실행하기 전에 암호를 입력하라는 메시지가 표시되므로 관리 호스트의 사용자가 커널 매개 변수를 구성하는 데 필요한

root로 전환할 수 있습니다.recap 섹션에서는 모든 관리 호스트에 대해 플레이가 성공적으로 완료되었습니다(

failed=0). 4 커널 매개 변수가 적용됨(changed=4).- 관리 호스트를 다시 시작하고 영향을 받는 커널 매개변수를 확인하여 변경 사항이 적용되었는지 확인하고 재부팅해도 유지됩니다.

추가 리소스

- RHEL 시스템 역할을 사용하도록 제어 노드 및 관리형 노드 준비

-

/usr/share/doc/rhel-system-roles/kernel_settings/디렉터리의README.html및README.md파일 - 인벤토리 빌드

- Ansible 구성

- 플레이북 작업

- 변수 사용

- 역할

7장. rhc 시스템 역할을 사용하여 시스템 등록

rhc RHEL 시스템 역할을 통해 관리자는 RHSM(Red Hat Subscription Management) 및 Satellite 서버를 사용하여 여러 시스템의 등록을 자동화할 수 있습니다. 이 역할은 Ansible을 사용하여 Insights 관련 구성 및 관리 작업도 지원합니다.

7.1. rhc 시스템 역할 소개

RHEL 시스템 역할은 여러 시스템을 원격으로 관리할 수 있도록 일관된 구성 인터페이스를 제공하는 역할 집합입니다. 원격 호스트 구성(rhc) 시스템 역할을 통해 관리자는 RHEL 시스템을 RHSM(Red Hat Subscription Management) 및 Satellite 서버에 쉽게 등록할 수 있습니다. 기본적으로 rhc 시스템 역할을 사용하여 시스템을 등록하면 시스템이 Insights에 연결됩니다. 또한 rhc 시스템 역할을 사용하면 다음을 수행할 수 있습니다.

- Red Hat Insights에 대한 연결 구성

- 리포지토리 활성화 및 비활성화

- 연결에 사용할 프록시 구성

- 인사이트 수정 및 자동 업데이트 구성

- 시스템 릴리스 설정

- Insights 태그 구성

7.2. rhc 시스템 역할을 사용하여 시스템 등록

rhc RHEL 시스템 역할을 사용하여 시스템을 Red Hat에 등록할 수 있습니다. 기본적으로 rhc RHEL 시스템 역할은 등록할 때 시스템을 Red Hat Insights에 연결합니다.

사전 요구 사항

- 제어 노드와 관리형 노드가 준비되었습니다.

- 관리 노드에서 플레이북을 실행할 수 있는 사용자로 제어 노드에 로그인되어 있습니다.

-

관리형 노드에 연결하는 데 사용하는 계정에는

sudo권한이 있습니다. - 이 플레이북을 실행하려는 관리형 노드 또는 관리형 노드 그룹은 Ansible 인벤토리 파일에 나열됩니다.

절차

중요한 정보를 저장할 자격 증명 모음을 생성합니다.

$ ansible-vault create secrets.yml New Vault password: password Confirm New Vault password: password

ansible-vault create명령은 암호화된 자격 증명 모음 파일을 생성하여 편집기에서 엽니다. 자격 증명 모음에 저장할 중요한 데이터를 입력합니다. 예를 들면 다음과 같습니다.activationKey: activation_key username: username password: password

변경 사항을 저장하고 편집기를 종료합니다. Ansible은 자격 증명 모음의 데이터를 암호화합니다.

나중에

ansible-vault edit secrets.yml명령을 사용하여 자격 증명 모음의 데이터를 편집할 수 있습니다.선택 사항: 자격 증명 모음 콘텐츠를 표시합니다.

$ ansible-vault view

secrets.yml플레이북 파일(예:

~/registration.yml)을 생성하고 수행할 작업에 따라 다음 옵션 중 하나를 사용합니다.활성화 키 및 조직 ID(권장)를 사용하여 등록하려면 다음 플레이북을 사용합니다.

--- - name: Registering system using activation key and organization ID hosts: managed-node-01.example.com vars_files: - secrets.yml vars: rhc_auth: activation_keys: keys: - "{{ activationKey }}" rhc_organization: organizationID roles: - role: rhel-system-roles.rhc

사용자 이름과 암호를 사용하여 등록하려면 다음 플레이북을 사용합니다.

--- - name: Registering system with username and password hosts: managed-node-01.example.com vars_files: - secrets.yml vars: rhc_auth: login: username: "{{ username }}" password: "{{ password }}" roles: - role: rhel-system-roles.rhc

플레이북을 실행합니다.

# ansible-playbook ~/registration.yml --ask-vault-pass

추가 리소스

-

/usr/share/ansible/roles/rhel-system-roles.rhc/README.md파일

7.3. rhc 시스템 역할을 사용하여 Satellite로 시스템 등록

조직에서 Satellite를 사용하여 시스템을 관리하는 경우 Satellite를 통해 시스템을 등록해야 합니다. rhc RHEL 시스템 역할을 사용하여 Satellite에 시스템을 원격으로 등록할 수 있습니다.

사전 요구 사항

- 제어 노드와 관리형 노드가 준비되었습니다.

- 관리 노드에서 플레이북을 실행할 수 있는 사용자로 제어 노드에 로그인되어 있습니다.

-

관리형 노드에 연결하는 데 사용하는 계정에는

sudo권한이 있습니다. - 이 플레이북을 실행하려는 관리형 노드 또는 관리형 노드 그룹은 Ansible 인벤토리 파일에 나열됩니다.

절차

중요한 정보를 저장할 자격 증명 모음을 생성합니다.

$ ansible-vault create secrets.yml New Vault password: password Confirm New Vault password: password

ansible-vault create명령은 암호화된 파일을 생성하여 편집기에서 엽니다. 자격 증명 모음에 저장할 중요한 데이터를 입력합니다. 예를 들면 다음과 같습니다.activationKey: activation_key변경 사항을 저장하고 편집기를 종료합니다. Ansible은 자격 증명 모음의 데이터를 암호화합니다.

나중에

ansible-vault edit secrets.yml명령을 사용하여 자격 증명 모음의 데이터를 편집할 수 있습니다.선택 사항: 자격 증명 모음 콘텐츠를 표시합니다.

$ ansible-vault view

secrets.yml-

~/registration-sat.yml과 같은 플레이북 파일을 생성합니다. ~/registration-sat.yml에서 다음 텍스트를 사용하여 활성화 키 및 조직 ID를 사용하여 시스템을 등록합니다.--- - name: Register to the custom registration server and CDN hosts: managed-node-01.example.com vars_files: - secrets.yml vars: rhc_auth: login: activation_keys: keys: - "{{ activationKey }}" rhc_organization: organizationID rhc_server: hostname: example.com port: 443 prefix: /rhsm rhc_baseurl: http://example.com/pulp/content roles: - role: rhel-system-roles.rhc

플레이북을 실행합니다.

# ansible-playbook ~/registration-sat.yml --ask-vault-pass

추가 리소스

-

/usr/share/ansible/roles/rhel-system-roles.rhc/README.md파일

7.4. rhc 시스템 역할을 사용하여 등록 후 Insights에 대한 연결 비활성화

rhc RHEL 시스템 역할을 사용하여 시스템을 등록하면 기본적으로 Red Hat Insights에 연결할 수 있습니다. 필요하지 않은 경우 rhc 시스템 역할을 사용하여 비활성화할 수 있습니다.

사전 요구 사항

- 제어 노드와 관리형 노드가 준비되었습니다.

- 관리 노드에서 플레이북을 실행할 수 있는 사용자로 제어 노드에 로그인되어 있습니다.

-

관리형 노드에 연결하는 데 사용하는 계정에는

sudo권한이 있습니다. - 이 플레이북을 실행하려는 관리형 노드 또는 관리형 노드 그룹은 Ansible 인벤토리 파일에 나열됩니다.

- 시스템이 이미 등록되어 있습니다.

절차

~/dis-insights.yml과 같은 플레이북 파일을 생성하고 여기에 다음 내용을 추가합니다.--- - name: Disable Insights connection hosts: managed-node-01.example.com vars: rhc_insights: state: absent roles: - role: rhel-system-roles.rhc

플레이북을 실행합니다.

# ansible-playbook ~/dis-insights.yml

추가 리소스

-

/usr/share/ansible/roles/rhel-system-roles.rhc/README.md파일

7.5. rhc 시스템 역할을 사용하여 리포지토리 활성화

rhc RHEL 시스템 역할을 사용하여 관리 노드에서 리포지토리를 원격으로 활성화하거나 비활성화할 수 있습니다.

사전 요구 사항

- 제어 노드와 관리형 노드가 준비되었습니다.

- 관리 노드에서 플레이북을 실행할 수 있는 사용자로 제어 노드에 로그인되어 있습니다.

-

관리형 노드에 연결하는 데 사용하는 계정에는

sudo권한이 있습니다. - 이 플레이북을 실행하려는 관리형 노드 또는 관리형 노드 그룹은 Ansible 인벤토리 파일에 나열됩니다.

- 관리형 노드에서 활성화하거나 비활성화하려는 리포지토리에 대한 세부 정보가 있습니다.

- 시스템을 등록했습니다.

절차

플레이북 파일을 만듭니다(예:

~/configure-repos.yml).리포지터리를 활성화하려면 다음을 수행합니다.

--- - name: Enable repository hosts: managed-node-01.example.com vars: rhc_repositories: - {name: "RepositoryName", state: enabled} roles: - role: rhel-system-roles.rhc리포지터리를 비활성화하려면 다음을 수행합니다.

--- - name: Disable repository hosts: managed-node-01.example.com vars: rhc_repositories: - {name: "RepositoryName", state: disabled} roles: - role: rhel-system-roles.rhc

플레이북을 실행합니다.

# ansible-playbook ~/configure-repos.yml

추가 리소스

-

/usr/share/ansible/roles/rhel-system-roles.rhc/README.md파일

7.6. rhc 시스템 역할을 사용하여 릴리스 버전 설정

최신 RHEL 대신 특정 마이너 RHEL 버전에 대해서만 리포지토리만 사용하도록 시스템을 제한할 수 있습니다. 이렇게 하면 특정 마이너 RHEL 버전에 시스템을 잠글 수 있습니다.

사전 요구 사항

- 제어 노드와 관리형 노드가 준비되었습니다.

- 관리 노드에서 플레이북을 실행할 수 있는 사용자로 제어 노드에 로그인되어 있습니다.

-

관리형 노드에 연결하는 데 사용하는 계정에는

sudo권한이 있습니다. - 이 플레이북을 실행하려는 관리형 노드 또는 관리형 노드 그룹은 Ansible 인벤토리 파일에 나열됩니다.

- 시스템을 잠글 마이너 RHEL 버전을 알고 있습니다. 호스트가 현재 실행 중인 RHEL 마이너 버전 또는 이후 마이너 버전에만 시스템을 잠글 수 있습니다.

- 시스템을 등록했습니다.

절차

플레이북 파일(예:

~/release.yml)을 생성합니다.--- - name: Set Release hosts: managed-node-01.example.com vars: rhc_release: "8.6" roles: - role: rhel-system-roles.rhc

플레이북을 실행합니다.

# ansible-playbook ~/release.yml

추가 리소스

-

/usr/share/ansible/roles/rhel-system-roles.rhc/README.md파일

7.7. rhc 시스템 역할을 사용하여 호스트를 등록할 때 프록시 서버 사용

보안 제한 사항이 프록시 서버를 통해서만 인터넷에 액세스할 수 있는 경우 rhc RHEL 시스템 역할을 사용하여 시스템을 등록할 때 플레이북에 프록시 설정을 지정할 수 있습니다.

사전 요구 사항

- 제어 노드와 관리형 노드가 준비되었습니다.

- 관리 노드에서 플레이북을 실행할 수 있는 사용자로 제어 노드에 로그인되어 있습니다.

-

관리형 노드에 연결하는 데 사용하는 계정에는

sudo권한이 있습니다. - 이 플레이북을 실행하려는 관리형 노드 또는 관리형 노드 그룹은 Ansible 인벤토리 파일에 나열됩니다.

절차

중요한 정보를 저장할 자격 증명 모음을 생성합니다.

$ ansible-vault create secrets.yml New Vault password: password Confirm New Vault password: password

ansible-vault create명령은 암호화된 파일을 생성하여 편집기에서 엽니다. 자격 증명 모음에 저장할 중요한 데이터를 입력합니다. 예를 들면 다음과 같습니다.username: username password: password proxy_username: proxyusernme proxy_password: proxypassword

변경 사항을 저장하고 편집기를 종료합니다. Ansible은 자격 증명 모음의 데이터를 암호화합니다.

나중에

ansible-vault edit secrets.yml명령을 사용하여 자격 증명 모음의 데이터를 편집할 수 있습니다.선택 사항: 자격 증명 모음 콘텐츠를 표시합니다.

$ ansible-vault view

secrets.yml플레이북 파일(예:

~/configure-proxy.yml)을 생성합니다.프록시를 사용하여 RHEL 고객 포털에 등록하려면 다음을 수행합니다.

--- - name: Register using proxy hosts: managed-node-01.example.com vars_files: - secrets.yml vars: rhc_auth: login: username: "{{ username }}" password: "{{ password }}" rhc_proxy: hostname: proxy.example.com port: 3128 username: "{{ proxy_username }}" password: "{{ proxy_password }}" roles: - role: rhel-system-roles.rhc

Red Hat Subscription Manager 서비스 구성에서 프록시 서버를 제거하려면 다음을 수행합니다.

--- - name: To stop using proxy server for registration hosts: managed-node-01.example.com vars_files: - secrets.yml vars: rhc_auth: login: username: "{{ username }}" password: "{{ password }}" rhc_proxy: {"state":"absent"} roles: - role: rhel-system-roles.rhc

플레이북을 실행합니다.

# ansible-playbook ~/configure-proxy.yml --ask-vault-pass

추가 리소스

-

/usr/share/ansible/roles/rhel-system-roles.rhc/README.md파일

7.8. rhc 시스템 역할을 사용하여 Insights 규칙의 자동 업데이트 비활성화

rhc RHEL 시스템 역할을 사용하여 Red Hat Insights의 자동 수집 규칙 업데이트를 비활성화할 수 있습니다. 기본적으로 시스템을 Red Hat Insights에 연결하면 이 옵션이 활성화됩니다. rhc RHEL 시스템 역할을 사용하여 비활성화할 수 있습니다.

이 기능을 비활성화하면 오래된 규칙 정의 파일을 사용할 위험이 있으며 최신 검증 업데이트가 제공되지 않습니다.

사전 요구 사항

- 제어 노드와 관리형 노드가 준비되었습니다.

- 관리 노드에서 플레이북을 실행할 수 있는 사용자로 제어 노드에 로그인되어 있습니다.

-

관리형 노드에 연결하는 데 사용하는 계정에는

sudo권한이 있습니다. - 이 플레이북을 실행하려는 관리형 노드 또는 관리형 노드 그룹은 Ansible 인벤토리 파일에 나열됩니다.

- 시스템을 등록했습니다.

절차

중요한 정보를 저장할 자격 증명 모음을 생성합니다.

$ ansible-vault create secrets.yml New Vault password: password Confirm New Vault password: password

ansible-vault create명령은 암호화된 파일을 생성하여 편집기에서 엽니다. 자격 증명 모음에 저장할 중요한 데이터를 입력합니다. 예를 들면 다음과 같습니다.username: username password: password

변경 사항을 저장하고 편집기를 종료합니다. Ansible은 자격 증명 모음의 데이터를 암호화합니다.

나중에

ansible-vault edit secrets.yml명령을 사용하여 자격 증명 모음의 데이터를 편집할 수 있습니다.선택 사항: 자격 증명 모음 콘텐츠를 표시합니다.

$ ansible-vault view

secrets.yml~/auto-update.yml과 같은 플레이북 파일을 생성하고 여기에 다음 내용을 추가합니다.--- - name: Disable Red Hat Insights autoupdates hosts: managed-node-01.example.com vars_files: - secrets.yml vars: rhc_auth: login: username: "{{ username }}" password: "{{ password }}" rhc_insights: autoupdate: false state: present roles: - role: rhel-system-roles.rhc

플레이북을 실행합니다.

# ansible-playbook ~/auto-update.yml --ask-vault-pass

추가 리소스

-

/usr/share/ansible/roles/rhel-system-roles.rhc/README.md파일

7.9. rhc RHEL 시스템 역할을 사용하여 Insights 수정 비활성화

rhc RHEL 시스템 역할을 사용하여 동적 구성을 자동으로 업데이트하도록 시스템을 구성할 수 있습니다. 시스템을 Red hat Insights에 연결하면 기본적으로 활성화됩니다. 필요하지 않은 경우 비활성화할 수 있습니다.

rhc 시스템 역할을 사용하여 수정을 활성화하면 Red Hat에 직접 연결할 때 시스템을 수정할 준비가 됩니다. Satellite 또는 Capsule에 연결된 시스템의 경우 업데이트 활성화를 다르게 수행해야 합니다. Red Hat Insights 수정에 대한 자세한 내용은 Red Hat Insights 수정 가이드를 참조하십시오.

사전 요구 사항

- 제어 노드와 관리형 노드가 준비되었습니다.

- 관리 노드에서 플레이북을 실행할 수 있는 사용자로 제어 노드에 로그인되어 있습니다.

-

관리형 노드에 연결하는 데 사용하는 계정에는

sudo권한이 있습니다. - 이 플레이북을 실행하려는 관리형 노드 또는 관리형 노드 그룹은 Ansible 인벤토리 파일에 나열됩니다.

- Insights 수정이 활성화되어 있습니다.

- 시스템을 등록했습니다.

절차

수정을 활성화하려면 플레이북 파일(예:

~/remediation.yml)을 생성합니다.--- - name: Disable remediation hosts: managed-node-01.example.com vars: rhc_insights: remediation: absent state: present roles: - role: rhel-system-roles.rhc

플레이북을 실행합니다.

# ansible-playbook ~/remediation.yml

추가 리소스

-

/usr/share/ansible/roles/rhel-system-roles.rhc/README.md파일

7.10. rhc 시스템 역할을 사용하여 Insights 태그 구성

시스템 필터링 및 그룹화에 태그를 사용할 수 있습니다. 요구 사항에 따라 태그를 사용자 지정할 수도 있습니다.

사전 요구 사항

- 제어 노드와 관리형 노드가 준비되었습니다.

- 관리 노드에서 플레이북을 실행할 수 있는 사용자로 제어 노드에 로그인되어 있습니다.

-

관리형 노드에 연결하는 데 사용하는 계정에는

sudo권한이 있습니다. - 이 플레이북을 실행하려는 관리형 노드 또는 관리형 노드 그룹은 Ansible 인벤토리 파일에 나열됩니다.

절차

중요한 정보를 저장할 자격 증명 모음을 생성합니다.

$ ansible-vault create secrets.yml New Vault password: password Confirm New Vault password: password

ansible-vault create명령은 암호화된 파일을 생성하여 편집기에서 엽니다. 자격 증명 모음에 저장할 중요한 데이터를 입력합니다. 예를 들면 다음과 같습니다.username: username password: password

변경 사항을 저장하고 편집기를 종료합니다. Ansible은 자격 증명 모음의 데이터를 암호화합니다.

나중에

ansible-vault edit secrets.yml명령을 사용하여 자격 증명 모음의 데이터를 편집할 수 있습니다.선택 사항: 자격 증명 모음 콘텐츠를 표시합니다.

$ ansible-vault view

secrets.yml플레이북 파일(예:

~/tags.yml)을 생성하고 여기에 다음 내용을 추가합니다.--- - name: Creating tags hosts: managed-node-01.example.com vars_files: - secrets.yml vars: rhc_auth: login: username: "{{ username }}" password: "{{ password }}" rhc_insights: tags: group: group-name-value location: location-name-value description: - RHEL8 - SAP sample_key:value state: present roles: - role: rhel-system-roles.rhc

플레이북을 실행합니다.

# ansible-playbook ~/remediation.yml --ask-vault-pass

추가 리소스

-

/usr/share/ansible/roles/rhel-system-roles.rhc/README.md파일 - 자세한 내용은 시스템 필터링 및 그룹 Red Hat Insights 를 참조하십시오.

7.11. RHC 시스템 역할을 사용하여 시스템 등록 취소

더 이상 서브스크립션 서비스가 필요하지 않은 경우 Red Hat에서 시스템 등록을 취소할 수 있습니다.

사전 요구 사항

- 제어 노드와 관리형 노드가 준비되었습니다.

- 관리 노드에서 플레이북을 실행할 수 있는 사용자로 제어 노드에 로그인되어 있습니다.

-

관리형 노드에 연결하는 데 사용하는 계정에는

sudo권한이 있습니다. - 이 플레이북을 실행하려는 관리형 노드 또는 관리형 노드 그룹은 Ansible 인벤토리 파일에 나열됩니다.

- 시스템이 이미 등록되어 있습니다.

절차

등록 취소하려면 플레이북 파일(예:

~/unregister.yml)을 생성하고 여기에 다음 내용을 추가합니다.--- - name: Unregister the system hosts: managed-node-01.example.com vars: rhc_state: absent roles: - role: rhel-system-roles.rhc플레이북을 실행합니다.

# ansible-playbook ~/unregister.yml

추가 리소스

-

/usr/share/ansible/roles/rhel-system-roles.rhc/README.md파일

8장. RHEL 시스템 역할을 사용하여 네트워크 설정 구성

관리자는 네트워크 RHEL 시스템 역할을 사용하여 네트워크 관련 구성 및 관리 작업을 자동화할 수 있습니다.

8.1. 인터페이스 이름이 있는 네트워크 RHEL System Role을 사용하여 고정 IP 주소로 이더넷 연결 구성

RHEL 시스템 역할을 사용하여 이더넷 연결을 원격으로 구성할 수 있습니다.

Ansible 제어 노드에서 다음 프로세스를 수행합니다.

사전 요구 사항

- 제어 노드와 관리형 노드가 준비되었습니다.

- 관리 노드에서 플레이북을 실행할 수 있는 사용자로 제어 노드에 로그인되어 있습니다.

-

관리형 노드에 연결하는 데 사용하는 계정에는

sudo권한이 있습니다. - 이 플레이북을 실행하려는 관리형 노드 또는 관리형 노드 그룹은 Ansible 인벤토리 파일에 나열됩니다.

- 서버 구성에 물리적 또는 가상 이더넷 장치가 있습니다.

- 관리 노드는 NetworkManager를 사용하여 네트워크를 구성합니다.

절차

다음과 같은 내용으로 플레이북 파일(예:

~/ethernet-static-IP.yml)을 생성합니다.--- - name: Configure the network hosts: managed-node-01.example.com tasks: - name: Configure an Ethernet connection with static IP include_role: name: rhel-system-roles.network vars: network_connections: - name: enp1s0 interface_name: enp1s0 type: ethernet autoconnect: yes ip: address: - 192.0.2.1/24 - 2001:db8:1::1/64 gateway4: 192.0.2.254 gateway6: 2001:db8:1::fffe dns: - 192.0.2.200 - 2001:db8:1::ffbb dns_search: - example.com state: up이러한 설정은 다음 설정을 사용하여

enp1s0장치에 대한 이더넷 연결 프로필을 정의합니다.-

정적 IPv4 주소 -

/24서브넷 마스크가 있는192.0.2.1 -

/64서브넷 마스크가 포함된 정적 IPv6 주소 -2001:db8:1::1 -

IPv4 기본 게이트웨이 -

192.0.2.254 -

IPv6 기본 게이트웨이 -

2001:db8:1::fffe -

IPv4 DNS 서버 -

192.0.2.200 -

IPv6 DNS 서버 -

2001:db8:1::ffbb -

DNS 검색 도메인 -

example.com

-

정적 IPv4 주소 -

플레이북 구문을 확인합니다.

# ansible-playbook ~/ethernet-static-IP.yml --syntax-check이 명령은 구문만 검증하고 잘못되었지만 유효한 구성으로부터 보호하지 않습니다.

플레이북을 실행합니다.

# ansible-playbook ~/ethernet-static-IP.yml

추가 리소스

-

/usr/share/ansible/roles/rhel-system-roles.network/README.mdfile

8.2. 장치 경로가 있는 네트워크 RHEL System Role을 사용하여 고정 IP 주소로 이더넷 연결 구성

RHEL 시스템 역할을 사용하여 이더넷 연결을 원격으로 구성할 수 있습니다.

다음 명령을 사용하여 장치 경로를 확인할 수 있습니다.

# udevadm info /sys/class/net/<device_name> | grep ID_PATH=Ansible 제어 노드에서 다음 프로세스를 수행합니다.

사전 요구 사항

- 제어 노드와 관리형 노드가 준비되었습니다.

- 관리 노드에서 플레이북을 실행할 수 있는 사용자로 제어 노드에 로그인되어 있습니다.

-

관리형 노드에 연결하는 데 사용하는 계정에는

sudo권한이 있습니다. - 이 플레이북을 실행하려는 관리형 노드 또는 관리형 노드 그룹은 Ansible 인벤토리 파일에 나열됩니다.

- 서버 구성에 물리적 또는 가상 이더넷 장치가 있습니다.

- 관리 노드는 NetworkManager를 사용하여 네트워크를 구성합니다.

절차

다음과 같은 내용으로 플레이북 파일(예:

~/ethernet-static-IP.yml)을 생성합니다.--- - name: Configure the network hosts: managed-node-01.example.com tasks: - name: Configure an Ethernet connection with static IP include_role: name: rhel-system-roles.network vars: network_connections: - name: example match: path: - pci-0000:00:0[1-3].0 - &!pci-0000:00:02.0 type: ethernet autoconnect: yes ip: address: - 192.0.2.1/24 - 2001:db8:1::1/64 gateway4: 192.0.2.254 gateway6: 2001:db8:1::fffe dns: - 192.0.2.200 - 2001:db8:1::ffbb dns_search: - example.com state: up

이러한 설정은 다음 설정을 사용하여 이더넷 연결 프로필을 정의합니다.

-

정적 IPv4 주소 -

/24서브넷 마스크가 있는192.0.2.1 -

/64서브넷 마스크가 포함된 정적 IPv6 주소 -2001:db8:1::1 -

IPv4 기본 게이트웨이 -

192.0.2.254 -

IPv6 기본 게이트웨이 -

2001:db8:1::fffe -

IPv4 DNS 서버 -

192.0.2.200 -

IPv6 DNS 서버 -

2001:db8:1::ffbb -

DNS 검색 도메인 -

example.com

이 예제의

match매개변수는 Ansible이 PCI ID0000:00:0[1-3].0과 일치하는 장치에 플레이를 적용하지만0000:00:02.0과 일치하도록 정의합니다. 사용할 수 있는 특수 수정자 및 와일드카드에 대한 자세한 내용은/usr/share/ansible/roles/rhel-system-roles.network/README.md파일에서match매개변수 설명을 참조하십시오.-

정적 IPv4 주소 -

플레이북 구문을 확인합니다.

# ansible-playbook ~/ethernet-static-IP.yml --syntax-check이 명령은 구문만 검증하고 잘못되었지만 유효한 구성으로부터 보호하지 않습니다.

플레이북을 실행합니다.

# ansible-playbook ~/ethernet-static-IP.yml

추가 리소스

-

/usr/share/ansible/roles/rhel-system-roles.network/README.mdfile

8.3. 인터페이스 이름과 네트워크 RHEL 시스템 역할을 사용하여 동적 IP 주소로 이더넷 연결 구성

RHEL 시스템 역할을 사용하여 이더넷 연결을 원격으로 구성할 수 있습니다. 동적 IP 주소 설정으로 연결을 위해 NetworkManager는 DHCP 서버에서 연결에 대한 IP 설정을 요청합니다.

Ansible 제어 노드에서 다음 프로세스를 수행합니다.

사전 요구 사항

- 제어 노드와 관리형 노드가 준비되었습니다.

- 관리 노드에서 플레이북을 실행할 수 있는 사용자로 제어 노드에 로그인되어 있습니다.

-

관리형 노드에 연결하는 데 사용하는 계정에는

sudo권한이 있습니다. - 이 플레이북을 실행하려는 관리형 노드 또는 관리형 노드 그룹은 Ansible 인벤토리 파일에 나열됩니다.

- 서버 구성에 물리적 또는 가상 이더넷 장치가 있습니다.

- 네트워크에서 DHCP 서버를 사용할 수 있습니다.

- 관리 노드는 NetworkManager를 사용하여 네트워크를 구성합니다.

절차

다음과 같은 콘텐츠를 사용하여 플레이북 파일(예:

~/ethernet-dynamic-IP.yml)을 생성합니다.--- - name: Configure the network hosts: managed-node-01.example.com tasks: - name: Configure an Ethernet connection with dynamic IP include_role: name: rhel-system-roles.network vars: network_connections: - name: enp1s0 interface_name: enp1s0 type: ethernet autoconnect: yes ip: dhcp4: yes auto6: yes state: up이러한 설정은

enp1s0장치에 대한 이더넷 연결 프로필을 정의합니다. 연결은 DHCP 서버와 IPv6 상태 비저장 주소 자동 구성(SLAAC)에서 IPv4 주소, IPv6 주소, 기본 게이트웨이, 경로, DNS 서버 및 검색 도메인을 검색합니다.플레이북 구문을 확인합니다.

# ansible-playbook ~/ethernet-dynamic-IP.yml --syntax-check이 명령은 구문만 검증하고 잘못되었지만 유효한 구성으로부터 보호하지 않습니다.

플레이북을 실행합니다.

# ansible-playbook ~/ethernet-dynamic-IP.yml

추가 리소스

-

/usr/share/ansible/roles/rhel-system-roles.network/README.mdfile

8.4. 장치 경로가 있는 네트워크 RHEL System Role을 사용하여 동적 IP 주소로 이더넷 연결 구성

RHEL 시스템 역할을 사용하여 이더넷 연결을 원격으로 구성할 수 있습니다. 동적 IP 주소 설정으로 연결을 위해 NetworkManager는 DHCP 서버에서 연결에 대한 IP 설정을 요청합니다.

다음 명령을 사용하여 장치 경로를 확인할 수 있습니다.

# udevadm info /sys/class/net/<device_name> | grep ID_PATH=Ansible 제어 노드에서 다음 프로세스를 수행합니다.

사전 요구 사항

- 제어 노드와 관리형 노드가 준비되었습니다.

- 관리 노드에서 플레이북을 실행할 수 있는 사용자로 제어 노드에 로그인되어 있습니다.

-

관리형 노드에 연결하는 데 사용하는 계정에는

sudo권한이 있습니다. - 이 플레이북을 실행하려는 관리형 노드 또는 관리형 노드 그룹은 Ansible 인벤토리 파일에 나열됩니다.

- 서버 구성에 물리적 또는 가상 이더넷 장치가 있습니다.

- DHCP 서버는 네트워크에서 사용할 수 있습니다.

- 관리 호스트는 NetworkManager를 사용하여 네트워크를 구성합니다.

절차

다음과 같은 콘텐츠를 사용하여 플레이북 파일(예:

~/ethernet-dynamic-IP.yml)을 생성합니다.--- - name: Configure the network hosts: managed-node-01.example.com tasks: - name: Configure an Ethernet connection with dynamic IP include_role: name: rhel-system-roles.network vars: network_connections: - name: example match: path: - pci-0000:00:0[1-3].0 - &!pci-0000:00:02.0 type: ethernet autoconnect: yes ip: dhcp4: yes auto6: yes state: up이러한 설정은 이더넷 연결 프로필을 정의합니다. 연결은 DHCP 서버와 IPv6 상태 비저장 주소 자동 구성(SLAAC)에서 IPv4 주소, IPv6 주소, 기본 게이트웨이, 경로, DNS 서버 및 검색 도메인을 검색합니다.

이 예제의

match매개변수는 Ansible이 PCI ID0000:00:0[1-3].0과 일치하는 장치에 플레이를 적용하지만0000:00:02.0과 일치하도록 정의합니다. 사용할 수 있는 특수 수정자 및 와일드카드에 대한 자세한 내용은/usr/share/ansible/roles/rhel-system-roles.network/README.md파일에서match매개변수 설명을 참조하십시오.플레이북 구문을 확인합니다.

# ansible-playbook ~/ethernet-dynamic-IP.yml --syntax-check이 명령은 구문만 검증하고 잘못되었지만 유효한 구성으로부터 보호하지 않습니다.

플레이북을 실행합니다.

# ansible-playbook ~/ethernet-dynamic-IP.yml

추가 리소스

-

/usr/share/ansible/roles/rhel-system-roles.network/README.mdfile

8.5. 네트워크 RHEL 시스템 역할을 사용하여 VLAN 태그 지정 설정

네트워크 RHEL 시스템 역할을 사용하여 VLAN 태그를 구성할 수 있습니다. 이 예제에서는 이 이더넷 연결 상단에 ID 10 이 포함된 이더넷 연결과 VLAN을 추가합니다. 하위 장치로 VLAN 연결에는 IP, 기본 게이트웨이 및 DNS 구성이 포함됩니다.

환경에 따라 적절하게 재생을 조정합니다. 예를 들면 다음과 같습니다.

-

VLAN을 본딩과 같은 다른 연결의 포트로 사용하려면

ip속성을 생략하고 하위 구성에서 IP 구성을 설정합니다. -

VLAN에서 팀, 브리지 또는 본딩 장치를 사용하려면 VLAN에서 사용하는 포트의

interface_name및type속성을 조정합니다.

Ansible 제어 노드에서 다음 프로세스를 수행합니다.

사전 요구 사항

- 제어 노드와 관리형 노드가 준비되었습니다.

- 관리 노드에서 플레이북을 실행할 수 있는 사용자로 제어 노드에 로그인되어 있습니다.

-

관리형 노드에 연결하는 데 사용하는 계정에는

sudo권한이 있습니다. - 이 플레이북을 실행하려는 관리형 노드 또는 관리형 노드 그룹은 Ansible 인벤토리 파일에 나열됩니다.

절차

다음과 같은 콘텐츠로 플레이북 파일(예:

~/vlan-ethernet.yml)을 생성합니다.--- - name: Configure the network hosts: managed-node-01.example.com tasks: - name: Configure a VLAN that uses an Ethernet connection include_role: name: rhel-system-roles.network vars: network_connections: # Add an Ethernet profile for the underlying device of the VLAN - name: enp1s0 type: ethernet interface_name: enp1s0 autoconnect: yes state: up ip: dhcp4: no auto6: no # Define the VLAN profile - name: enp1s0.10 type: vlan ip: address: - "192.0.2.1/24" - "2001:db8:1::1/64" gateway4: 192.0.2.254 gateway6: 2001:db8:1::fffe dns: - 192.0.2.200 - 2001:db8:1::ffbb dns_search: - example.com vlan_id: 10 parent: enp1s0 state: up이러한 설정은

enp1s0장치 상단에서 작동할 VLAN을 정의합니다. VLAN 인터페이스에는 다음과 같은 설정이 있습니다.-

정적 IPv4 주소 -

/24서브넷 마스크가 있는192.0.2.1 -

/64서브넷 마스크가 포함된 정적 IPv6 주소 -2001:db8:1::1 -

IPv4 기본 게이트웨이 -

192.0.2.254 -

IPv6 기본 게이트웨이 -

2001:db8:1::fffe -

IPv4 DNS 서버 -

192.0.2.200 -

IPv6 DNS 서버 -

2001:db8:1::ffbb -

DNS 검색 도메인 -

example.com -

VLAN ID -

10

VLAN 프로필의

parent속성은enp1s0장치 위에서 작동하도록 VLAN을 구성합니다. 하위 장치로 VLAN 연결에는 IP, 기본 게이트웨이 및 DNS 구성이 포함됩니다.-

정적 IPv4 주소 -

플레이북 구문을 확인합니다.

# ansible-playbook ~/vlan-ethernet.yml --syntax-check이 명령은 구문만 검증하고 잘못되었지만 유효한 구성으로부터 보호하지 않습니다.

플레이북을 실행합니다.

# ansible-playbook ~/vlan-ethernet.yml

추가 리소스

-

/usr/share/ansible/roles/rhel-system-roles.network/README.mdfile

8.6. 네트워크 RHEL 시스템 역할을 사용하여 네트워크 브리지 구성

RHEL 시스템 역할을 사용하여 네트워크 브릿지를 원격으로 구성할 수 있습니다.

Ansible 제어 노드에서 다음 프로세스를 수행합니다.

사전 요구 사항

- 제어 노드와 관리형 노드가 준비되었습니다.

- 관리 노드에서 플레이북을 실행할 수 있는 사용자로 제어 노드에 로그인되어 있습니다.

-

관리형 노드에 연결하는 데 사용하는 계정에는

sudo권한이 있습니다. - 이 플레이북을 실행하려는 관리형 노드 또는 관리형 노드 그룹은 Ansible 인벤토리 파일에 나열됩니다.

- 두 개 이상의 물리적 또는 가상 네트워크 장치가 서버에 설치되어 있습니다.

절차

다음과 같은 내용으로 플레이북 파일(예:

~/bridge-ethernet.yml)을 생성합니다.--- - name: Configure the network hosts: managed-node-01.example.com tasks: - name: Configure a network bridge that uses two Ethernet ports include_role: name: rhel-system-roles.network vars: network_connections: # Define the bridge profile - name: bridge0 type: bridge interface_name: bridge0 ip: address: - "192.0.2.1/24" - "2001:db8:1::1/64" gateway4: 192.0.2.254 gateway6: 2001:db8:1::fffe dns: - 192.0.2.200 - 2001:db8:1::ffbb dns_search: - example.com state: up # Add an Ethernet profile to the bridge - name: bridge0-port1 interface_name: enp7s0 type: ethernet controller: bridge0 port_type: bridge state: up # Add a second Ethernet profile to the bridge - name: bridge0-port2 interface_name: enp8s0 type: ethernet controller: bridge0 port_type: bridge state: up이러한 설정은 다음 설정을 사용하여 네트워크 브리지를 정의합니다.

-

정적 IPv4 주소 -

/24서브넷 마스크가 있는192.0.2.1 -

/64서브넷 마스크가 포함된 정적 IPv6 주소 -2001:db8:1::1 -

IPv4 기본 게이트웨이 -

192.0.2.254 -

IPv6 기본 게이트웨이 -

2001:db8:1::fffe -

IPv4 DNS 서버 -

192.0.2.200 -

IPv6 DNS 서버 -

2001:db8:1::ffbb -

DNS 검색 도메인 -

example.com 브리지 포트 -

enp7s0및enp8s0참고브리지에서 IP 구성을 설정하고 Linux 브리지 포트에는 설정하지 않습니다.

-

정적 IPv4 주소 -

플레이북 구문을 확인합니다.

# ansible-playbook ~/bridge-ethernet.yml --syntax-check이 명령은 구문만 검증하고 잘못되었지만 유효한 구성으로부터 보호하지 않습니다.

플레이북을 실행합니다.

# ansible-playbook ~/bridge-ethernet.yml

추가 리소스

-

/usr/share/ansible/roles/rhel-system-roles.network/README.mdfile

8.7. 네트워크 RHEL 시스템 역할을 사용하여 네트워크 본딩 구성

RHEL 시스템 역할을 사용하여 네트워크 본딩을 원격으로 구성할 수 있습니다.

Ansible 제어 노드에서 다음 프로세스를 수행합니다.

사전 요구 사항

- 제어 노드와 관리형 노드가 준비되었습니다.

- 관리 노드에서 플레이북을 실행할 수 있는 사용자로 제어 노드에 로그인되어 있습니다.

-

관리형 노드에 연결하는 데 사용하는 계정에는

sudo권한이 있습니다. - 이 플레이북을 실행하려는 관리형 노드 또는 관리형 노드 그룹은 Ansible 인벤토리 파일에 나열됩니다.

- 두 개 이상의 물리적 또는 가상 네트워크 장치가 서버에 설치되어 있습니다.

절차

다음과 같은 콘텐츠로 플레이북 파일(예:

~/bond-ethernet.yml)을 생성합니다.--- - name: Configure the network hosts: managed-node-01.example.com tasks: - name: Configure a network bond that uses two Ethernet ports include_role: name: rhel-system-roles.network vars: network_connections: # Define the bond profile - name: bond0 type: bond interface_name: bond0 ip: address: - "192.0.2.1/24" - "2001:db8:1::1/64" gateway4: 192.0.2.254 gateway6: 2001:db8:1::fffe dns: - 192.0.2.200 - 2001:db8:1::ffbb dns_search: - example.com bond: mode: active-backup state: up # Add an Ethernet profile to the bond - name: bond0-port1 interface_name: enp7s0 type: ethernet controller: bond0 state: up # Add a second Ethernet profile to the bond - name: bond0-port2 interface_name: enp8s0 type: ethernet controller: bond0 state: up이러한 설정은 다음 설정으로 네트워크 본딩을 정의합니다.

-

정적 IPv4 주소 -

/24서브넷 마스크가 있는192.0.2.1 -

/64서브넷 마스크가 포함된 정적 IPv6 주소 -2001:db8:1::1 -

IPv4 기본 게이트웨이 -

192.0.2.254 -

IPv6 기본 게이트웨이 -

2001:db8:1::fffe -

IPv4 DNS 서버 -

192.0.2.200 -

IPv6 DNS 서버 -

2001:db8:1::ffbb -

DNS 검색 도메인 -

example.com -

본딩 포트 -

enp7s0및enp8s0 본딩 모드 -

active-backup참고본딩에 IP 구성을 설정하고 Linux 본딩 포트에는 설정하지 않습니다.

-

정적 IPv4 주소 -

플레이북 구문을 확인합니다.

# ansible-playbook ~/bond-ethernet.yml --syntax-check이 명령은 구문만 검증하고 잘못되었지만 유효한 구성으로부터 보호하지 않습니다.

플레이북을 실행합니다.

# ansible-playbook ~/bond-ethernet.yml

추가 리소스

-

/usr/share/ansible/roles/rhel-system-roles.network/README.mdfile

8.8. 네트워크 RHEL 시스템 역할을 사용하여 IPoIB 연결 구성

네트워크 RHEL 시스템 역할을 사용하여 IP over InfiniBand(IPoIB) 장치에 대한 NetworkManager 연결 프로필을 원격으로 생성할 수 있습니다. 예를 들어 Ansible 플레이북을 실행하여 다음 설정을 사용하여 mlx4_ib0 인터페이스에 대한 InfiniBand 연결을 원격으로 추가합니다.

-

IPoIB 장치 -

mlx4_ib0.8002 -

파티션 키

p_key-0x8002 -

정적

IPv4주소 -/24서브넷 마스크가 있는192.0.2.1 -

/64서브넷 마스크가 포함된 정적IPv6주소 -2001:db8:1::1

Ansible 제어 노드에서 다음 프로세스를 수행합니다.

사전 요구 사항

- 제어 노드와 관리형 노드가 준비되었습니다.

- 관리 노드에서 플레이북을 실행할 수 있는 사용자로 제어 노드에 로그인했습니다.

-

관리형 노드에 연결하는 데 사용하는 계정에는

sudo권한이 있습니다. - 이 플레이북을 실행하려는 관리형 노드 또는 관리형 노드 그룹은 Ansible 인벤토리 파일에 나열됩니다.

-

mlx4_ib0이라는 InfiniBand 장치가 관리 노드에 설치됩니다. - 관리 노드는 NetworkManager를 사용하여 네트워크를 구성합니다.

절차

다음과 같은 내용과 함께 플레이북 파일(예:

~/IPoIB.yml)을 생성합니다.--- - name: Configure the network hosts: managed-node-01.example.com tasks: - name: Configure IPoIB include_role: name: rhel-system-roles.network vars: network_connections: # InfiniBand connection mlx4_ib0 - name: mlx4_ib0 interface_name: mlx4_ib0 type: infiniband # IPoIB device mlx4_ib0.8002 on top of mlx4_ib0 - name: mlx4_ib0.8002 type: infiniband autoconnect: yes infiniband: p_key: 0x8002 transport_mode: datagram parent: mlx4_ib0 ip: address: - 192.0.2.1/24 - 2001:db8:1::1/64 state: up이 예제와 같이

p_key매개변수를 설정하는 경우 IPoIB 장치에interface_name매개변수를 설정하지 마십시오.플레이북 구문을 확인합니다.

# ansible-playbook ~/IPoIB.yml --syntax-check이 명령은 구문만 검증하고 잘못되었지만 유효한 구성으로부터 보호하지 않습니다.

플레이북을 실행합니다.

# ansible-playbook ~/IPoIB.yml

검증

managed-node-01.example.com호스트에서mlx4_ib0.8002장치의 IP 설정을 표시합니다.# ip address show mlx4_ib0.8002 ... inet 192.0.2.1/24 brd 192.0.2.255 scope global noprefixroute ib0.8002 valid_lft forever preferred_lft forever inet6 2001:db8:1::1/64 scope link tentative noprefixroute valid_lft forever preferred_lft forever

mlx4_ib0.8002장치의 파티션 키(P_Key)를 표시합니다.# cat /sys/class/net/mlx4_ib0.8002/pkey 0x8002mlx4_ib0.8002장치의 모드를 표시합니다.# cat /sys/class/net/mlx4_ib0.8002/mode datagram

추가 리소스

-

/usr/share/ansible/roles/rhel-system-roles.network/README.mdfile

8.9. 네트워크 RHEL 시스템 역할을 사용하여 특정 서브넷에서 다른 기본 게이트웨이로 트래픽을 라우팅

정책 기반 라우팅을 사용하여 특정 서브넷의 트래픽에 대해 다른 기본 게이트웨이를 구성할 수 있습니다. 예를 들어 기본적으로 기본 경로를 사용하여 모든 트래픽을 인터넷 공급자 A로 라우팅하는 라우터로 RHEL을 구성할 수 있습니다. 그러나 내부 워크스테이션 서브넷에서 수신된 트래픽은 공급자 B로 라우팅됩니다.

RHEL 네트워크 시스템 역할을 사용하여 원격으로 및 여러 노드에 정책 기반 라우팅을 구성할 수 있습니다. Ansible 제어 노드에서 다음 프로세스를 수행합니다.

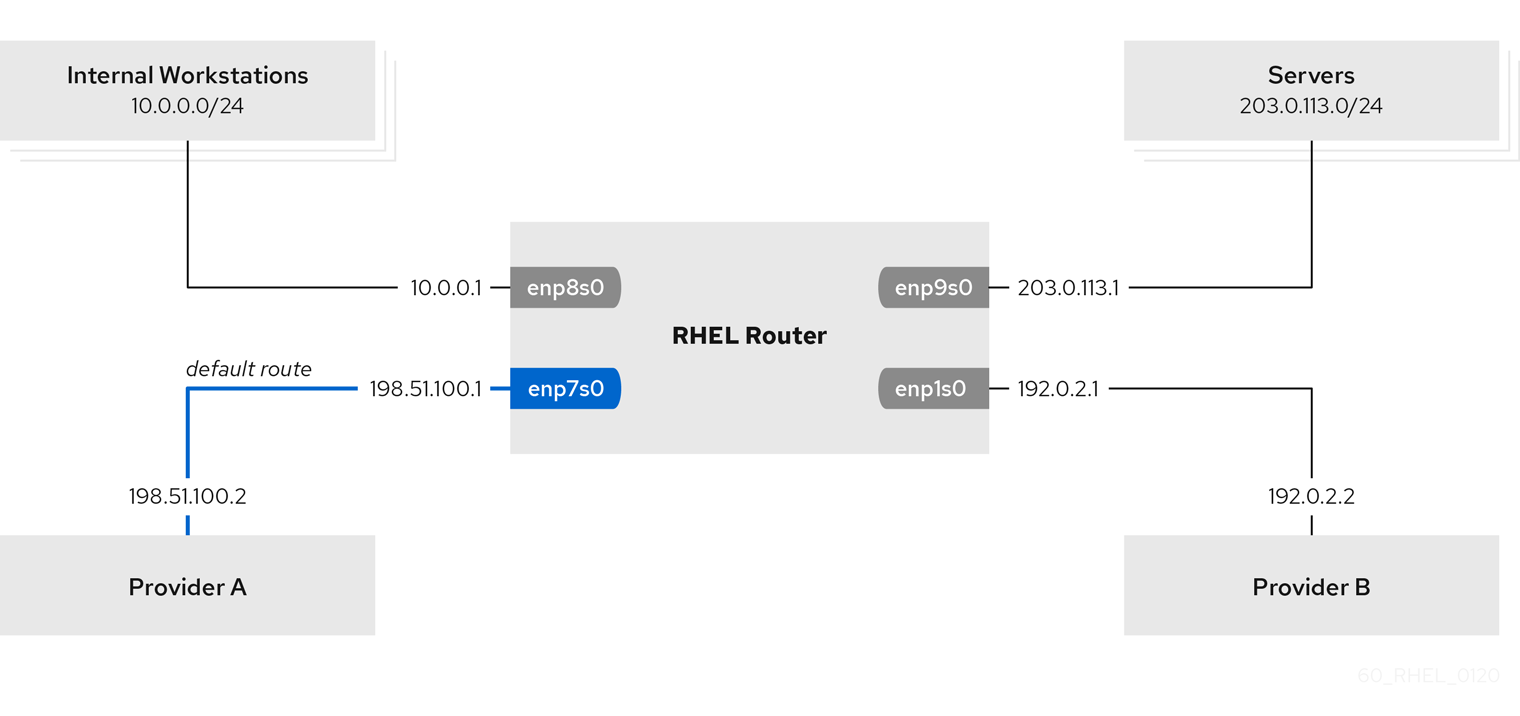

이 절차에서는 다음과 같은 네트워크 토폴로지를 가정합니다.

사전 요구 사항

- 제어 노드와 관리형 노드가 준비되었습니다.

- 관리 노드에서 플레이북을 실행할 수 있는 사용자로 제어 노드에 로그인되어 있습니다.

-

관리형 노드에 연결하는 데 사용하는 계정에는 해당 노드에 대한

sudo권한이 있습니다. - 이 플레이북을 실행하려는 관리형 노드 또는 관리형 노드 그룹은 Ansible 인벤토리 파일에 나열됩니다.

-

관리 노드는

NetworkManager및firewalld서비스를 사용합니다. 구성하려는 관리형 노드에는 네 가지 네트워크 인터페이스가 있습니다.

-

enp7s0인터페이스는 공급자 A의 네트워크에 연결되어 있습니다. 공급자 네트워크의 게이트웨이 IP는198.51.100.2입니다. 네트워크에서/30네트워크 마스크를 사용합니다. -

enp1s0인터페이스는 공급자 B의 네트워크에 연결되어 있습니다. 공급자 네트워크의 게이트웨이 IP는192.0.2.2이며 네트워크는/30네트워크 마스크를 사용합니다. -

enp8s0인터페이스는 내부 워크스테이션이 있는10.0.0.0/24서브넷에 연결되어 있습니다. -

enp9s0인터페이스는 회사의 서버가 있는203.0.113.0/24서브넷에 연결되어 있습니다.

-

-

내부 워크스테이션 서브넷의 호스트는 기본 게이트웨이로

10.0.0.1을 사용합니다. 이 절차에서는 이 IP 주소를 라우터의enp8s0네트워크 인터페이스에 할당합니다. -

서버 서브넷의 호스트는

203.0.113.1을 기본 게이트웨이로 사용합니다. 이 절차에서는 이 IP 주소를 라우터의enp9s0네트워크 인터페이스에 할당합니다.

절차

다음과 같은 내용으로 플레이북 파일(예:

~/pbr.yml)을 생성합니다.--- - name: Configuring policy-based routing hosts: managed-node-01.example.com tasks: - name: Routing traffic from a specific subnet to a different default gateway include_role: name: rhel-system-roles.network vars: network_connections: - name: Provider-A interface_name: enp7s0 type: ethernet autoconnect: True ip: address: - 198.51.100.1/30 gateway4: 198.51.100.2 dns: - 198.51.100.200 state: up zone: external - name: Provider-B interface_name: enp1s0 type: ethernet autoconnect: True ip: address: - 192.0.2.1/30 route: - network: 0.0.0.0 prefix: 0 gateway: 192.0.2.2 table: 5000 state: up zone: external - name: Internal-Workstations interface_name: enp8s0 type: ethernet autoconnect: True ip: address: - 10.0.0.1/24 route: - network: 10.0.0.0 prefix: 24 table: 5000 routing_rule: - priority: 5 from: 10.0.0.0/24 table: 5000 state: up zone: trusted - name: Servers interface_name: enp9s0 type: ethernet autoconnect: True ip: address: - 203.0.113.1/24 state: up zone: trusted플레이북 구문을 확인합니다.

# ansible-playbook ~/pbr.yml --syntax-check이 명령은 구문만 검증하고 잘못되었지만 유효한 구성으로부터 보호하지 않습니다.

플레이북을 실행합니다.

# ansible-playbook ~/pbr.yml

검증

내부 워크스테이션 서브넷의 RHEL 호스트에서 다음을 수행합니다.

traceroute패키지를 설치합니다.# dnf install traceroutetraceroute유틸리티를 사용하여 인터넷의 호스트에 대한 경로를 표시합니다.# traceroute redhat.com traceroute to redhat.com (209.132.183.105), 30 hops max, 60 byte packets 1 10.0.0.1 (10.0.0.1) 0.337 ms 0.260 ms 0.223 ms 2 192.0.2.1 (192.0.2.1) 0.884 ms 1.066 ms 1.248 ms ...명령 출력은 라우터가 공급자 B의 네트워크인

192.0.2.1을 통해 패킷을 전송함을 표시합니다.

서버 서브넷의 RHEL 호스트에서 다음을 수행합니다.

traceroute패키지를 설치합니다.# dnf install traceroutetraceroute유틸리티를 사용하여 인터넷의 호스트에 대한 경로를 표시합니다.# traceroute redhat.com traceroute to redhat.com (209.132.183.105), 30 hops max, 60 byte packets 1 203.0.113.1 (203.0.113.1) 2.179 ms 2.073 ms 1.944 ms 2 198.51.100.2 (198.51.100.2) 1.868 ms 1.798 ms 1.549 ms ...명령 출력은 라우터가 공급자 A의 네트워크인

198.51.100.2를 통해 패킷을 전송함을 표시합니다.

RHEL 시스템 역할을 사용하여 구성한 RHEL 라우터에서 다음을 수행합니다.

규칙 목록을 표시합니다.

# ip rule list 0: from all lookup local 5: from 10.0.0.0/24 lookup 5000 32766: from all lookup main 32767: from all lookup default

기본적으로 RHEL에는

로컬테이블, 기본 및기본값에 대한 규칙이 포함되어 있습니다.다음 표

5000에 경로를 표시합니다.# ip route list table 5000 0.0.0.0/0 via 192.0.2.2 dev enp1s0 proto static metric 100 10.0.0.0/24 dev enp8s0 proto static scope link src 192.0.2.1 metric 102인터페이스 및 방화벽 영역을 표시합니다.

# firewall-cmd --get-active-zones external interfaces: enp1s0 enp7s0 trusted interfaces: enp8s0 enp9s0외부영역에 masquerading이 활성화되었는지 확인합니다.# firewall-cmd --info-zone=external external (active) target: default icmp-block-inversion: no interfaces: enp1s0 enp7s0 sources: services: ssh ports: protocols: masquerade: yes ...

추가 리소스

-

/usr/share/ansible/roles/rhel-system-roles.network/README.mdfile

8.10. 네트워크 RHEL 시스템 역할을 사용하여 802.1X 네트워크 인증을 사용하여 정적 이더넷 연결 구성

RHEL 시스템 역할을 사용하여 802.1X 네트워크 인증을 사용하여 이더넷 연결을 원격으로 구성할 수 있습니다.

Ansible 제어 노드에서 다음 프로세스를 수행합니다.

사전 요구 사항

- 제어 노드와 관리형 노드가 준비되었습니다.

- 관리 노드에서 플레이북을 실행할 수 있는 사용자로 제어 노드에 로그인되어 있습니다.

-

관리형 노드에 연결하는 데 사용하는 계정에는

sudo권한이 있습니다. - 이 플레이북을 실행하려는 관리형 노드 또는 관리형 노드 그룹이 Ansible 인벤토리 파일에 나열됩니다.

- 네트워크는 802.1X 네트워크 인증을 지원합니다.

- 관리 노드는 NetworkManager를 사용합니다.

TLS 인증에 필요한 파일은 제어 노드에 있습니다.

-

클라이언트 키는

/srv/data/client.key파일에 저장됩니다. -

클라이언트 인증서는

/srv/data/client.crt파일에 저장됩니다. -

CA(인증 기관) 인증서는

/srv/data/ca.crt파일에 저장됩니다.

-

클라이언트 키는

절차

다음과 같은 내용과 함께 플레이북 파일(예:

~/enable-802.1x.yml)을 생성합니다.--- - name: Configure an Ethernet connection with 802.1X authentication hosts: managed-node-01.example.com tasks: - name: Copy client key for 802.1X authentication copy: src: "/srv/data/client.key" dest: "/etc/pki/tls/private/client.key" mode: 0600 - name: Copy client certificate for 802.1X authentication copy: src: "/srv/data/client.crt" dest: "/etc/pki/tls/certs/client.crt" - name: Copy CA certificate for 802.1X authentication copy: src: "/srv/data/ca.crt" dest: "/etc/pki/ca-trust/source/anchors/ca.crt" - include_role: name: rhel-system-roles.network vars: network_connections: - name: enp1s0 type: ethernet autoconnect: yes ip: address: - 192.0.2.1/24 - 2001:db8:1::1/64 gateway4: 192.0.2.254 gateway6: 2001:db8:1::fffe dns: - 192.0.2.200 - 2001:db8:1::ffbb dns_search: - example.com ieee802_1x: identity: user_name eap: tls private_key: "/etc/pki/tls/private/client.key" private_key_password: "password" client_cert: "/etc/pki/tls/certs/client.crt" ca_cert: "/etc/pki/ca-trust/source/anchors/ca.crt" domain_suffix_match: example.com state: up

이러한 설정은 다음 설정을 사용하여

enp1s0장치에 대한 이더넷 연결 프로필을 정의합니다.-

정적 IPv4 주소 -

/24서브넷 마스크가 있는192.0.2.1 -

/64서브넷 마스크가 포함된 정적 IPv6 주소 -2001:db8:1::1 -

IPv4 기본 게이트웨이 -

192.0.2.254 -

IPv6 기본 게이트웨이 -

2001:db8:1::fffe -

IPv4 DNS 서버 -

192.0.2.200 -

IPv6 DNS 서버 -

2001:db8:1::ffbb -

DNS 검색 도메인 -

example.com -

TLSEAP(Extensible Authentication Protocol)를 사용한 802.1x 네트워크 인증

-

정적 IPv4 주소 -

플레이북 구문을 확인합니다.

# ansible-playbook ~/enable-802.1x.yml --syntax-check이 명령은 구문만 검증하고 잘못되었지만 유효한 구성으로부터 보호하지 않습니다.

플레이북을 실행합니다.

# ansible-playbook ~/enable-802.1x.yml

추가 리소스

-

/usr/share/ansible/roles/rhel-system-roles.network/README.mdfile

8.11. 네트워크 RHEL 시스템 역할을 사용하여 802.1X 네트워크 인증을 사용하여 10.0.0.1 연결 구성

RHEL 시스템 역할을 사용하면 skopeo 연결 생성을 자동화할 수 있습니다. 예를 들어 Ansible 플레이북을 사용하여 wlp1s0 인터페이스에 대한 무선 연결 프로필을 원격으로 추가할 수 있습니다. 생성된 프로필은 802.1X 표준을 사용하여 client를 10.0.0.1 네트워크로 인증합니다. Playbook은 DHCP를 사용하도록 연결 프로필을 구성합니다. 고정 IP 설정을 구성하려면 그에 따라 ip 사전의 매개변수를 조정합니다.

Ansible 제어 노드에서 다음 프로세스를 수행합니다.

사전 요구 사항

- 제어 노드와 관리형 노드가 준비되었습니다.

- 관리 노드에서 플레이북을 실행할 수 있는 사용자로 제어 노드에 로그인되어 있습니다.

-

관리형 노드에 연결하는 데 사용하는 계정에는

sudo권한이 있습니다. - 이 플레이북을 실행하려는 관리형 노드 또는 관리형 노드 그룹은 Ansible 인벤토리 파일에 나열됩니다.

- 네트워크는 802.1X 네트워크 인증을 지원합니다.

-

관리 노드에

wpa_supplicant패키지를 설치했습니다. - DHCP는 관리 노드의 네트워크에서 사용할 수 있습니다.

TLS 인증에 필요한 파일은 제어 노드에 있습니다.

-

클라이언트 키는

/srv/data/client.key파일에 저장됩니다. -

클라이언트 인증서는

/srv/data/client.crt파일에 저장됩니다. -

CA 인증서는

/srv/data/ca.crt파일에 저장됩니다.

-

클라이언트 키는

절차

다음과 같은 내용과 함께 플레이북 파일(예:

~/enable-802.1x.yml)을 생성합니다.--- - name: Configure a wifi connection with 802.1X authentication hosts: managed-node-01.example.com tasks: - name: Copy client key for 802.1X authentication copy: src: "/srv/data/client.key" dest: "/etc/pki/tls/private/client.key" mode: 0400 - name: Copy client certificate for 802.1X authentication copy: src: "/srv/data/client.crt" dest: "/etc/pki/tls/certs/client.crt" - name: Copy CA certificate for 802.1X authentication copy: src: "/srv/data/ca.crt" dest: "/etc/pki/ca-trust/source/anchors/ca.crt" - block: - import_role: name: linux-system-roles.network vars: network_connections: - name: Configure the Example-wifi profile interface_name: wlp1s0 state: up type: wireless autoconnect: yes ip: dhcp4: true auto6: true wireless: ssid: "Example-wifi" key_mgmt: "wpa-eap" ieee802_1x: identity: "user_name" eap: tls private_key: "/etc/pki/tls/client.key" private_key_password: "password" private_key_password_flags: none client_cert: "/etc/pki/tls/client.pem" ca_cert: "/etc/pki/tls/cacert.pem" domain_suffix_match: "example.com"

이러한 설정은

wlp1s0인터페이스에 대한 Cryostat 연결 프로필을 정의합니다. 프로필은 802.1X 표준을 사용하여 internet network에 대한 클라이언트를 인증합니다. 연결은 DHCP 서버와 IPv6 상태 비저장 주소 자동 구성(SLAAC)에서 IPv4 주소, IPv6 주소, 기본 게이트웨이, 경로, DNS 서버 및 검색 도메인을 검색합니다.플레이북 구문을 확인합니다.

# ansible-playbook ~/enable-802.1x.yml --syntax-check이 명령은 구문만 검증하고 잘못되었지만 유효한 구성으로부터 보호하지 않습니다.

플레이북을 실행합니다.

# ansible-playbook ~/enable-802.1x.yml

추가 리소스

-

/usr/share/ansible/roles/rhel-system-roles.network/README.mdfile

8.12. 네트워크 RHEL 시스템 역할을 사용하여 기존 연결에서 기본 게이트웨이 설정

네트워크 RHEL 시스템 역할을 사용하여 기본 게이트웨이를 설정할 수 있습니다.

네트워크 RHEL 시스템 역할을 사용하는 플레이를 실행하고 설정 값이 플레이에 지정된 값과 일치하지 않으면 역할은 동일한 이름의 기존 연결 프로필을 재정의합니다. 이러한 값을 기본값으로 재설정하지 않으려면 구성이 이미 존재하는 경우에도 플레이에서 네트워크 연결 프로필의 전체 구성을 항상 지정합니다.

이미 존재하는지 여부에 따라 절차에서는 다음 설정으로 enp1s0 연결 프로필을 생성하거나 업데이트합니다.

-

정적 IPv4 주소 -

198.51.100.20(/24서브넷 마스크 포함) -

/64서브넷 마스크가 포함된 정적 IPv6 주소 -2001:db8:1::1 -

IPv4 기본 게이트웨이 -

198.51.100.254 -

IPv6 기본 게이트웨이 -

2001:db8:1::fffe -

IPv4 DNS 서버 -

198.51.100.200 -

IPv6 DNS 서버 -

2001:db8:1::ffbb -

DNS 검색 도메인 -

example.com

Ansible 제어 노드에서 다음 프로세스를 수행합니다.

사전 요구 사항

- 제어 노드와 관리형 노드가 준비되었습니다.

- 관리 노드에서 플레이북을 실행할 수 있는 사용자로 제어 노드에 로그인되어 있습니다.

-

관리형 노드에 연결하는 데 사용하는 계정에는

sudo권한이 있습니다. - 이 플레이북을 실행하려는 관리형 노드 또는 관리형 노드 그룹은 Ansible 인벤토리 파일에 나열됩니다.

절차

다음과 같은 내용으로 플레이북 파일(예:

~/ethernet-connection.yml)을 생성합니다.--- - name: Configure the network hosts: managed-node-01.example.com tasks: - name: Configure an Ethernet connection with static IP and default gateway include_role: name: rhel-system-roles.network vars: network_connections: - name: enp1s0 type: ethernet autoconnect: yes ip: address: - 198.51.100.20/24 - 2001:db8:1::1/64 gateway4: 198.51.100.254 gateway6: 2001:db8:1::fffe dns: - 198.51.100.200 - 2001:db8:1::ffbb dns_search: - example.com state: up플레이북 구문을 확인합니다.

# ansible-playbook ~/ethernet-connection.yml --syntax-check이 명령은 구문만 검증하고 잘못되었지만 유효한 구성으로부터 보호하지 않습니다.

플레이북을 실행합니다.

# ansible-playbook ~/ethernet-connection.yml

추가 리소스

-

/usr/share/ansible/roles/rhel-system-roles.network/README.mdfile

8.13. 네트워크 RHEL 시스템 역할을 사용하여 정적 경로 구성

네트워크 RHEL 시스템 역할을 사용하여 정적 경로를 구성할 수 있습니다.

네트워크 RHEL 시스템 역할을 사용하는 플레이를 실행하고 설정 값이 플레이에 지정된 값과 일치하지 않으면 역할은 동일한 이름의 기존 연결 프로필을 재정의합니다. 이러한 값을 기본값으로 재설정하지 않으려면 구성이 이미 존재하는 경우에도 플레이에서 네트워크 연결 프로필의 전체 구성을 항상 지정합니다.

Ansible 제어 노드에서 다음 프로세스를 수행합니다.

사전 요구 사항

- 제어 노드와 관리형 노드가 준비되었습니다.

- 관리 노드에서 플레이북을 실행할 수 있는 사용자로 제어 노드에 로그인되어 있습니다.

-

관리형 노드에 연결하는 데 사용하는 계정에는

sudo권한이 있습니다. - 이 플레이북을 실행하려는 관리형 노드 또는 관리형 노드 그룹은 Ansible 인벤토리 파일에 나열됩니다.

절차

다음과 같은 내용과 함께 플레이북 파일(예:

~/add-static-routes.yml)을 생성합니다.--- - name: Configure the network hosts: managed-node-01.example.com tasks: - name: Configure an Ethernet connection with static IP and additional routes include_role: name: rhel-system-roles.network vars: network_connections: - name: enp7s0 type: ethernet autoconnect: yes ip: address: - 192.0.2.1/24 - 2001:db8:1::1/64 gateway4: 192.0.2.254 gateway6: 2001:db8:1::fffe dns: - 192.0.2.200 - 2001:db8:1::ffbb dns_search: - example.com route: - network: 198.51.100.0 prefix: 24 gateway: 192.0.2.10 - network: 2001:db8:2:: prefix: 64 gateway: 2001:db8:1::10 state: up

이미 존재하는지 여부에 따라 절차에서는 다음 설정으로

enp7s0연결 프로필을 생성하거나 업데이트합니다.-

정적 IPv4 주소 -

/24서브넷 마스크가 있는192.0.2.1 -

/64서브넷 마스크가 포함된 정적 IPv6 주소 -2001:db8:1::1 -

IPv4 기본 게이트웨이 -

192.0.2.254 -

IPv6 기본 게이트웨이 -

2001:db8:1::fffe -

IPv4 DNS 서버 -

192.0.2.200 -

IPv6 DNS 서버 -

2001:db8:1::ffbb -

DNS 검색 도메인 -

example.com 고정 경로:

-

198.51.100.0/24게이트웨이192.0.2.10 -

2001:db8:2::/64게이트웨이2001:db8:1::10

-

-

정적 IPv4 주소 -

플레이북 구문을 확인합니다.

# ansible-playbook ~/add-static-routes.yml --syntax-check이 명령은 구문만 검증하고 잘못되었지만 유효한 구성으로부터 보호하지 않습니다.

플레이북을 실행합니다.

# ansible-playbook ~/add-static-routes.yml

검증

관리형 노드에서 다음을 수행합니다.

IPv4 경로를 표시합니다.

# ip -4 route ... 198.51.100.0/24 via 192.0.2.10 dev enp7s0

IPv6 경로를 표시합니다.

# ip -6 route ... 2001:db8:2::/64 via 2001:db8:1::10 dev enp7s0 metric 1024 pref medium

추가 리소스

-

/usr/share/ansible/roles/rhel-system-roles.network/README.mdfile

8.14. 네트워크 RHEL 시스템 역할을 사용하여 ethtool 오프로드 기능 구성

네트워크 RHEL 시스템 역할을 사용하여 NetworkManager 연결의 ethtool 기능을 구성할 수 있습니다.

네트워크 RHEL 시스템 역할을 사용하는 플레이를 실행하고 설정 값이 플레이에 지정된 값과 일치하지 않으면 역할은 동일한 이름의 기존 연결 프로필을 재정의합니다. 이러한 값을 기본값으로 재설정하지 않으려면 구성이 이미 존재하는 경우에도 플레이에서 네트워크 연결 프로필의 전체 구성을 항상 지정합니다.

Ansible 제어 노드에서 다음 프로세스를 수행합니다.

사전 요구 사항

- 제어 노드와 관리형 노드가 준비되었습니다.

- 관리 노드에서 플레이북을 실행할 수 있는 사용자로 제어 노드에 로그인되어 있습니다.

-

관리형 노드에 연결하는 데 사용하는 계정에는

sudo권한이 있습니다. - 이 플레이북을 실행하려는 관리형 노드 또는 관리형 노드 그룹은 Ansible 인벤토리 파일에 나열됩니다.

절차

다음과 같은 콘텐츠를 사용하여

~/configure-ethernet-device-with-ethtool-features.yml과 같은 플레이북 파일을 생성합니다.--- - name: Configure the network hosts: managed-node-01.example.com tasks: - name: Configure an Ethernet connection with ethtool features include_role: name: rhel-system-roles.network vars: network_connections: - name: enp1s0 type: ethernet autoconnect: yes ip: address: - 198.51.100.20/24 - 2001:db8:1::1/64 gateway4: 198.51.100.254 gateway6: 2001:db8:1::fffe dns: - 198.51.100.200 - 2001:db8:1::ffbb dns_search: - example.com ethtool: features: gro: "no" gso: "yes" tx_sctp_segmentation: "no" state: up이 플레이북은 다음 설정으로

enp1s0연결 프로필을 생성하거나 프로필이 이미 있는 경우 업데이트합니다.-

정적

IPv4주소 -198.51.100.20(/24서브넷 마스크 포함) -

/64서브넷 마스크가 포함된 정적IPv6주소 -2001:db8:1::1 -

IPv4기본 게이트웨이 -198.51.100.254 -

IPv6기본 게이트웨이 -2001:db8:1::fffe -

IPv4DNS 서버 -198.51.100.200 -

IPv6DNS 서버 -2001:db8:1::ffbb -

DNS 검색 도메인 -

example.com ethtool기능:- GRO(Generic receive offload): 비활성화됨

- 일반 세그먼트 오프로드(GSO): 활성화됨

- TX SCTP(스트림 제어 전송 프로토콜) 세그먼트: 비활성화

-

정적

플레이북 구문을 확인합니다.

# ansible-playbook ~/configure-ethernet-device-with-ethtool-features.yml --syntax-check이 명령은 구문만 검증하고 잘못되었지만 유효한 구성으로부터 보호하지 않습니다.

플레이북을 실행합니다.

# ansible-playbook ~/configure-ethernet-device-with-ethtool-features.yml

추가 리소스

-

/usr/share/ansible/roles/rhel-system-roles.network/README.mdfile

8.15. 네트워크 RHEL 시스템 역할을 사용하여 ethtool 병합 설정 구성

RHEL 시스템 역할을 사용하여 NetworkManager 연결의 ethtool 병합 설정을 구성할 수 있습니다.

네트워크 RHEL 시스템 역할을 사용하는 플레이를 실행하고 설정 값이 플레이에 지정된 값과 일치하지 않으면 역할은 동일한 이름의 기존 연결 프로필을 재정의합니다. 이러한 값을 기본값으로 재설정하지 않으려면 구성이 이미 존재하는 경우에도 플레이에서 네트워크 연결 프로필의 전체 구성을 항상 지정합니다.

Ansible 제어 노드에서 다음 프로세스를 수행합니다.

사전 요구 사항

- 제어 노드와 관리형 노드가 준비되었습니다.

- 관리 노드에서 플레이북을 실행할 수 있는 사용자로 제어 노드에 로그인되어 있습니다.

-

관리형 노드에 연결하는 데 사용하는 계정에는

sudo권한이 있습니다. - 이 플레이북을 실행하려는 관리형 노드 또는 관리형 노드 그룹은 Ansible 인벤토리 파일에 나열됩니다.

절차

다음 콘텐츠를 사용하여 플레이북 파일(예:

~/configure-ethernet-device-with-ethtoolcoalesce-settings.yml)을 만듭니다.--- - name: Configure the network hosts: managed-node-01.example.com tasks: - name: Configure an Ethernet connection with ethtool coalesce settings include_role: name: rhel-system-roles.network vars: network_connections: - name: enp1s0 type: ethernet autoconnect: yes ip: address: - 198.51.100.20/24 - 2001:db8:1::1/64 gateway4: 198.51.100.254 gateway6: 2001:db8:1::fffe dns: - 198.51.100.200 - 2001:db8:1::ffbb dns_search: - example.com ethtool: coalesce: rx_frames: 128 tx_frames: 128 state: up이 플레이북은 다음 설정으로

enp1s0연결 프로필을 생성하거나 프로필이 이미 있는 경우 업데이트합니다.-

정적 IPv4 주소 -

198.51.100.20(/24서브넷 마스크 포함) -

/64서브넷 마스크가 포함된 정적 IPv6 주소 -2001:db8:1::1 -

IPv4 기본 게이트웨이 -

198.51.100.254 -

IPv6 기본 게이트웨이 -

2001:db8:1::fffe -

IPv4 DNS 서버 -

198.51.100.200 -

IPv6 DNS 서버 -

2001:db8:1::ffbb -

DNS 검색 도메인 -

example.com ethtoolcoalesce 설정:-

RX 프레임:

128 -

TX 프레임:

128

-

RX 프레임:

-

정적 IPv4 주소 -

플레이북 구문을 확인합니다.

# ansible-playbook ~/configure-ethernet-device-with-ethtoolcoalesce-settings.yml --syntax-check이 명령은 구문만 검증하고 잘못되었지만 유효한 구성으로부터 보호하지 않습니다.

플레이북을 실행합니다.

# ansible-playbook ~/configure-ethernet-device-with-ethtoolcoalesce-settings.yml

추가 리소스

-

/usr/share/ansible/roles/rhel-system-roles.network/README.mdfile

8.16. 네트워크 RHEL 시스템 역할을 사용하여 높은 패킷 드롭 속도를 줄이기 위해 링 버퍼 크기 증가

패킷 삭제 속도가 발생하면 이더넷 장치의 링 버퍼 크기를 늘리면 애플리케이션이 데이터 손실, 시간 초과 또는 기타 문제가 보고됩니다.

링 버퍼는 오버플로가 기존 데이터를 덮어쓰는 순환 버퍼입니다. 네트워크 카드는 전송(TX)을 할당하고(RX) 링 버퍼를 수신합니다. 수신 링 버퍼는 장치 드라이버와 NIC(네트워크 인터페이스 컨트롤러) 간에 공유됩니다. 데이터는 SoftIRQs라고도 하는 하드웨어 인터럽트 또는 소프트웨어 인터럽트를 통해 NIC에서 커널로 이동할 수 있습니다.

커널은 장치 드라이버가 이를 처리할 수 있을 때까지 RX 링 버퍼를 사용하여 들어오는 패킷을 저장합니다. 장치 드라이버는 일반적으로 SoftIRQs를 사용하여 RX 링을 드레이닝하여 들어오는 패킷을 sk_buff 또는 skb 라는 커널 데이터 구조에 배치하여 커널과 관련 소켓을 소유하는 애플리케이션까지 이동합니다.

커널은 TX 링 버퍼를 사용하여 네트워크로 전송해야 하는 발신 패킷을 보관합니다. 이러한 링 버퍼는 스택 하단에 있으며 패킷 드롭이 발생할 수 있는 중요한 지점이며 네트워크 성능에 부정적인 영향을 미칩니다.

네트워크 RHEL 시스템 역할을 사용하는 플레이를 실행하고 설정 값이 플레이에 지정된 값과 일치하지 않으면 역할은 동일한 이름의 기존 연결 프로필을 재정의합니다. 이러한 값을 기본값으로 재설정하지 않으려면 구성이 이미 존재하는 경우에도 플레이에서 네트워크 연결 프로필의 전체 구성을 항상 지정합니다.

Ansible 제어 노드에서 다음 프로세스를 수행합니다.

사전 요구 사항

- 제어 노드와 관리형 노드가 준비되었습니다.

- 관리 노드에서 플레이북을 실행할 수 있는 사용자로 제어 노드에 로그인되어 있습니다.

-

관리형 노드에 연결하는 데 사용하는 계정에는

sudo권한이 있습니다. - 이 플레이북을 실행하려는 관리형 노드 또는 관리형 노드 그룹은 Ansible 인벤토리 파일에 나열됩니다.

- 장치가 지원하는 최대 링 버퍼 크기를 알고 있습니다.

절차

다음 콘텐츠를 사용하여 플레이북 파일(예:

~/configure-ethernet-device-with-ring-buffer-sizes.yml)을 만듭니다.--- - name: Configure the network hosts: managed-node-01.example.com tasks: - name: Configure an Ethernet connection with increased ring buffer sizes include_role: name: rhel-system-roles.network vars: network_connections: - name: enp1s0 type: ethernet autoconnect: yes ip: address: - 198.51.100.20/24 - 2001:db8:1::1/64 gateway4: 198.51.100.254 gateway6: 2001:db8:1::fffe dns: - 198.51.100.200 - 2001:db8:1::ffbb dns_search: - example.com ethtool: ring: rx: 4096 tx: 4096 state: up이 플레이북은 다음 설정으로

enp1s0연결 프로필을 생성하거나 프로필이 이미 있는 경우 업데이트합니다.-

정적

IPv4주소 -198.51.100.20(/24서브넷 마스크 포함) -

/64서브넷 마스크가 포함된 정적IPv6주소 -2001:db8:1::1 -

IPv4기본 게이트웨이 -198.51.100.254 -

IPv6기본 게이트웨이 -2001:db8:1::fffe -

IPv4DNS 서버 -198.51.100.200 -

IPv6DNS 서버 -2001:db8:1::ffbb -

DNS 검색 도메인 -

example.com 최대 링 버퍼 항목 수:

- 수신(RX): 4096

- 전송(TX): 4096

-

정적

플레이북 구문을 확인합니다.

# ansible-playbook ~/configure-ethernet-device-with-ring-buffer-sizes.yml --syntax-check이 명령은 구문만 검증하고 잘못되었지만 유효한 구성으로부터 보호하지 않습니다.

플레이북을 실행합니다.

# ansible-playbook ~/configure-ethernet-device-with-ring-buffer-sizes.yml

추가 리소스

-

/usr/share/ansible/roles/rhel-system-roles.network/README.mdfile

8.17. 네트워크 RHEL 시스템 역할의 네트워크 상태

네트워크 RHEL 시스템 역할은 플레이북의 상태 구성을 지원하여 장치를 구성합니다. 이를 위해 network_state 변수 다음에 상태 구성을 사용합니다.

플레이북에서 network_state 변수를 사용하는 이점:

- 상태 구성과 함께 선언적 메서드를 사용하여 인터페이스를 구성할 수 있으며 NetworkManager는 이러한 인터페이스에 대한 프로필을 백그라운드에서 만듭니다.

-

network_state변수를 사용하면 변경해야 하는 옵션을 지정할 수 있으며 다른 모든 옵션은 그대로 유지됩니다. 그러나network_connections변수를 사용하여 네트워크 연결 프로필을 변경하려면 모든 설정을 지정해야 합니다.

예를 들어 동적 IP 주소 설정으로 이더넷 연결을 생성하려면 플레이북에서 다음 vars 블록을 사용합니다.

| 상태 구성이 있는 플레이북 | 일반 플레이북 |

vars:

network_state:

interfaces:

- name: enp7s0

type: ethernet

state: up

ipv4:

enabled: true

auto-dns: true

auto-gateway: true

auto-routes: true

dhcp: true

ipv6:

enabled: true

auto-dns: true

auto-gateway: true

auto-routes: true

autoconf: true

dhcp: true

|

vars:

network_connections:

- name: enp7s0

interface_name: enp7s0

type: ethernet

autoconnect: yes

ip:

dhcp4: yes

auto6: yes

state: up

|

예를 들어 위와 같이 생성한 동적 IP 주소 설정의 연결 상태만 변경하려면 플레이북에서 다음 vars 블록을 사용합니다.

| 상태 구성이 있는 플레이북 | 일반 플레이북 |

vars:

network_state:

interfaces:

- name: enp7s0

type: ethernet

state: down

|

vars:

network_connections:

- name: enp7s0

interface_name: enp7s0

type: ethernet

autoconnect: yes

ip:

dhcp4: yes

auto6: yes

state: down

|

추가 리소스

-

/usr/share/ansible/roles/rhel-system-roles.network/README.mdfile

9장. RHEL 시스템 역할을 사용하여 firewalld 구성

방화벽 시스템 역할을 사용하여 한 번에 여러 클라이언트에서 firewalld 서비스 설정을 구성할 수 있습니다. 이 해결 방법:

- 효율적인 입력 설정으로 인터페이스를 제공합니다.

-

의도된 모든

firewalld매개변수를 한 곳에 유지합니다.

제어 노드에서 방화벽 역할을 실행한 후 System Role은 firewalld 매개변수를 관리 노드에 즉시 적용하여 재부팅 시에도 유지됩니다.

9.1. 방화벽 RHEL 시스템 역할 소개

RHEL 시스템 역할은 Ansible 자동화 유틸리티의 콘텐츠 집합입니다. 이 콘텐츠는 Ansible 자동화 유틸리티와 함께 여러 시스템을 원격으로 관리할 수 있는 일관된 구성 인터페이스를 제공합니다.

RHEL 시스템 역할의 rhel-system-roles.firewall 역할은 firewalld 서비스의 자동화된 구성을 위해 도입되었습니다. rhel-system-roles 패키지에는 이 시스템 역할 및 참조 문서가 포함되어 있습니다.

자동화된 방식으로 하나 이상의 시스템에서 firewalld 매개 변수를 적용하려면 플레이북의 firewall 시스템 역할 변수를 사용합니다. 플레이북은 텍스트 기반 YAML 형식으로 작성된 하나 이상의 플레이 목록입니다.

인벤토리 파일을 사용하여 Ansible에서 구성할 시스템 집합을 정의할 수 있습니다.

방화벽 역할을 사용하면 다음과 같이 다양한 firewalld 매개변수를 구성할 수 있습니다.

- 영역.

- 패킷을 허용해야 하는 서비스입니다.

- 포트에 대한 트래픽 액세스 권한 부여, 거부 또는 삭제.

- 영역의 포트 또는 포트 범위 전달.

추가 리소스

-

/usr/share/doc/rhel-system-roles/firewall/디렉터리의README.md및README.html파일 - 플레이북 작업

- 인벤토리를 빌드하는 방법

9.2. RHEL 시스템 역할을 사용하여 firewalld 설정 재설정

방화벽 RHEL 시스템 역할을 사용하면 firewalld 설정을 기본 상태로 재설정할 수 있습니다. previous:replaced 매개변수를 변수 목록에 추가하면 System Role은 기존 사용자 정의 설정을 모두 제거하고 firewalld 를 기본값으로 재설정합니다. previous:replaced 매개변수를 다른 설정과 결합하는 경우 firewall 역할은 새 설정을 적용하기 전에 기존 설정을 모두 제거합니다.

Ansible 제어 노드에서 다음 프로세스를 수행합니다.

사전 요구 사항

- 제어 노드와 관리형 노드가 준비되었습니다.

- 관리 노드에서 플레이북을 실행할 수 있는 사용자로 제어 노드에 로그인되어 있습니다.

-

관리형 노드에 연결하는 데 사용하는 계정에는 해당 노드에 대한

sudo권한이 있습니다. - 이 플레이북을 실행하려는 관리형 노드 또는 관리형 노드 그룹은 Ansible 인벤토리 파일에 나열됩니다.

절차

다음과 같은 내용과 함께 플레이북 파일(예:

~/reset-firewalld.yml)을 생성합니다.--- - name: Reset firewalld example hosts: managed-node-01.example.com tasks: - name: Reset firewalld include_role: name: rhel-system-roles.firewall vars: firewall: - previous: replaced플레이북 구문을 확인합니다.

# ansible-playbook ~/configure-ethernet-device-with-ethtoolcoalesce-settings.yml --syntax-check이 명령은 구문만 검증하고 잘못되었지만 유효한 구성으로부터 보호하지 않습니다.

플레이북을 실행합니다.

# ansible-playbook ~/reset-firewalld.yml

검증

이 명령을 관리 노드에서

root로 실행하여 모든 영역을 확인합니다.# firewall-cmd --list-all-zones

추가 리소스

-

/usr/share/ansible/roles/rhel-system-roles.firewall/README.md

9.3. RHEL 시스템 역할을 사용하여 하나의 로컬 포트에서 다른 로컬 포트로 firewalld 에서 들어오는 트래픽 전달

방화벽 역할을 사용하면 여러 관리 호스트에 미치는 영향을 사용하여 firewalld 매개변수를 원격으로 구성할 수 있습니다.

Ansible 제어 노드에서 다음 프로세스를 수행합니다.

사전 요구 사항

- 제어 노드와 관리형 노드가 준비되었습니다.

- 관리 노드에서 플레이북을 실행할 수 있는 사용자로 제어 노드에 로그인되어 있습니다.

-

관리형 노드에 연결하는 데 사용하는 계정에는 해당 노드에 대한